1 Kafka介绍1

1.1 定义

01.发展

Kafka 是基于发布与订阅的消息系统。

它最初由 LinkedIn 公司开发,之后成为 Apache 项目的一部分。

Kafka 是一个分布式的,可分区的,冗余备份的持久性的日志服务。它主要用于处理活跃的流式数据。

02.说明

在大数据系统中,常常会碰到一个问题,整个大数据是由各个子系统组成,数据需要在各个子系统中高性能、低延迟的不停流转。

传统的企业消息系统并不是非常适合大规模的数据处理。为了同时搞定在线应用(消息)和离线应用(数据文件、日志),Kafka 就出现了。

03.设计

在这方面,Kafka遵循了一种大部分消息系统共同的传统的设计:producer将消息推送到broker,consumer从broker拉取消息。

1.2 主要特点

01.优点

应用解耦 - 系统间通过消息通信,不用关心其他系统的处理。

异步处理 - 相比于传统的串行、并行方式,提高了系统吞吐量。

流量削锋 - 可以通过消息队列长度控制请求量;可以缓解短时间内的高并发请求。

消息通讯 - 消息队列一般都内置了高效的通信机制,因此也可以用在纯的消息通讯。比如实现点对点消息队列,或者聊天室等。

日志处理 - 解决大量日志传输。

---------------------------------------------------------------------------------------------------------

1.同时为发布和订阅提供高吞吐量。据了解,Kafka 每秒可以生产约 25 万消息(50MB),每秒处理 55 万消息(110MB)。

2.可进行持久化操作。将消息持久化到磁盘,因此可用于批量消费,例如 ETL ,以及实时应用程序。通过将数据持久化到硬盘,以及replication ,可以防止数据丢失。

3.分布式系统,易于向外扩展。所有的 Producer、Broker 和Consumer 都会有多个,均为分布式的。并且,无需停机即可扩展机器。

4.消息被处理的状态是在 Consumer 端维护,而不是由 Broker 端维护。当失败时,能自动平衡。

5.支持 online 和 offline 的场景。

02.缺点

由于是批量发送,数据并非真正的实时;

对于mqtt协议不支持;

不支持物联网传感数据直接接入;

仅支持统一分区内消息有序,无法实现全局消息有序;

监控不完善,需要安装插件;

依赖zookeeper进行元数据管理;

1.3 重点概念

01.概念

Topic:特指 Kafka 处理的消息源(feeds of messages)的不同分类。

Partition:Topic 物理上的分组(分区),一个 Topic 可以分为多个 Partition 。每个 Partition 都是一个有序的队列。Partition 中的每条消息都会被分配一个有序的 id(offset)。

Message:消息,是通信的基本单位,每个 Producer 可以向一个Topic(主题)发布一些消息。

Producers:消息和数据生产者,向 Kafka 的一个 Topic 发布消息的过程,叫做 producers 。

Consumers:消息和数据消费者,订阅 Topic ,并处理其发布的消息的过程,叫做 consumers 。

Broker:缓存代理,Kafka 集群中的一台或多台服务器统称为 broker 。

ZooKeeper:Kafka 通过 ZooKeeper 来存储集群的 Topic、Partition 等元信息等。

02.单纯角色来说,Kafka 和 RocketMQ 是基本一致的(RocketMQ 从 Kafka 演化而来)。

比较明显的差异是:

1、Kafka 使用 Zookeeper 作为命名服务;RocketMQ 自己实现了一个轻量级的 Namesrv 。

2、Kafka Broker 的每个分区都有一个首领分区;RocketMQ 每个分区的“首领”分区,都在 Broker Master 节点上。

3、Kafka Consumer 使用 poll 的方式拉取消息;RocketMQ Consumer 提供 poll 的方式的同时,封装了一个 push 的方式。

1.4 使用场景

00.汇总

a.日志收集

一个公司可以用Kafka可以收集各种服务的log

通过kafka以统一接口服务的方式开放给各种consumer,例如hadoop、HBase、Solr等

b.消息系统

解耦和生产者和消费者、缓存消息等。

c.用户活动跟踪

Kafka经常被用来记录web用户或者app用户的各种活动,如浏览网页、搜索、点击等活动,

这些活动信息被各个服务器发布到kafka的topic中,然后订阅者通过订阅这些topic来做实时的监控分析,或者装载到hadoop、数据仓库中做离线分析和挖掘

d.运营指标

Kafka也经常用来记录运营监控数据。包括收集各种分布式应用的数据,生产各种操作的集中反馈,比如报警和报告

e.流式处理

比如spark、streaming、Flink

1.5 数据均衡

01.介绍

在线上程序运行的时候,有的时候因为上面副本的损坏,从而系统会自动选举出来一个新的leader并且分配到不同的节点上,

有的时候这个leader的节点分布的并不是特别均匀,这个时候就需要进行均衡一下,使得每个broker的节点压力均衡

02.以下三个参数进行控制

参数 解释

auto.leader.rebalance.enable 系统每隔300s会自动检查系统的leader分布是否均匀,如果不均匀会自动进行leader的切换

leader.imbalance.per.broker.percentage broker上的leader比例超过10%认为不均衡

leader.imbalance.check.interval.seconds 检查间隔300s默认值

---------------------------------------------------------------------------------------------------------

auto.leader.rebalance.enable 这个开关开启会自动选举或者切换leader节点,并且分布在不同的节点上,

但是有的时候这个开关开启会影响系统性能,因为线上环境切换leader是比较繁琐的

03.说明

a.一般我们会关闭这个开关并且选择手动切换均衡

kafka-leader-election.sh --bootstrap-server nn1:9092 --topic topic_a --partition 1 --election-type preferred

b.优先在ISR中选举出来新的leader进行负载,并且我们也可以自己进行副本的位置进行设定

# 首先创建一个topic.json 输入如下内容

{"topics":[{"topic":"topic_a"}],"version":1}

# 整体代码命令如下

kafka-reassign-partitions.sh --bootstrap-server nn1:9092 --broker-list 0,1,2,3,4 --topics-to-move-json-file topic.json --generate

c.使用这个均衡优化命令生成优化计划

{"version":1,"partitions":[{"topic":"topic_a","partition":0,"replicas":[3,4,0],"log_dirs":["any","any","any"]},{"topic":"topic_a","partition":1,"replicas":[4,0,1],"log_dirs":["any","any","any"]},{"topic":"topic_a","partition":2,"replicas":[0,1,2],"log_dirs":["any","any","any"]},{"topic":"topic_a","partition":3,"replicas":[1,2,3],"log_dirs":["any","any","any"]}]}

修改其中副本的位置,并且设定ISR的优先顺序

1.6 选举机制?先到先得

00.总结

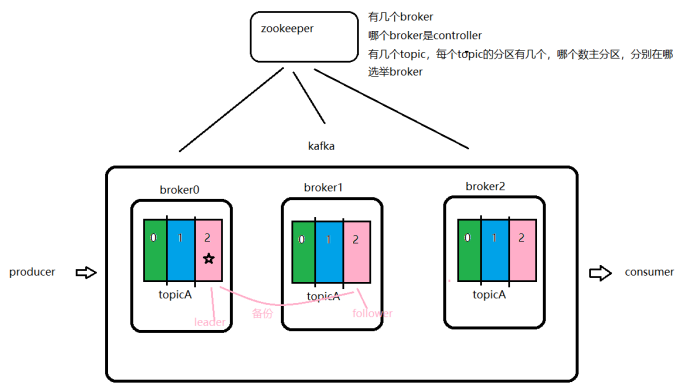

a.旧版

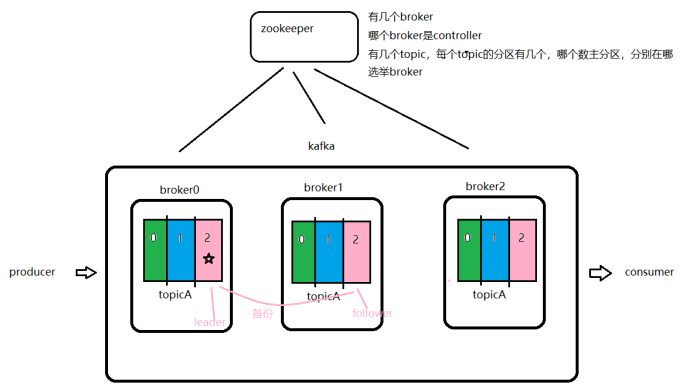

zookeeper可以实现controller的选举,并且记录topic和partition的元数据信息,帮助多个broker同步数据信息

b.新版

在新版本中的kafka模式中可以这个管理和选举可以用kafka自己完成,而不再依赖zookeeper

---------------------------------------------------------------------------------------------------------

搭建kafka集群:

首先要设定process.roles,可以人为指定每个人的角色,如果指定broker那么它永远是broker

如果指定controller那么它一定是controller,但是这样的话其他人就没有办法作为主节点了

所以一般选择broker,controller可以自动进行适配和选举

一般一个集群中会设定大部分是broker,少量的几个是controller+broker方便选举

设定哪几个机器作为协调的机器出现,帮助kafka自身选举

还需要设定对外端口和每个节点的编号

最后还要设定数据存储的位置

log.dirs=/data/kafka-logs

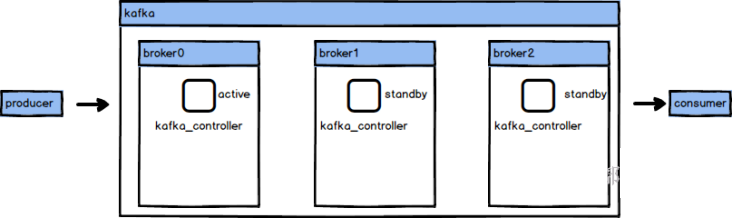

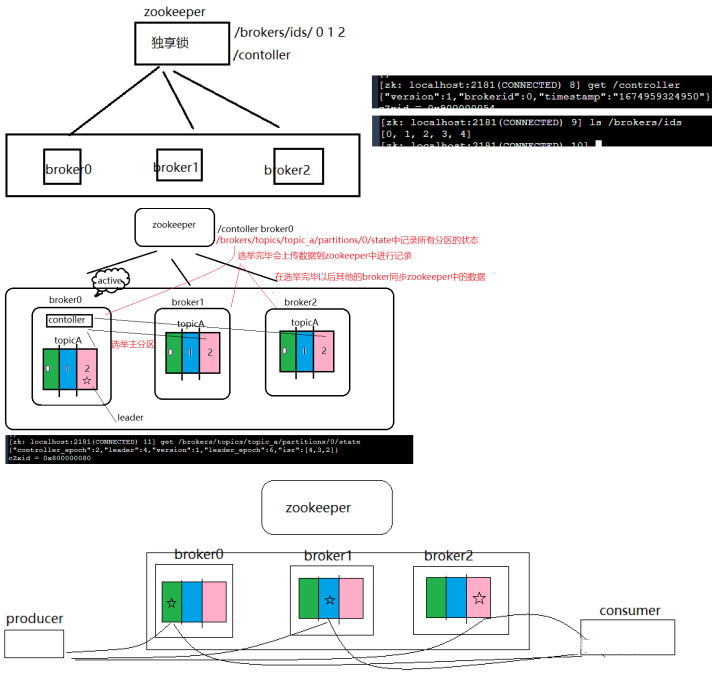

01.controller选举

首先第一个选举就是借助于zookeeper的controller的选举

第一个就是controller的选举,这个选举是借助于zookeeper的独享锁实现的,先启动的broker会在zookeeper的/contoller节点

上面增加一个broker信息,谁创建成功了谁就是主节点,其他的broker会启动watch监视器进行监听其中的数据变化,

如果宕机了其他的节点会抢占这个节点选举为controller节点

02.partition leader选举

每个topic都存在多个分区,每个分区又存在多个副本,其中有一个副本是主节点其他都是从节点,负责和主分区同步数据,

并且生产者和消费者都是通过主节点进行操作kafka数据的

---------------------------------------------------------------------------------------------------------

那么他们的选举是通过什么进行选择的呢?

controller节点会按照分区的注册顺序,优先选择前面的节点进行选择

---------------------------------------------------------------------------------------------------------

如果主节点宕机后是如何选择的呢?

首先我们使用命令来查看其中一个topic的详细信息

kafka-topics.sh --bootstrap-server nn1:9092 --topic topic_a --describe

---------------------------------------------------------------------------------------------------------

其中我们会看到最后一列内容是ISR,这个叫做动态副本集,它的作用使用强大,在kafka中存储数据的时候首先存储数据到

主分区中,然后主分区中的数据会同步到不同的副本分区中,做数据的同步备份,尤其是在producer端设定ack=-1的时候,

要在所有副本都同步完毕消息以后才会返回ack,producer才会发送下一条数据过来,但是如果因为其中一个副本的网络卡顿

或者是自己宕机那么会出现一直同步不成功的情况,从而producer不能继续发送数据,所以kafka动态维护了一个副本集,

这个副本集中都是可以正常同步数据的,也就是说他们都是正常的,如果不正常的不能保持和主节点同步的副本就会从这个

里面删除掉

---------------------------------------------------------------------------------------------------------

为什么说这个ISR呢?

因为一旦主分区宕机了,那么broker【controller】节点就会检测到,那么就会在ISR中按照顺序选择一个好的节点成为主分区。

这就是主分区宕机后的选举实现,但是选择的节点一般都是数据比较新的,会选择落后太多的副本

但是有时候ISR中的副本如果都为空就没有办法选择新的leader分区了,这个时候为了集群的稳定性,可以设定

# 将这个开关打开,默认是false关闭的,它允许实现ISR以外的节点成为主节点

unclean.leader.election.enable

---------------------------------------------------------------------------------------------------------

这个会出现数据丢失问题,但是可以在一定程度上保证程序的稳定性

我们可以做一个实验,先查看一下topic_a的分区详细信息,可以发现partition0的主分区在broker3上面

我们可以在s2节点关闭broker,来模拟集群单节点损坏的情况

kafka-server-stop.sh

再次查看可以看到partition0的主分区在broker4上面

1.7 数据同步?宕机后重选

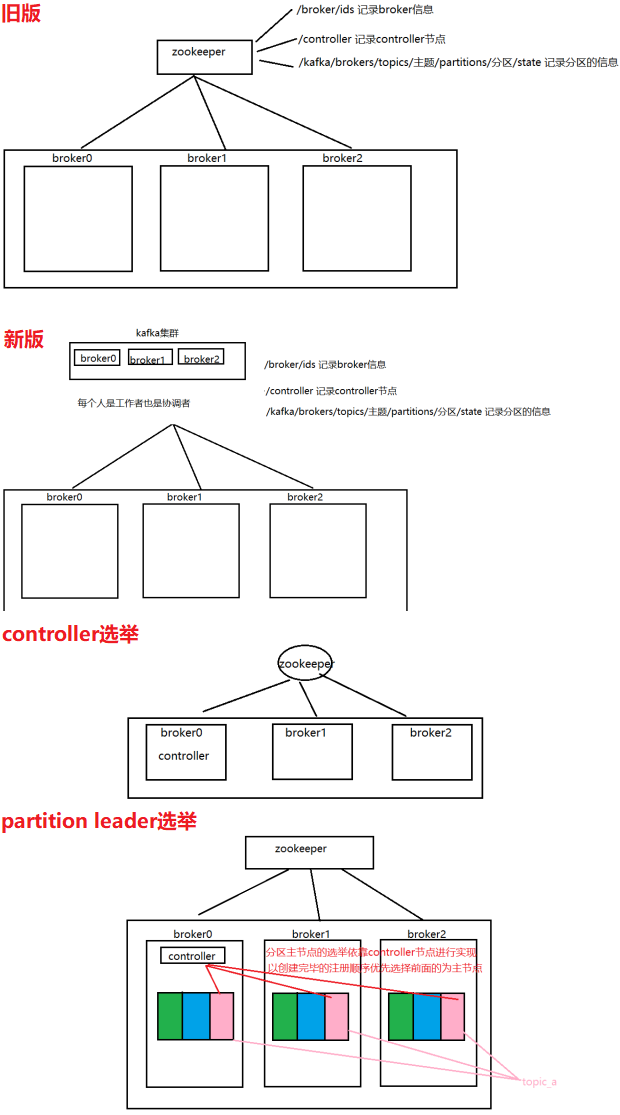

01.发现每个分区的数据都不一样,但是三个分区对外的数据却是一致的

所有数据的操作全部都针对于leader分区,follower负责同步数据,所以主分区的数据是最新的,从节点会有一个数据同步的过程

这个时候副本间会有一个数据差别,所有的节点都同步完的数据会对外提供使用

02.这个时候如果第二个副本宕机了

在损坏的时候不能及时同步数据就会被提出ISR列表。这个时候,它记录了宕机的时候watermark是4,

如果他重新启动了,并且加入到集群中了,首先会把自己多于4的部分56出除,

然后和leader重新同步数据,直到同步完毕教据会加入到isr中

03.但是如果是leader副本岩机了会发生什么呢?

leader节点岩机了,那么会选举出来ISR中的一个副本为主,

首先选的就是第二个机器,因为他的数据是最新的,所以在选举成为主节点的时候数据会比较新不会丢失数据

这个时候其他的节点会截取掉watermark之后的数据,然后和新的leader同步数据

1.8 文件存储?流式处理

01.介绍

kafka的使用场景就是在流式处理过程中,充当一个中间缓冲介质的作用,主要功能是将数据先放入到kafka中,

计算框架会自己拉取要消费和计算的数据过来,采用poll的方式完全适配自身消费速率。

那么kafka的存储和hdfs的存储的区别非常清楚的就可以提现出来,hdfs更加适用于整体的存储和取出,

kafka主要做的是流,数据都是按照条进行流转的,主打的是灵活和效率,那么效率提现在哪些方面上呢???

02.效率提现在哪些方面上呢?

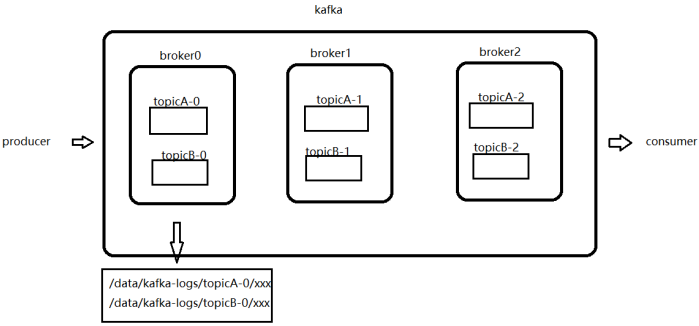

首先topic是按照分区进行划分的,因为多个分区可以将存储的数据放入到不同的机器节点上,这样起到负载均衡的作用,

所以每个broker机器节点上面存储的数据都是多个topic的不同的分区的数据,这样分布式处理可以增加kafka的计算和处理能力

---------------------------------------------------------------------------------------------------------

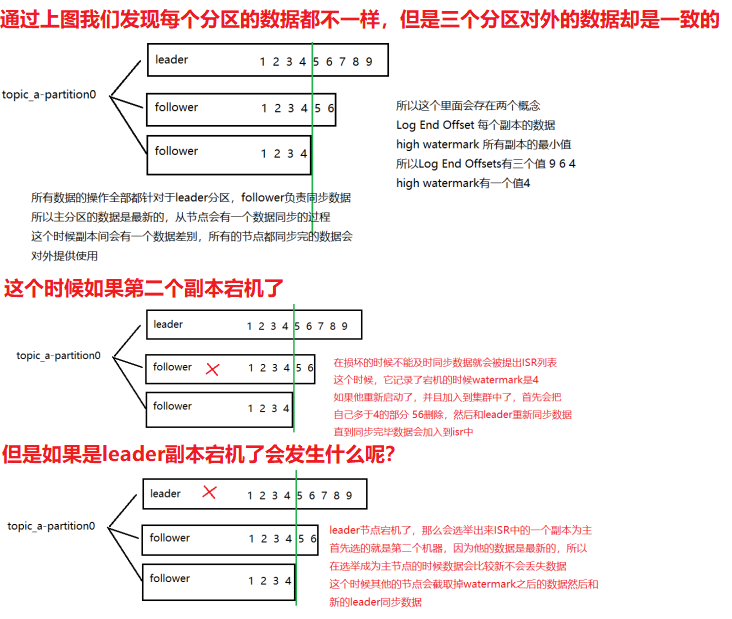

所以broker上面会管理很多topic的不同partition的数据,存储的结构就是以topic-partition方式进行命名的文件夹存储数据,

但是随着数据的增加,单个分区的数据也会随之增多,这样管理和检索都在一个文件中也是非常低效率的,

解决办法就是单个分区的数据也会切段进行存储,每个段称之为segment,每一个段称之为一个segement

---------------------------------------------------------------------------------------------------------

在官网中形容的是单个日志文件的最大值,默认是1G

这样不管找寻什么样的数据都会直接找寻相应的segment段落就行了,不管数据多大,其检索范围也不会超过1G

但是一个G的文件检索还是比较大的,所以kafka在存储数据的时候,首先存储数据在内存中,然后将数据刷写到磁盘上,这个刷写的大小是以4K为主的

---------------------------------------------------------------------------------------------------------

在这个插入过程中会追加的形式存储到log文件中,并且在index和timeindex中存在稀疏的索引数据

这个时候查询的时候就可以直接去根据文件条数命名的对应segment中查询数据。能够轻易的跳过1G的部分

在具体查询数据的时候可以根据index去log中查询数据,速度更快,效率更高

检索过程为先跳过整体segment部分,然后在segment部分找到index,根据index找到相对应偏移量位置,然后找寻log日志中的数据

以如此方式进行数据检索,这样的存储格式让检索效果更佳明显

以上只是kafka的存储方式之一,主要是为了让数据存储更加方便管理和检索

1.9 文件追加(写)、零拷贝(读)

01.介绍1

我们发现存储的方式比较有规划是对于后续查询非常便捷的,但是这样存储是不是会更加消耗存储性能呢?

其实kafka的数据存储是追加形式的,也就是数据在存储到文件中的时候是以追加方式拼接到文件末尾的,这样就非常快速的跳过了文件的检索步骤

02.写入的速度非常快?文件追加

机械磁盘的文件检索需要使用到磁头进行不断扫描数据,如果存储大量的小文件或者存储位置不同的时候需要不停的扫描检索文件

的位置,这个过程是非常浪费时间的,但是kafka的数据完全以追加的方式存储到磁盘中的,那么这个时候就完全省去了这样的

一个过程,使得机械磁盘的性能和固态的性能相差无几

我们可以看到经过测试,机械磁盘的存储性能可以达到600M/s 但是随机读写就比较慢100k/s,所以追加写造就了kafka的高写入性能

03.读取的性能是如何保证的呢?零拷贝

首先kafka的数据就是以分区作为单位进行分布式管理的,所以多个机器共同管理,效果更加明显

kafka的存储是按照segment切分的,并且存储的数据是带有index索引的,这个速度可以几乎直接定位到相应的检索文件

并且kafka还实现了零拷贝技术

04.零拷贝技术

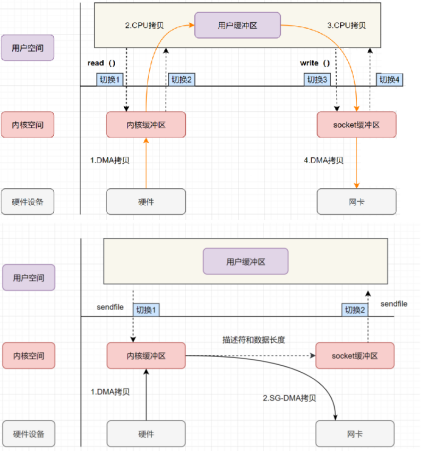

首先我们可以看到普通的存储在磁盘上的文件要想发送出去的话,需要走以上的步骤

通过内核和用户空间的加载,反反复复经过4次加载和拷贝过程,这个过程是非常消耗性能和io的

其实直白来说,如果数据加载的过程中不走用户缓冲区的话直接以内核加载一次的方式进行传输效率是更加高效的

---------------------------------------------------------------------------------------------------------

所以使用到零拷贝技术,方式就是只将数据从磁盘加载到内存中一次,然后直接从内核空间将数据发送到网卡从而直接传输给消费者端

零拷贝技术的本质就是怎么减少数据的复制过程,并不是没有数据的复制

这个实现方式就是使用到sendFile的系统函数,它可以直接实现系统内存的映射

1.10 文件清除?默认存储7天

01.介绍

kafka数据并不是为了做大量存储使用的,

主要的功能是在流式计算中进行数据的流转,所以kafka中的数据并不做长期存储,默认存储时间为7天

02.kafka中的数据是如何进行删除的呢

在Kafka中,存在数据过期的机制,称为data expire。

如何处理过期数据是根据指定的policy(策略)决定的,而处理过期数据的行为,即为log cleanup。

03.kafka中有以下几种处理过期数据的策略

log.cleanup.policy=delete(Kafka中所有用户创建的topics,默认均为此策略)

根据数据已保存的时间,进行删除(默认为1周)

根据log的max size,进行删除(默认为-1,也就是无限制)

log.cleanup.policy=compact(topic __consumer_offsets 默认为此策略)

根据messages中的key,进行删除操作

在active segment 被commit 后,会删除掉old duplicate keys

无限制的时间与空间的日志保留

---------------------------------------------------------------------------------------------------------

自动清理Kafka中的数据可以控制磁盘上数据的大小、删除不需要的数据,同时也减少了对Kafka集群的维护成本。

04.那Log cleanup 在什么时候发生呢?

首先值得注意的是:log cleanup 在partition segment 上发生

更小/更多的segment,也就意味着log cleanup 发生的频率会上升

Log cleanup 不应该频繁发生=> 因为它会消耗CPU与内存资源

Cleaner的检查会在每15秒进行一次,由log.cleaner.backoff.ms 控制

05.log.cleanup.policy=delete

log.cleanup.policy=delete 的策略,根据数据保留的时间、以及log的max size,对数据进行cleanup。

控制数据保留时间以及log max size的参数分别为:

log.retention.hours:指定数据保留的时常(默认为一周,168)

将参数调整到更高的值,也就意味着会占据更多的磁盘空间

更小值意味着保存的数据量会更少(假如consumer 宕机超过一周,则数据便会再未处理前即丢失)

log.retention.bytes:每个partition中保存的最大数据量大小(默认为-1,也就是无限大)

再控制log的大小不超过一个阈值时,会比较有用

06.在到达log cleanup 的条件后,cleaner会自动根据时间或是空间的规则进行删除,新数据仍写入active segment:

针对于这个参数,一般有以下两种使用场景,分别为:

log保留周期为一周,根据log保留期进行log cleanup:

log.retention.hours=168 以及 log.retention.bytes=-1

log保留期为无限制,根据log大小进行进行log cleanup:

log.retention.hours=17520以及 log.retention.bytes=524288000

其中第一个场景会更常见。

07.Log Compaction

a.介绍

Log compaction用于确保:在一个partition中,对任意一个key,它所对应的value都是最新的。

这里举个例子:我们有个topic名为employee-salary,我们希望维护每个employee当前最新的工资情况。

左边的是compaction前,segments中的数据,右边为compaction 后,segments中的数据,其中有部分key对应的value有更新:

可以看到在log compaction后,相对于更新后的key-value message,旧的message被删除。

b.特点

messages的顺序仍然是保留的,log compaction 仅移除一些messages,但不会重新对它们进行排序

一条message的offset是无法改变的(immutable),如果一条message缺失,则offset会直接被跳过

被删除的records在一段时间内仍然可以被consumers访问到,这段时间由参数delete.retention.ms(默认为24小时)控制

c.注意

需要注意的是:Kafka 本身是不会组织用户发送duplicate data的。

这些重复数据也仅会在一个segment在被commit 的时候做重复数据删除,

所以consumer仍会读取到这部分重复数据(如果客户端有发的话)。

-----------------------------------------------------------------------------------------------------

Log Compaction也会有时失败,compaction thread 可能会crash,

所以需要确保给Kafka server 足够的内存用于做这些操作。

如果log compaction异常,则需要重启Kafka(此为一个已知的bug)。

Log Compaction也无法通过API手动触发(至少到现在为止是这样),只能server端自动触发。

-----------------------------------------------------------------------------------------------------

正在写入的records仍会被写入Active Segment,已经committed segments会自动做compaction。

此过程会遍历所有segments中的records,并移除掉所有需要被移除的messages。

-----------------------------------------------------------------------------------------------------

Log compaction由上文提到的log.cleanup.policy=compact进行配置,其中:

Segment.ms(默认为7天):在关闭一个active segment前,所需等待的最长时间

Segment.bytes(默认为1G):一个segment的最大大小

Min.compaction .lag.ms(默认为0):在一个message可以被compact前,所需等待的时间

Delete.retention.ms(默认为24小时):在一条message被加上删除标记后,在实际删除前等待的时间

Min.Cleanable.dirty.ratio(默认为0.5):若是设置的更高,则会有更高效的清理,但是更少的清理操作触发。若是设置的更低,则清理的效率稍低,但是会有更多的清理操作被触发

2 Kafka介绍2

2.1 ISR、OSR、AR

00.汇总

ISR:In-Sync Replicas 副本同步队列

OSR:Out-of-Sync Replicas

AR:Assigned Replicas 所有副本

2.2 LEO、HW、LSO、LW

00.汇总

LEO:是 LogEndOffset 的简称,代表当前日志文件中下一条

HW:水位或水印(watermark)一词,也可称为高水位(high watermark),通常被用在流式处理领域(比如Apache Flink、Apache Spark等),以表征元素或事件在基于时间层面上的进度。在Kafka中,水位的概念反而与时间无关,而是与位置信息相关。严格来说,它表示的就是位置信息,即位移(offset)。取 partition 对应的 ISR中 最小的 LEO 作为 HW,consumer 最多只能消费到 HW 所在的位置上一条信息。

LSO:是 LastStableOffset 的简称,对未完成的事务而言,LSO 的值等于事务中第一条消息的位置(firstUnstableOffset),对已完成的事务而言,它的值同 HW 相同

LW:Low Watermark 低水位, 代表 AR 集合中最小的 logStartOffset 值。

2.3 Kafka简化流程

01.Producer

根据指定的 partition 方法(round-robin、hash等),将消息发布到指定 Topic 的 Partition 里面

02.Kafka集群

接收到 Producer 发过来的消息后,将其持久化到硬盘,并保留消息指定时长(可配置),而不关注消息是否被消费

03.Consumer

从 Kafka 集群 pull 数据,并控制获取消息的 offset 。至于消费的进度,可手动或者自动提交给 Kafka 集群

2.4 Kafka采用Pull/Push

00.设计

Kafka遵循了一种大部分消息系统共同的传统的设计:producer将消息推送到broker,consumer从broker拉取消息

2.5 Kafka传输事务级别

00.三种级别

a.最多一次

消息不会被重复发送,最多被传输一次,但也有可能一次不传输

b.最少一次

消息不会被漏发送,最少被传输一次,但也有可能被重复传输

c.精确的一次(Exactly once)

不会漏传输也不会重复传输,每个消息都被传输

2.6 Kafka实现高吞吐率

01.定义

Kafka是分布式消息系统,需要处理海量的消息,

Kafka的设计是把所有的消息都写入速度低容量大的硬盘,以此来换取更强的存储能力,

但实际上,使用硬盘并没有带来过多的性能损失

02.kafka主要使用了以下几个方式实现了超高的吞吐率

顺序读写

零拷贝

文件分段

批量发送

数据压缩

2.7 Kafka实现高可用?集群

01.Zookeeper部署2N+1节点

形成 Zookeeper 集群,保证高可用

02.Kafka Broker 部署集群

每个 Topic 的 Partition ,基于【副本机制】,在 Broker 集群中复制,形成 replica 副本,保证消息存储的可靠性

每个 replica 副本,都会选择出一个 leader 分区(Partition),提供给客户端(Producer 和 Consumer)进行读写

03.Kafka Producer 无需考虑集群

因为和业务服务部署在一起

Producer 从 Zookeeper 拉取到 Topic 的元数据后,

选择对应的 Topic 的 leader 分区,进行消息发送写入

而 Broker 根据 Producer 的 request.required.acks 配置

是写入自己完成就响应给 Producer 成功,还是写入所有 Broker 完成再响应

这个,就是胖友自己对消息的可靠性的选择

04.Kafka Consumer 部署集群

每个 Consumer 分配其对应的 Topic Partition ,根据对应的分配策略。并且,Consumer 只从 leader 分区(Partition)拉取消息。另外,当有新的 Consumer 加入或者老的 Consumer 离开,都会将 Topic Partition 再均衡,重新分配给 Consumer 。

2.8 ZooKeeper作用有哪些

00.在基于 Kafka 的分布式消息队列中,ZooKeeper 的作用有

1.Broker 在 ZooKeeper 中的注册。

2.Topic 在 ZooKeeper 中的注册。

3.Consumer 在 ZooKeeper 中的注册。

4.Producer 负载均衡。

5.Consumer 负载均衡。

6.记录消费进度 Offset 。

7.记录 Partition 与 Consumer 的关系。

3 Kafka组件

3.1 broker:进程

00.概念

每个kafka的机器节点都会运行一个进程,这个进程叫做broker,负责管理自身的topic和partition,

以及数据的存储和处理,因为kafka是集群形式的,所以一个集群中会存在多个broker,但是kafka的整体又不是一个主从集群,

需要选举出来一个broker节点为主节点,管理整个集群中所有的数据和操作,以及所有节点的协同工作。

每个broker上面都存在一个controller组件,这个组件就是主节点管理组件,负责整个集群的管理,

但是只有一个机器是active状态的,这个需要zookeeper进行协调和选举

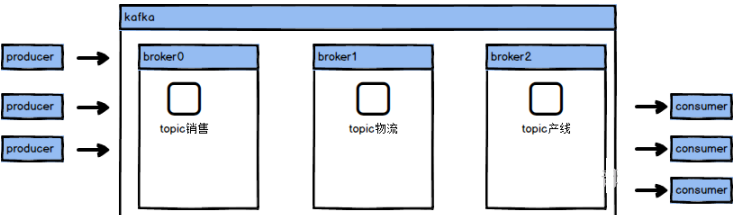

3.2 topic:主题

00.概念

在kafka中存在一个非常重要的逻辑结构叫做topic,可以称之为主题。当我们很多业务需要使用kafka进行消息队列的消息缓存

和处理的时候我们会将消息进行分类处理,不能让多种类的数据放入到一起,这样使用特别混乱,

所以topic主主题进行分类,是kafka数据处理的一大特色,可以类比现实中的主播。

一个主播在直播的时候都会创建一个自己的房间,每个主播都不会相互干扰。各自主播自己的内容。

3.3 partition:分区

00.概念

每个topic中在使用过程中会存储很多数据,这些数据如果默认只给一个broker进行处理,那么这个broker的压力会太大,

集群应该负载均衡让数据的压力在不同的机器上共同分摊,所以每个topic都会分为不同的分区,

一个分区是一个topic数据真正的物理存储方式,让数据分为不同的部分,在多个节点上存储和管理。

分区是kafka物理存储最小的负载均衡单位,生产者生产数据的时候指向多个分区,

消费者也可以在消费数据的时候从不同的分区读取数据

---------------------------------------------------------------------------------------------------------

每个broker节点会按照topic的名称和分区的名称组合在一起形成一个文件夹进行文件内容的存储,一个broker会管理多个topic的不同分区的数据

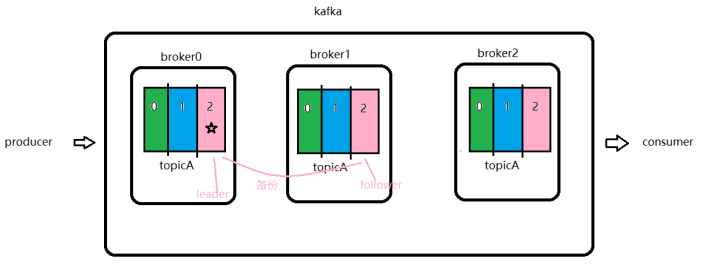

3.4 附:备份、主从

01.备份

在一个topic中存在多个分区,每个分区存储一部分这个topic的数据,但是因为存在多个机器上,不能够保证数据的稳定性,

所以数据需要进行备份管理,所以分区是存在备份的,

比如topicA的数据就需要存储多份在不同的机器上,这样数据损坏一份,其他的部分还可以使用

02.主从

数据在存储的时候需要备份多个,那么这些数据就要保证数据的一致性,所以我们不能再存放数据的时候随意的向任何副本写入,

因为这样集群中一个分区的多个副本没有办法保证数据的一致性,所以我们只能写入数据到一个副本,这个副本叫做主副本,

其他的副本会从主副本同步数据,从而保证数据的一致性,那么这个主从的选举是broker的主节点进行选举的和zookeeper没有关系

3.5 附:选举、生产、消费

00.总结

数据不管是生产者还是消费者,都是一条一条的操作,这个才是消息队列,这也是消息队列和hdfs等存储介质不同的地方,

消息队列更加偏向于流式处理,并不是整体存取

01.zookeeper

帮助选举broker为主,记录哪个是主broker,集群存在几个topic,

每个topic存在几个分区,分区存在几个副本,每个分区分别在哪个机器节点上

02.producer: 生产者

将数据远程发送到kafka集群,一般都是flume进行数据采集,并且发送到集群,

producer一般只能发送数据到一个topic中,和一个主播只能在自己的房间直播一样

03.consumer:消费者

消费数据并且参加计算处理,一般都是spark,flink等计算框架充当。

但是一个消费者可以同时消费多个分区的数据,就如一个观众可以一起看多个小姐姐直播一样

4 Kafka生产者

4.1 流程

01.步骤1

首先kafka启动以后所有的broker都会向zookeeper进行注册,在/brokers/ids中以列表的形式展示所有的节点,

在/controller节点中使用独享锁实现broker的选举,其中一个机器为主节点。

其他的为从节点,选举的根本原则就是谁先来的谁就是主节点

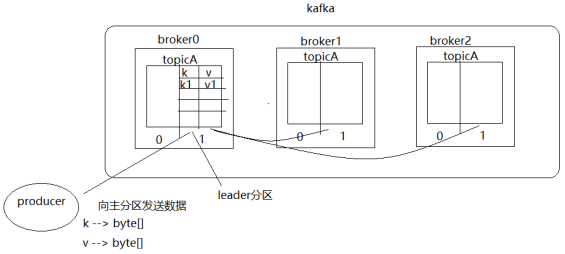

02.步骤2

broker0现在是controller节点,他会监听所有的broker节点的动态变化,然后选举出来所有的topic的分区的主从,

这个选举完毕以后,所有的操作都会指向主分区,不管是生产数据还是消费数据都是主分区在管理,从分区只是同步数据的

03.步骤3

broker0选举完毕以后将数据上传到zookeeper中,记录在/broker/topics这个目录中,具体的topic信息都会被其他的broker节点进行同步过去,多个broker都会识别选举出来的主从分区信息

其中在zookeeper中的ISR它是数据的传递优先级别顺序,如上图中数据的传输应该先到leader节点所在的机器4上面然后数据在同步到其他的从分区中,从而所有的分区数据都同步完毕保持一致

04.步骤4

数据生产和传输都会走主节点,topic正常对外提供服务

4.2 KV结构

01.介绍

kafka中的数据存储分为两个部分,分别是k-v两个部分,并且存储的数据都是二进制的,

我们在存储数据的时候要转换为二进制存储,使用的时候读出来也是二进制的,

我们需要人为转换成自己想要的数据类型才能使用,这个和hbase的存储及其相似,

但是其中的k一般我们都不会做任何操作,只放入value的值

02.注意

虽然数据分为k-v两个部分,但是不要把它当成map集合,相同的key的数据value不会被去重掉

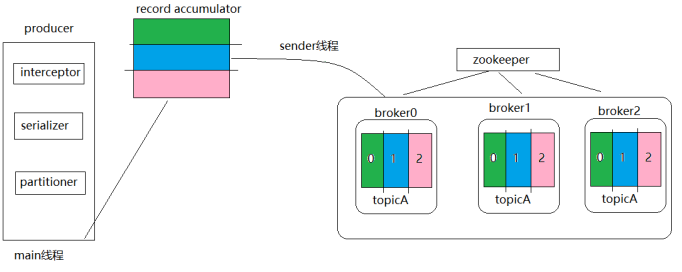

4.3 整体结构

01.生产者部分的整体流程

首先producer将发送的数据准备好

经过interceptor的拦截器进行处理,如果有的话

然后经过序列化器进行转换为相应的byte[]

经过partitioner分区器分类在本地的record accumulator中缓冲

sender线程会自动根据linger.ms和batch-size双指标进行管控,复制数据到kafka

02.producer:生产者

它由三个部分组成

interceptor:拦截器,能拦截到数据,处理完毕以后发送给下游,它和过滤器不同并不是丢弃数据,而是将数据处理完毕再次发送出去,这个默认是不存在的

serialiazer:序列化器,kafka中存储的数据是二进制的,所以数据必须经过序列化器进行处理,这个是必须要有的,将用户的数据转换为byte[]的工具类,其中k和v要分别指定

partitioner: 分区器,主要是控制发送的数据到topic的哪个分区中,这个默认也是存在的

03.record accumulator

本地缓冲累加器 默认32M

---------------------------------------------------------------------------------------------------------

producer的数据不能直接发送到kafka集群中,因为producer和kafka集群并不在一起,

远程发送的数据不是一次发送一条这样太影响发送的速度和性能,所以我们发送都是攒一批数据发一次,

record accumulator就是一个本地缓冲区,producer将发送的数据放入到缓冲区中,另外一个线程会去拉取其中的数据,

远程发送给kafka集群,这个异步线程会根据linger.ms和batch-size进行拉取数据。如果本地累加器中的数据达到

batch-size或者是linger.ms的大小阈值就会拉取数据到kafka集群中,这个本地缓冲区不仅仅可以适配两端的效率,

还可以批次形式执行任务,增加效率

---------------------------------------------------------------------------------------------------------

batch-size 默认16KB

linger.ms 默认为0

4.4 producer确认机制

01.介绍

主线程将数据放入到本地累加器中record accumulator中进行存储,sender线程会异步的拉取数据到kafka集群中,

这个数据拉取并且复制到kafka集群中以后,kafka需要返回给sender线程一个确认应答ack这个确认应答用于

在sender线程中进行判定sender线程是否复制拉取数据成功,如果我们在producer中设定了retries开关,

那么失败以后sender线程还会多次重新复制尝试拉取数据

---------------------------------------------------------------------------------------------------------

其中失败尝试和producer端没有任何关系,producer端只是将数据放入到本地累加器中而已,失败尝试是由sender线程重新尝试的

ack的级别:

ack = 0 ;sender线程认为拉取过去的数据kafka一定会收到

ack = 1 ; sender线程拉取过去的数据leader节点接收到,并且存储到自己的本地,然后在返回ack

ack = -1 ; sender线程拉取数据,leader节点收到存储到本地,所有follower节点全部都接收到并且存储到本地这个时候leader返回ack

---------------------------------------------------------------------------------------------------------

综上所述ack = -1的级别是数据稳定性最高的,因为能够保证数据全部都同步完毕再返回给sender线程

02.带有确认应答的代码:

其中回调函数中的metadata对象可以知道发送数据到哪里了,exception用于区分是不是本条数据发送成功

但是这个回调函数不能做出任何的反馈操作,只能起到通知的作用

---------------------------------------------------------------------------------------------------------

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.*;

import org.apache.kafka.common.serialization.StringSerializer;

import java.util.Properties;

public class ProducerWithCallBack {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

//设定ack,在代码中ack的级别存在三种 0 1 all

pro.put(ProducerConfig.ACKS_CONFIG, "all");

//设定重试次数

pro.put(ProducerConfig.RETRIES_CONFIG,3 );

pro.put(ProducerConfig.BATCH_SIZE_CONFIG, 16*1024);

pro.put(ProducerConfig.LINGER_MS_CONFIG, 0);

KafkaProducer<String, String> producer = new KafkaProducer<String, String>(pro);

ProducerRecord<String, String> record = new ProducerRecord<>("topic_a", "this is hainiu");

for(int i=0;i<5;i++){

producer.send(record, new Callback() {

//发送方法中增加回调代码

@Override

public void onCompletion(RecordMetadata metadata, Exception exception) {

//metadata中包含所有的发送数据的元数据信息

//哪个topic的那个分区的第几个数据

String topic = metadata.topic();

int partition = metadata.partition();

long offset = metadata.offset();

if(exception == null ){

System.out.println("success"+" "+topic+" "+partition+" "+offset);

}else{

System.out.println("fail"+" "+topic+" "+partition+" "+offset);

}

}

});

}

producer.close();

}

}

4.5 producer自定义拦截器

01.介绍

interceptor是拦截器,可以拦截到发送到kafka中的数据进行二次处理,它是producer组成部分的第一个组件

实现拦截器需要实现ProducerInterceptor这个接口,其中的泛型要和producer端发送的数据的类型一致

---------------------------------------------------------------------------------------------------------

onSend方法是最主要的方法用户拦截数据并且处理完毕发送 onAcknowledgement 获取确认应答的方法,

这个方法和producer端的差不多,只能知道结果通知 close是执行完毕拦截器最后执行的方法 configure方法是用于获取配置文件信息的方法

02.实现基于场景是获取到producer端的数据然后给数据加上时间戳

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.*;

import org.apache.kafka.common.serialization.StringSerializer;

import java.util.Date;

import java.util.Map;

import java.util.Properties;

public class ProducerWithInterceptor {

public static class MyInterceptor implements ProducerInterceptor<String,String>{

@Override

public ProducerRecord<String, String> onSend(ProducerRecord<String, String> record) {

String value = record.value();

Long time = new Date().getTime();

String topic = record.topic();

//获取原始数据并且构建新的数据,增加时间戳信息

return new ProducerRecord<String,String>(topic,time+"-->"+value);

}

@Override

public void onAcknowledgement(RecordMetadata metadata, Exception exception) {

//获取确认应答和producer端的代码逻辑相同

String topic = metadata.topic();

int partition = metadata.partition();

long offset = metadata.offset();

if(exception == null ){

System.out.println("success"+" "+topic+" "+partition+" "+offset);

}else{

System.out.println("fail"+" "+topic+" "+partition+" "+offset);

}

}

@Override

public void close() {

//不需要任何操作

//no op

}

@Override

public void configure(Map<String, ?> configs) {

//不需要任何操作

//no op

}

}

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.ACKS_CONFIG, "all");

pro.put(ProducerConfig.RETRIES_CONFIG,3 );

pro.put(ProducerConfig.BATCH_SIZE_CONFIG, 16*1024);

pro.put(ProducerConfig.LINGER_MS_CONFIG, 0);

pro.put(ProducerConfig.INTERCEPTOR_CLASSES_CONFIG,MyInterceptor.class.getName());

//设定拦截器

KafkaProducer<String, String> producer = new KafkaProducer<String, String>(pro);

ProducerRecord<String, String> record = new ProducerRecord<>("topic_a", "this is hainiu");

for(int i=0;i<5;i++){

producer.send(record, new Callback() {

@Override

public void onCompletion(RecordMetadata metadata, Exception exception) {

String topic = metadata.topic();

int partition = metadata.partition();

long offset = metadata.offset();

if(exception == null ){

System.out.println("success"+" "+topic+" "+partition+" "+offset);

}else{

System.out.println("fail"+" "+topic+" "+partition+" "+offset);

}

}

});

}

producer.close();

}

}

---------------------------------------------------------------------------------------------------------

1674968729541-->this is hainiu

1674968729969-->this is hainiu

1674968729969-->this is hainiu

1674968729969-->this is hainiu

1674968729969-->this is hainiu

---------------------------------------------------------------------------------------------------------

在客户端消费者中可以打印出来信息带有时间戳

拦截器一般很少人为定义,比如一般producer在生产环境中都是有flume替代,一般flume会设定自己的时间戳拦截器,指定数据采集时间,相比producer更加方便实用

4.6 producer自定义序列化器

01.介绍

kafka中的数据存储是二进制的byte数组形式,所以我们在存储数据的时候要使用序列化器进行数据的转换,序列化器的结构要和存储数据的kv的类型一致

02.实现系统的String类型序列化器

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.*;

import org.apache.kafka.common.serialization.Serializer;

import org.apache.kafka.common.serialization.StringSerializer;

import java.nio.charset.StandardCharsets;

import java.util.Map;

import java.util.Properties;

public class ProducerWithSerializer {

public static void main(String[] args) {

Properties pro = new Properties();

//bootstrap-server key value batch-size linger.ms ack retries interceptor

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,MyConfig.BOOTSTRAP_SERVERS);

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, MyStringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, MyStringSerializer.class.getName());

pro.put(ProducerConfig.BATCH_SIZE_CONFIG,MyConfig.BATCH_SIZE);

pro.put(ProducerConfig.LINGER_MS_CONFIG,MyConfig.LINGER_MS);

pro.put(ProducerConfig.ACKS_CONFIG,MyConfig.ACK);

pro.put(ProducerConfig.RETRIES_CONFIG,MyConfig.RETRIES);

KafkaProducer<String, String> producer = new KafkaProducer<String, String>(pro);

for (int i = 0; i < 100; i++) {

ProducerRecord<String, String> record = new ProducerRecord<>("topic_a", "hainiu","message_" + i);

producer.send(record);

}

producer.close();

}

public static class MyStringSerializer implements Serializer<String>{

@Override

public byte[] serialize(String topic, String data) {

return data.getBytes(StandardCharsets.UTF_8);

}

}

}

03.序列化对象整体

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.common.serialization.Serializer;

import org.apache.kafka.common.serialization.StringSerializer;

import java.io.ByteArrayOutputStream;

import java.io.IOException;

import java.io.ObjectOutputStream;

import java.io.Serializable;

import java.nio.charset.StandardCharsets;

import java.util.Properties;

/**

* producerRecord==> key:string,value:student

*/

public class ProducerWithStudentSerializer {

public static class Student implements Serializable{

private int id;

private String name;

private int age;

public int getId() {

return id;

}

public void setId(int id) {

this.id = id;

}

public String getName() {

return name;

}

public void setName(String name) {

this.name = name;

}

public int getAge() {

return age;

}

public void setAge(int age) {

this.age = age;

}

public Student() {

}

public Student(int id, String name, int age) {

this.id = id;

this.name = name;

this.age = age;

}

}

public static class MyStudentSerializer implements Serializer<Student>{

@Override

public byte[] serialize(String topic, Student data) {

ByteArrayOutputStream byteOS = null;

ObjectOutputStream objectOS = null;

try {

byteOS =new ByteArrayOutputStream();

objectOS = new ObjectOutputStream(byteOS);

objectOS.writeObject(data);

} catch (IOException e) {

throw new RuntimeException(e);

}finally {

try {

byteOS.close();

objectOS.close();

} catch (IOException e) {

throw new RuntimeException(e);

}

}

return byteOS.toByteArray();

}

}

public static void main(String[] args) {

Properties pro = new Properties();

//bootstrap-server key value batch-size linger.ms ack retries interceptor

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,MyConfig.BOOTSTRAP_SERVERS);

pro.put(ProducerConfig.BATCH_SIZE_CONFIG,MyConfig.BATCH_SIZE);

pro.put(ProducerConfig.LINGER_MS_CONFIG,MyConfig.LINGER_MS);

pro.put(ProducerConfig.ACKS_CONFIG,MyConfig.ACK);

pro.put(ProducerConfig.RETRIES_CONFIG,MyConfig.RETRIES);

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG,MyStudentSerializer.class.getName());

KafkaProducer<String, Student> producer = new KafkaProducer<>(pro);

Student s1 = new Student(1, "zhangsan", 20);

Student s2 = new Student(2, "lisi", 30);

ProducerRecord<String, Student> r1 = new ProducerRecord<>("topic_a", "hainiu", s1);

ProducerRecord<String, Student> r2 = new ProducerRecord<>("topic_a", "hainiu", s2);

producer.send(r1);

producer.send(r2);

producer.close();

}

}

04.实现serialize的方法用于将数据对象转换为二进制的数组

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.common.serialization.Serializer;

import org.apache.kafka.common.serialization.StringSerializer;

import java.nio.charset.Charset;

import java.util.Properties;

public class Producer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

//key因为没有放入任何值,所以序列化器使用原生的就可以

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StudentSeria.class.getName());

//value的序列化器需要指定相应的student序列化器

pro.put(ProducerConfig.BATCH_SIZE_CONFIG, 16*1024);

pro.put(ProducerConfig.LINGER_MS_CONFIG, 0);

KafkaProducer<String, Student> producer = new KafkaProducer<String, Student>(pro);

//producer生产的数据类型也必须是string,student类型的kv

Student student = new Student(1, "zhangsan", 30);

ProducerRecord<String, Student> record = new ProducerRecord<>("topic_a", student);

producer.send(record);

producer.close();

}

public static class Student{

private int id;

private String name;

private int age;

public int getId() {

return id;

}

public Student() {

}

public void setId(int id) {

this.id = id;

}

public String getName() {

return name;

}

public void setName(String name) {

this.name = name;

}

public int getAge() {

return age;

}

public void setAge(int age) {

this.age = age;

}

public Student(int id, String name, int age) {

this.id = id;

this.name = name;

this.age = age;

}

}

public static class StudentSeria implements Serializer<Student> {

@Override

public byte[] serialize(String topic, Student data) {

String line =data.getId()+" "+data.getName()+" "+data.getAge();

//获取student对象中的所有数据信息

return line.getBytes(Charset.forName("utf-8"));

//转换为byte数组返回

}

}

}

4.7 producer自定义分区器

01.介绍

首先在kafka存储数据的时候topic中的数据是分为多个分区进行存储的,topic设定分区的好处是可以进行分布式存储和分布式管理,

那么好的分区器可以让数据尽量均匀的分布到不同的机器节点,数据更加均匀,那么kafka中的分区器是如果实现的呢?

---------------------------------------------------------------------------------------------------------

根据图我们可以看出数据首先通过分区器进行分类,在本地的累加器中进行存储缓存,

然后在复制到kafka集群中,所以分区器产生作用的位置在本地的缓存之前

02.原理

a.kafka的分区规则是如何实现的呢

ProducerRecord<String, Student> record = new ProducerRecord<>("topic_a", student);

producer.send(record);

b.kafka的生产者数据发送是通过上面的方法实现的

首先要构造一个ProducerRecord对象,然后通过producer.send来进行发送数据,其中ProducerRecord对象的构造器种类分为以下几种

/**

* Creates a record to be sent to a specified topic and partition

*

* @param topic The topic the record will be appended to

* @param partition The partition to which the record should be sent

* @param key The key that will be included in the record

* @param value The record contents

*/

public ProducerRecord(String topic, Integer partition, K key, V value) {

this(topic, partition, null, key, value, null);

}

/**

* Create a record to be sent to Kafka

*

* @param topic The topic the record will be appended to

* @param key The key that will be included in the record

* @param value The record contents

*/

public ProducerRecord(String topic, K key, V value) {

this(topic, null, null, key, value, null);

}

/**

* Create a record with no key

*

* @param topic The topic this record should be sent to

* @param value The record contents

*/

public ProducerRecord(String topic, V value) {

this(topic, null, null, null, value, null);

}

c.分区策略

我们想要发送一个数据到kafka的时候可以构造以上的ProducerRecord但是构造的方式却不同,

大家可以发现携带的参数也有所不同,当携带不同参数的时候数据会以什么样的策略发送出去呢,

这个时候需要引入一个默认分区器,就是在用户没有指定任何规则的时候系统自带的分区器规则

-----------------------------------------------------------------------------------------------------

在producerConfig对象中我们可以看到源码指示,如果没有任何人为分区器规则指定,那么默认使用的DefaultPartitioner的规则

而打开DefaultPartitioner以后可以看到他的分区器规则,就是在构建ProducerRecord的时候

new ProducerRecord(topic,partition,k,v);

//指定分区直接发送数据到相应分区中

new ProducerRecord(topic,k,v);

//没有指定分区就按照k的hashcode发送到不同分区

new ProducerRecord(topic,v);

//如果k和partition都没有指定就使用粘性分区

-----------------------------------------------------------------------------------------------------

这个逻辑可以在DefaultPartitioner中看到

partition方法中,如果key为空就放入到粘性缓冲中,它的意思就是如果满足batch-size或者linger.ms就会触发应用执行,

将数据复制到kafka中,并且再次随机到其他分区,所以简单来说粘性分区就是可一个分区放入数据,一旦满了以后才会改变分区,

粘性分区规则使用主要是为了让每次复制数据更加快捷方便都赋值到一个分区中

-----------------------------------------------------------------------------------------------------

而如果key不为空那么就按照hashcode值进行取余处理,以上就是kafka的分区策略

我们也可以认为设定自己的分区器规则来替换kafka的分区器

03.三种分区器

a.默认分区器的规则DefaultPartitioner

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.common.serialization.Serializer;

import org.apache.kafka.common.serialization.StringSerializer;

import java.nio.charset.Charset;

import java.util.Properties;

public class Producer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.BATCH_SIZE_CONFIG, 16*1024);

pro.put(ProducerConfig.LINGER_MS_CONFIG, 0);

KafkaProducer<String, String> producer = new KafkaProducer<>(pro);

ProducerRecord<String, String> record = new ProducerRecord<>("topic_a", 0, null, "aaaa");

//创建对象指定分区

producer.send(record);

producer.close();

}

}

-----------------------------------------------------------------------------------------------------

kafka-console-consumer.sh --topic new-topic --bootstrap-server 192.168.185.150:9092 --from-beginning --partition 2

指定分区0进行消费数据,可以得到数据相应位置

b.不指定分区,携带key 111的hashcode值274292042,使用这个值和分区数4取余得出相应的分区编号为2

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.common.serialization.Serializer;

import org.apache.kafka.common.serialization.StringSerializer;

import org.apache.kafka.common.utils.Utils;

import java.nio.charset.Charset;

import java.util.Properties;

public class Producer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.BATCH_SIZE_CONFIG, 16*1024);

pro.put(ProducerConfig.LINGER_MS_CONFIG, 0);

KafkaProducer<String, String> producer = new KafkaProducer<>(pro);

ProducerRecord<String, String> record = new ProducerRecord<>("topic_a", "111", "111");

producer.send(record);

producer.close();

}

}

-----------------------------------------------------------------------------------------------------

可以看出数据的计算是没有问题的,按照k的hashcode值进行分发

c.没有增加partition和key的时候会按照粘性分区规则进行分配

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.*;

import org.apache.kafka.common.serialization.Serializer;

import org.apache.kafka.common.serialization.StringSerializer;

import org.apache.kafka.common.utils.Utils;

import java.nio.charset.Charset;

import java.util.Properties;

public class Producer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.BATCH_SIZE_CONFIG, 16*1024);

pro.put(ProducerConfig.LINGER_MS_CONFIG, 0);

KafkaProducer<String, String> producer = new KafkaProducer<>(pro);

for (int i = 0; i < 5; i++) {

ProducerRecord<String, String> record = new ProducerRecord<>("topic_a", "hahahaha");

producer.send(record, new Callback() {

@Override

public void onCompletion(RecordMetadata metadata, Exception exception) {

String topic = metadata.topic();

int partition = metadata.partition();

System.out.println(topic+"-->"+partition);

}

});

}

producer.close();

}

}

-----------------------------------------------------------------------------------------------------

我们没有指定任何分区和key,默认分区器会自动随机一个分区。然后数据以粘性的方式分发到不同的分区中

04.自定义分区器

a.背景

我们可以人为定义分区器的规则来替换原生分区器的规则,因为在很多时候默认分区器的规则都不适用于业务场景

b.程序背景

使用producer采集本地数据并且发送到不同的分区中,按照每个专业的类别将数据分发到不同的分区

-----------------------------------------------------------------------------------------------------

# 首先创建topic名称为teacher,设定分区数量为spark和java两个分区

kafka-topics.sh --bootstrap-server nn1:9092 --create --topic teacher --partitions 6 --replication-factor 2

# 创建一个data/teacher.txt 放入老师的访问数据,然后分类发送

http://spark.hainiubl.com/unclewang

http://spark.hainiubl.com/unclewang

http://spark.hainiubl.com/xiaohe

http://spark.hainiubl.com/xiaohe

http://spark.hainiubl.com/laoyang

http://spark.hainiubl.com/laoyang

http://java.hainiubl.com/laochen

http://java.hainiubl.com/laochen

http://java.hainiubl.com/laoliu

http://java.hainiubl.com/laoliu

-----------------------------------------------------------------------------------------------------

实现思路就是采集数据然后将数据按照专业分类,分别发送到不同的分区中

-----------------------------------------------------------------------------------------------------

自定分区器逻辑

public static class MyPartitioner implements Partitioner{

@Override

public int partition(String topic, Object key, byte[] keyBytes, Object value, byte[] valueBytes, Cluster cluster) {

return 0;

}

@Override

public void close() {

}

@Override

public void configure(Map<String, ?> configs) {

}

}

-----------------------------------------------------------------------------------------------------

自定义分区器要实现Partitioner接口

其中Partition方法是最重要的方法,可以根据不同的数据发送到不同的分区

close方法是关闭时候执行的方法一般不做任何操作

configure方法是获取配置文件的方法,一般也不做任何操作

c.在partition方法中得到value值中是否包含spark或者java,然后分类发送

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.*;

import org.apache.kafka.common.Cluster;

import org.apache.kafka.common.serialization.StringSerializer;

import org.apache.kafka.common.utils.Utils;

import java.io.FileInputStream;

import java.net.URL;

import java.util.*;

public class ProducerWithUDPartitioner {

public static class MyTeacherPartitioner implements Partitioner{

List<String> list = Arrays.asList(

"unclewang",

"xiaohe",

"laoyang",

"laochen",

"laoliu",

"laozhang"

);

@Override

public int partition(String topic, Object key, byte[] keyBytes, Object value, byte[] valueBytes, Cluster cluster) {

String valueStr = value.toString();

return list.indexOf(valueStr);

}

@Override

public void close() {

//no - op

}

@Override

public void configure(Map<String, ?> configs) {

// no - op

}

}

public static void main(String[] args) throws Exception{

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.PARTITIONER_CLASS_CONFIG,MyTeacherPartitioner.class.getName());

KafkaProducer<String, String> producer = new KafkaProducer<String, String>(pro);

FileInputStream in = new FileInputStream("data/teacher.txt");

Scanner sc = new Scanner(in);

while(sc.hasNext()){

String line = sc.nextLine();

URL url = new URL(line);

String host = url.getHost();

String path = url.getPath();

String subject = host.split("\\.")[0];

String teacher = path.substring(1);

ProducerRecord<String, String> record = new ProducerRecord<>("teacher", subject, teacher);

producer.send(record, new Callback() {

@Override

public void onCompletion(RecordMetadata metadata, Exception exception) {

if(exception == null){

System.out.println(metadata.topic()+"-->"+metadata.partition()+"-->"+record.key()+"-->"+record.value());

}else{

System.out.println("fail");

}

}

});

}

producer.close();

}

}

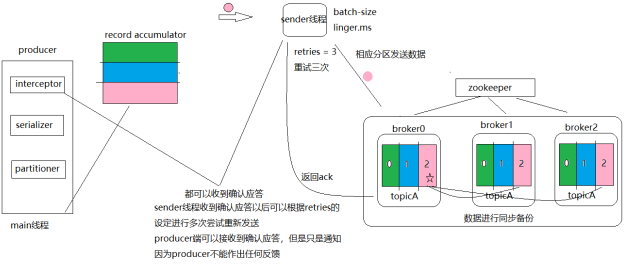

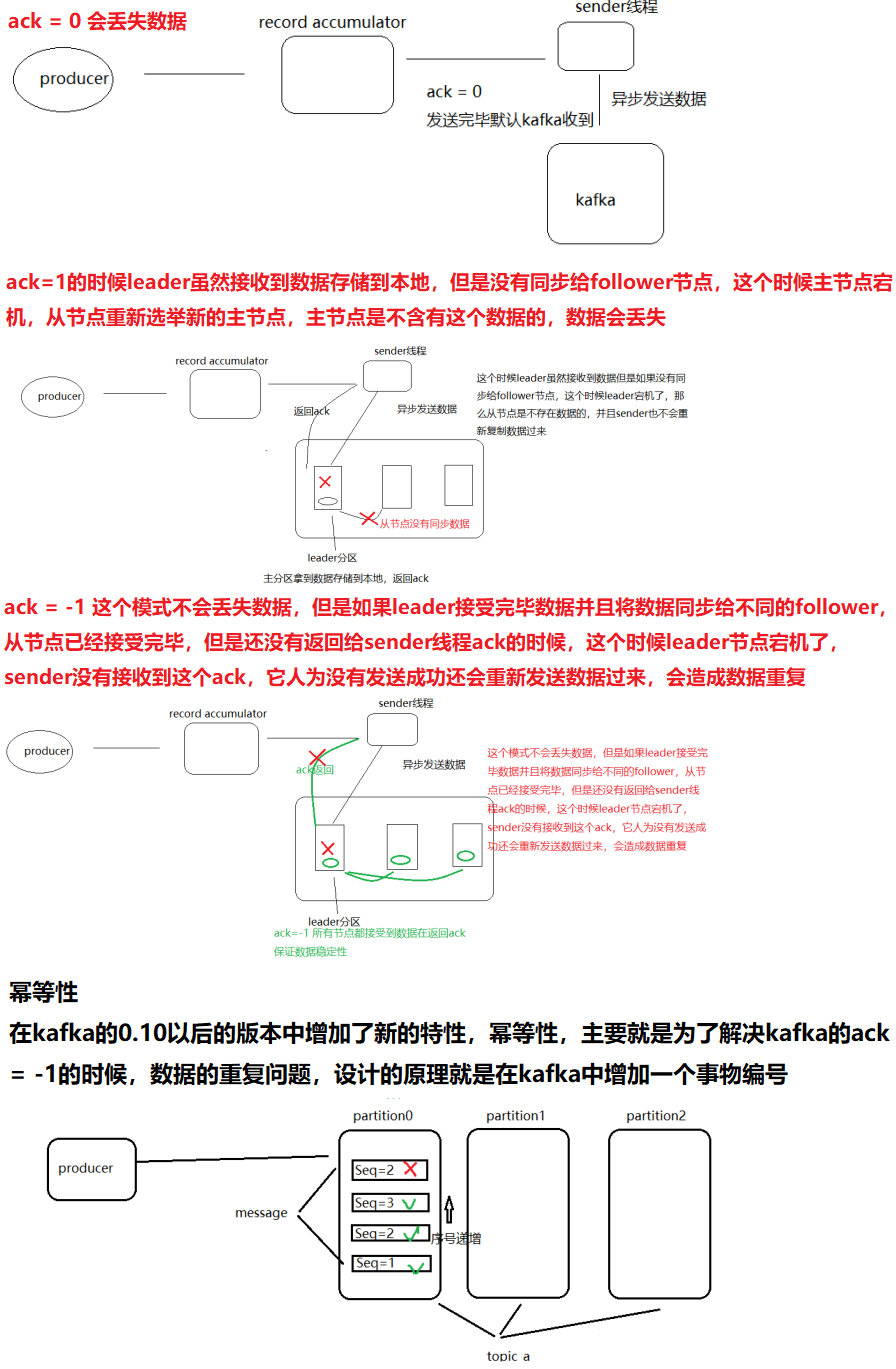

4.8 producer一致性和ACK

01.介绍

kafka是存在确认应答机制的,也就是数据在发送到kafka的时候,kafka会回复一个确认信息,这个确认信息是存在等级的

ack=0 这个等级是最低的,这个级别中数据sender线程复制完毕数据默认人为kafka已经接收到数据

ack=1 这个级别中,sender线程复制完毕数据leader分区拿到数据放入到自己的存储并且返回确认信息

ack=-1 这个级别比较重要,sender线程复制完毕数据,主分区接受完毕数据并且从分区都同步完毕数据然后在返回确认信息

---------------------------------------------------------------------------------------------------------

ack=0 会丢失数据

ack=1 的时候leader虽然接收到数据存储到本地,但是没有同步给follower节点,这个时候主节点宕机,从节点重新选举新的主节点,主节点是不含有这个数据的,数据会丢失

ack=-1 这个模式不会丢失数据,但是如果leader接受完毕数据并且将数据同步给不同的follower,从节点已经接受完毕,但是还没有返回给sender线程ack的时候,这个时候leader节点宕机了,sender没有接收到这个ack,它人为没有发送成功还会重新发送数据过来,会造成数据重复

---------------------------------------------------------------------------------------------------------

acks=0: 表示生产者不需要等待任何 broker 的确认,可能导致数据丢失。

acks=1: 表示生产者只等待领导者 broker 的确认,若领导者在确认后崩溃则可能丢失数据。

acks=all: 表示生产者会等待所有副本的确认,这样可以确保数据不会丢失,但延迟可能较大。

一般前两种都适合在数据并不是特别重要的时候使用,而最后一种效率会比较低下,但是适用于可靠性比较高的场景使用

所以一般使用我们都会使用ack = -1 retries = N 联合在一起使用

02.一致性语义

在大数据场景中存在三种时间语义,分别为

At Least Once 至少一次,数据至少一次,可能会重复

At Most Once 至多一次,数据至多一次,可能会丢失

Exactly Once 精准一次,有且只有一次,准确的消息传输

---------------------------------------------------------------------------------------------------------

那么针对于以上我们学习了ack已经幂等性以及事物

所以我们做以下分析:

如果设定ack = 0 或者是 1 出现的语义就是At Most Once 会丢失数据

如果设定ack = - 1 会出现At Least Once 数据的重复

在ack = -1的基础上开启幂等性会解决掉数据重复问题,但是不能保证一个批次的数据整体一致,所以还要开启事物才可以

03.幂等性

在kafka的0.10以后的版本中增加了新的特性,幂等性,主要就是为了解决kafka的ack = -1的时候,数据的重复问题,设计的原理就是在kafka中增加一个事物编号

数据在发送的时候在单个分区中的seq事物编号是递增的,如果重复的在一个分区中多次插入编号一致的两个信息,那么这个数据会被去重掉

在单个分区中序号递增,也就是我们开启幂等性也只能保证单个分区的数据是可以去重的

---------------------------------------------------------------------------------------------------------

整体代码如下:

pro.put(ProducerConfig.RETRIES_CONFIG,3);

pro.put(ProducerConfig.ENABLE_IDEMPOTENCE_CONFIG,true);

---------------------------------------------------------------------------------------------------------

设定retries = 3 ,enable.idempotence = true

幂等性开启的时候,ack默认设定为-1

幂等性的工作原理很简单,每条消息都有一个「主键」,这个主键由 <PID, Partition, SeqNumber> 组成,他们分别是:

PID:ProducerID,每个生产者启动时,Kafka 都会给它分配一个 ID,ProducerID 是生产者的唯一标识,需要注意的是,Kafka 重启也会重新分配 PID

Partition:消息需要发往的分区号

SeqNumber:生产者,他会记录自己所发送的消息,给他们分配一个自增的 ID,这个 ID 就是 SeqNumber,是该消息的唯一标识

对于主键相同的数据,Kafka 是不会重复持久化的,它只会接收一条,但由于是原理的限制,

幂等性也只能保证单分区、单会话内的数据不重复,

如果 Kafka 挂掉,重新给生产者分配了 PID,还是有可能产生重复的数据,这就需要另一个特性来保证了--Kafka事务

4.9 附:参数调整

01.参数

参数 调节

buffer.memory record accumulator的大小,适当增加可以保证producer的速度,默认32M

batch-size 异步线程拉取的批次大小,适当增加可以提高效率,但是会增加延迟性

linger.ms 异步线程等待时长一般根据生产效率而定,不建议太大增加延迟效果

acks 确认应答一般设定为-1,保证数据不丢失

enable.idempotence 开启幂等性保证数据去重,实现exactly once语义

retries 增加重试次数,保证数据的稳定性

compression.type 增加producer端的压缩

max.in.flight.requests.per.connection sender线程异步复制数据的阻塞次数,当没收到kafka的ack之前可以最多发送五个写入请求,调节这个参数可以保证数据的有序性

02.代码

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.common.serialization.StringSerializer;

import java.util.Properties;

public class ProducerWithMultiConfig {

public static void main(String[] args) throws InterruptedException {

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.BATCH_SIZE_CONFIG, 16*1024);

pro.put(ProducerConfig.LINGER_MS_CONFIG, 100);

pro.put(ProducerConfig.BUFFER_MEMORY_CONFIG, 1024*1024*64);

pro.put(ProducerConfig.ENABLE_IDEMPOTENCE_CONFIG, true);

pro.put(ProducerConfig.RETRIES_CONFIG, 3);

pro.put(ProducerConfig.COMPRESSION_TYPE_CONFIG, "snappy");

pro.put(ProducerConfig.MAX_IN_FLIGHT_REQUESTS_PER_CONNECTION, 5);

KafkaProducer<String, String> producer = new KafkaProducer<String, String>(pro);

ProducerRecord<String, String> record = new ProducerRecord<>("topic_a", "this is hainiu");

producer.send(record);

producer.close();

}

}

---------------------------------------------------------------------------------------------------------

其中max.in.flight.requests.per.connection参数设定后可以增加producer的阻塞大小

在未开启幂等性的时候,这个值设定为1,可以保证单个批次的数据有序,在分区内部有序

如果开启了幂等性可以设定最大值不超过5,可以保证五个request请求单个分区内有序

---------------------------------------------------------------------------------------------------------

因为没有开启幂等性的时候如果第一个请求失败,第二个请求重新发送的时候需要二次排序

要是开启幂等性了会保留原来的顺序性,不需要重新排序

总而言之kafka可以保证单分区有序但是整体是无序的

5 Kafka消费者

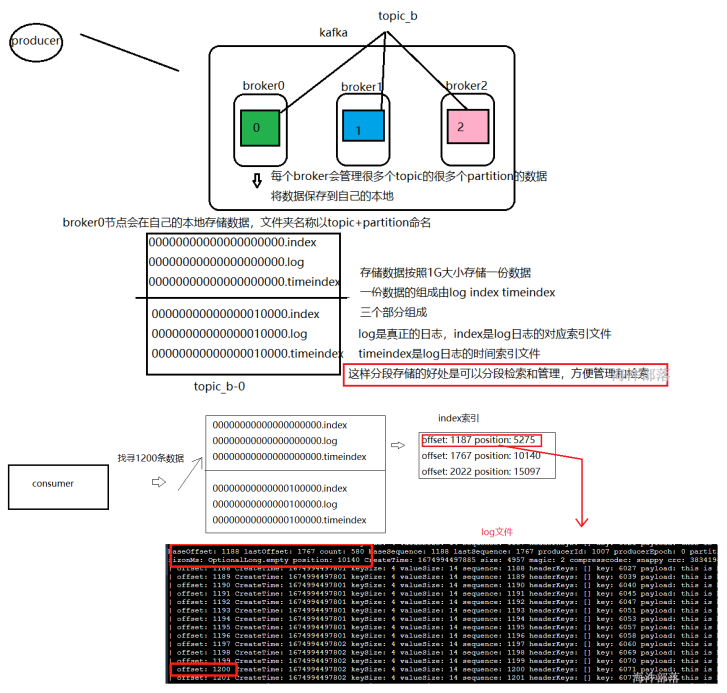

5.1 存储结构

01.介绍

这些数据可以在服务器集群上对应的文件夹中查看到

每个文件夹以topic+partition进行命名,更加便于管理和查询检索,

因为kafka的数据都是按照条进行处理和流动的一般都是给流式应用做数据供给和缓冲,

所以检索速度必须要快,分块管理是最好的方式

02.消费者在检索相应数据的时候会非常的简单

consumer检索数据的过程

首先文件的存储是分段的,那么文件的名称代表的就是这个文件中存储的数据范围和条数

00000000000000000000.index

00000000000000000000.log

00000000000000000000.timeindex 代表存储的数据是从0条开始的

00000000000000100000.index

00000000000000100000.log

00000000000000100000.timeindex 代表存储的数据是从100000条开始的

所以首先检索数据的时候就可以跳过1G为大小的块,比如检索888这条数据的,就可以直接去00000000000000000000.log中查询数据

那么查询数据还是需要在1G大小的内容中找寻是比较麻烦的,这个时候可以从index索引出发去检索,首先我们可以通过kafka提供的工具类去查看log和index中的内容

03.代码实现

# 首先创建一个topic_b

kafka-topics.sh --bootstrap-server nn1:9092 --create --topic topic_b --partitions 5 --replication-factor 2

---------------------------------------------------------------------------------------------------------

# 然后通过代码随机向不同的分区中分发不同的数据1W条

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.common.serialization.StringSerializer;

import java.util.Properties;

public class ProducerWithMultiConfig {

public static void main(String[] args) throws InterruptedException {

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.BATCH_SIZE_CONFIG, 16*1024);

pro.put(ProducerConfig.LINGER_MS_CONFIG, 100);

pro.put(ProducerConfig.BUFFER_MEMORY_CONFIG, 1024*1024*64);

pro.put(ProducerConfig.ENABLE_IDEMPOTENCE_CONFIG, true);

pro.put(ProducerConfig.RETRIES_CONFIG, 3);

pro.put(ProducerConfig.COMPRESSION_TYPE_CONFIG, "snappy");

pro.put(ProducerConfig.MAX_IN_FLIGHT_REQUESTS_PER_CONNECTION, 5);

KafkaProducer<String, String> producer = new KafkaProducer<String, String>(pro);

for (int i = 0; i < 10000; i++) {

ProducerRecord<String, String> record = new ProducerRecord<>("topic_b", ""+i,"this is hainiu");

producer.send(record);

}

producer.close();

}

}

---------------------------------------------------------------------------------------------------------

# kafka查看日志和索引的命令

kafka-run-class.sh kafka.tools.DumpLogSegments --files xxx

---------------------------------------------------------------------------------------------------------

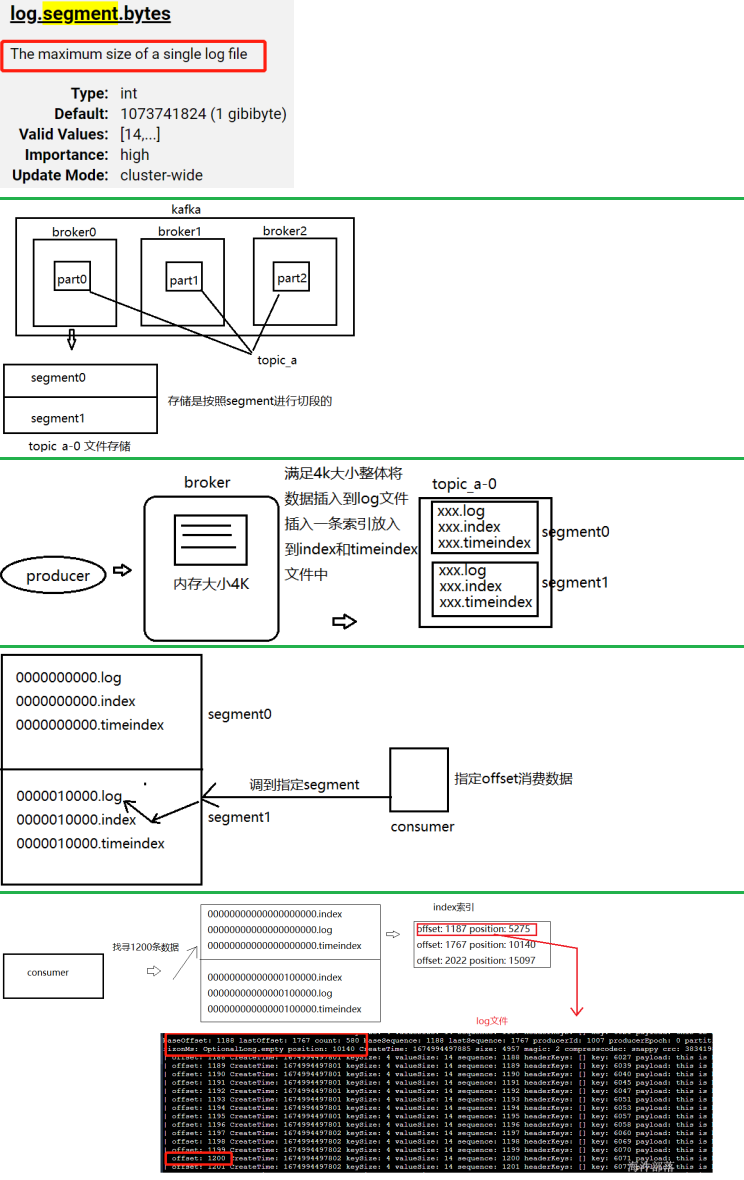

index索引

offset第几条 position物理偏移量位置,也就是第几个字

1187 5275

1767 10140

2022 15097

log日志

# 打印日志内容的命令 --print-data-log 打印数据

kafka-run-class.sh kafka.tools.DumpLogSegments --files 00000000000000000000.log --print-data-log

# 可以看到刷写的日志

baseOffset: 1768 lastOffset: 2022 count: 255

从1768到2022条一次性刷写255条

lastSequence: 2022 producerId: 1007 position: 15097

刷写事物日志编号,生产者的编号,最后一条数据的物理偏移量

---------------------------------------------------------------------------------------------------------

通过名称跳过1G的端,然后找到相应的index的偏移量,然后根据偏移量定位log位置,不断向下找寻数据

大家可以看到index中的索引数据是轻量稀疏的,这个数据是按照4KB为大小生成的,一旦刷写4KB大小的数据就会写出相应的文件索引

官网给出的默认值4KB

一个数据段大小是1G

---------------------------------------------------------------------------------------------------------

timeIndex

# 查询时间索引

kafka-run-class.sh kafka.tools.DumpLogSegments --files 00000000000000000000.timeindex

可以看到和index索引一样,这个也是4Kb写出一部分数据,但是写出的是时间,我们可以根据时间进行断点找寻数据,指定时间重复计算

也就是说,写到磁盘的数据是按照1G分为一个整体部分的,但是这个整体部分需要4KB写一次,并且一次会生成一个索引问题信息,在检索的时候可以通过稀疏索引进行数据的检索,效率更快

5.2 消费者组、分区

01.介绍

能够在kafka中拉取数据进行消费的组件或者程序都叫做消费者

---------------------------------------------------------------------------------------------------------

这里面要设计到一个动作叫做拉取

首先我们要知道kafka这个消息队列主要的功能就是起到缓冲的作用,比如flume采集数据然后交给spark或者flink进行计算分析,

但是flume采用的就是消息的push方式,这个方式不能够保证推送的数据消费者端一定会消费完毕,会出现数据的反压问题,

这个问题很难解决,所以才出现了消息队列kafka,它可以起到一个缓冲的作用,生产者部分将数据直接全部推送到kafka,

然后消费者从其中拉取数据,这边如果也采用推送的方式,那么也就在计算端会出现反压问题,

所以kafka的消费者一般都是采用拉的方式pull,并不是push

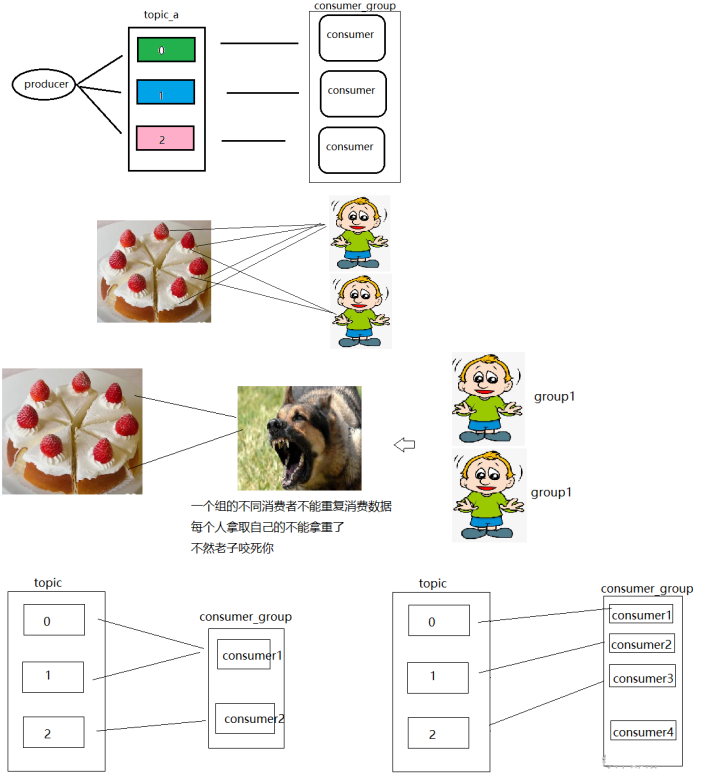

02.消费者组

在一个topic中存在多个分区,可以分摊压力实现负载均衡,那么整体topic中的数据会很多,

如果消费者只有一个的话很难全部消费其中的数据,压力也会集中在一个消费者中,

并且在大数据行业中几乎所有的计算架构都是分布式的集群模式,

那么这个集群模式中,计算的节点也会存在多个,这些节点都是可以从kafka中拉取数据的,

所有消费者不可能只有一个,一般情况下都会有多个消费者

---------------------------------------------------------------------------------------------------------

正因为topic存在多个分区,每个分区中的数据是独立的,那么消费者最好也是一个一个和分区进行一一对应的,

所以有几个分区应该对应存在几个消费者是最好的

这个和分蛋糕是一样的,一个蛋糕分成几块,那么有几个人吃,应该是对应关系的

---------------------------------------------------------------------------------------------------------

那么消费者是多个人,每个人对应一个单独的分区进行消费数据是最好的,

但问题是一个消费者难道知道自己应该去消费哪个分区吗,他们直接会不会出现混乱呢

---------------------------------------------------------------------------------------------------------

如果一个消费者想要消费多个分区的数据,或者两个消费者消费了同一个分区的数据怎么办,这样数据就会出现混乱了?

消费者组出现了,它是一个组标识,每个消费者上面都应该设置一个消费者组标识,

这样在进入到kafka消费相应分区的时候kafka就不会让数据混乱的分配给不同的消费者了,当然只有组内是有这样的分配关系的

---------------------------------------------------------------------------------------------------------

消费者组内每个消费者负责消费不同分区的数据,一个分区只能由一个组内消费者消费。

消费者组之间互不影响。所有的消费者都属于某个消费者组,即消费者组是逻辑上的一个订阅者。

03.消费者和分区

a.介绍

一个消费者组中的消费者和分区是一一对应的关系,一个分区应该对应一个消费者,

但是如果消费者多了,那么有的消费者就没有分区消费,如果消费者少了那么会出现一个消费者消费多个分区的情况

b.验证

# 首先创建topic_c 用于测试分区和消费者的对应关系

kafka-topics.sh --bootstrap-server nn1:9092 --create --topic topic_c --partitions 3 --replication-factor 2

# 启动两个消费者 刚才我们写的消费者main方法运行两次

# 然后分别在不同的分区使用生产者发送数据,看数据在消费者中的打印情况

---------------------------------------------------------------------------------------------------------

启动两次,这个时候我们就有了两个消费者实例

生产者线程:分别向三个分区中发送1 2 3元素

可以看到有的消费者消费了两个分区的数据,

如果启动三个消费者,会发现每个人消费一个分区的数据

如果启动四个消费者,我们发现有一个消费者没有数据

c.代码

package com.hainiu.kafka;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.common.serialization.StringSerializer;

import java.util.Properties;

public class Producer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

pro.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

KafkaProducer<String, String> producer = new KafkaProducer<String, String>(pro);

ProducerRecord<String, String> record1 = new ProducerRecord<>("topic_c", 0,null,"1");

ProducerRecord<String, String> record2 = new ProducerRecord<>("topic_c", 1,null,"2");

ProducerRecord<String, String> record3 = new ProducerRecord<>("topic_c", 2,null,"3");

producer.send(record1);

producer.send(record2);

producer.send(record3);

producer.close();

}

}

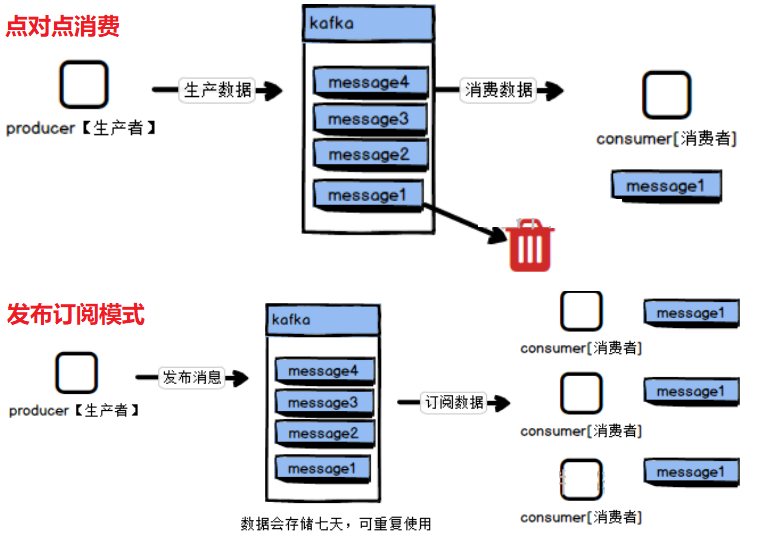

5.3 一对一:点对点消费[4种]

00.消费方式

a.点对点消费

点对点的方式,在队列中的数据有且只有一个消费者可以消费数据,

在消费完毕数据以后会将数据从队列中删除,这个数据有且只有一次消费

b.发布订阅模式

发布定语模式中每个人可以消费数据,这个数据会在队列中存储七天,

每个订阅这个数据的人都可以消费到相应的数据,并且可以重复的进行消费数据,在大多数情况下我们都使用发布订阅模式

01.4种方式

一个组 消费 一个topic

多个组 消费 一个topic

不同组 消费 多个topic

一个组 消费 多个topic

02.一个组 消费 多个topic

package com.hainiu.kafka;

import org.apache.kafka.clients.consumer.ConsumerConfig;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import org.apache.kafka.common.serialization.StringDeserializer;

import java.time.Duration;

import java.util.Arrays;

import java.util.Iterator;

import java.util.List;

import java.util.Properties;

public class Consumer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"hainiu_group");

pro.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

pro.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

KafkaConsumer<String, String> consumer = new KafkaConsumer<String, String>(pro);

List<String> topics = Arrays.asList("topic_c","topic_a");

//订阅多个topic的数据变化

consumer.subscribe(topics);

while (true){

ConsumerRecords<String, String> records = consumer.poll(Duration.ofSeconds(1));

Iterator<ConsumerRecord<String, String>> it = records.iterator();

while(it.hasNext()){

ConsumerRecord<String, String> record = it.next();

System.out.println(record.topic()+"->"+record.partition()+"->"+ record.offset()+"->"+record.key()+"->"+record.value());

}

}

}

}

03.多个组 消费 一个topic

修改同一份代码的组标识不同。启动两个实例查看里面的消费信息

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"hainiu_group1");

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"hainiu_group2");

---------------------------------------------------------------------------------------------------------

package com.hainiu.kafka;

import org.apache.kafka.clients.consumer.ConsumerConfig;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import org.apache.kafka.common.serialization.StringDeserializer;

import java.time.Duration;

import java.util.Arrays;

import java.util.Iterator;

import java.util.List;

import java.util.Properties;

public class Consumer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"hainiu_group");

pro.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

pro.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

KafkaConsumer<String, String> consumer = new KafkaConsumer<String, String>(pro);

List<String> topics = Arrays.asList("topic_c");

//订阅多个topic的数据变化

consumer.subscribe(topics);

while (true){

ConsumerRecords<String, String> records = consumer.poll(Duration.ofSeconds(1));

Iterator<ConsumerRecord<String, String>> it = records.iterator();

while(it.hasNext()){

ConsumerRecord<String, String> record = it.next();

System.out.println(record.topic()+"->"+record.partition()+"->"+ record.offset()+"->"+record.key()+"->"+record.value());

}

}

}

}

5.4 一对多:发布订阅模式

00.消费方式

a.点对点消费

点对点的方式,在队列中的数据有且只有一个消费者可以消费数据,

在消费完毕数据以后会将数据从队列中删除,这个数据有且只有一次消费

b.发布订阅模式

发布定语模式中每个人可以消费数据,这个数据会在队列中存储七天,

每个订阅这个数据的人都可以消费到相应的数据,并且可以重复的进行消费数据,在大多数情况下我们都使用发布订阅模式

5.5 consumer自定义反序列化器

01.String类型的反序列化器

package com.hainiu.kafka;

import org.apache.kafka.clients.consumer.ConsumerConfig;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import org.apache.kafka.common.serialization.Deserializer;

import org.apache.kafka.common.serialization.StringDeserializer;

import java.nio.charset.StandardCharsets;

import java.time.Duration;

import java.util.Arrays;

import java.util.Iterator;

import java.util.List;

import java.util.Properties;

public class ConsumerWithStringDeserializer {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"hainiu_group1");

pro.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, MyDeserializer.class.getName());

pro.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, MyDeserializer.class.getName());

KafkaConsumer<String, String> consumer = new KafkaConsumer<String, String>(pro);

List<String> topics = Arrays.asList("topic_c","topic_a");

consumer.subscribe(topics);

while(true){

ConsumerRecords<String, String> records = consumer.poll(Duration.ofMillis(100));

Iterator<ConsumerRecord<String, String>> it = records.iterator();

while(it.hasNext()){

ConsumerRecord<String, String> record = it.next();

System.out.println(record.topic()+"-->"+record.partition()+"-->"+record.key()+"-->"+record.value()+"-->"+record.offset());

}

}

}

public static class MyDeserializer implements Deserializer<String>{

@Override

public String deserialize(String topic, byte[] data) {

String line = new String(data, StandardCharsets.UTF_8);

return line;

}

}

}

02.Student类型的反序列化器

package com.hainiu.kafka;

import org.apache.kafka.clients.consumer.ConsumerConfig;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import org.apache.kafka.common.serialization.Deserializer;

import org.apache.kafka.common.serialization.StringDeserializer;

import java.io.ByteArrayInputStream;

import java.io.IOException;

import java.io.ObjectInputStream;

import java.io.ObjectOutputStream;

import java.time.Duration;

import java.util.Arrays;

import java.util.Iterator;

import java.util.List;

import java.util.Properties;

public class ConsumerWithStudentDeSerializer {

public static class MyStudentDeserializer implements Deserializer<Student>{

@Override

public Student deserialize(String topic, byte[] data) {

ByteArrayInputStream byteIn = null;

ObjectInputStream objectIn = null;

Student s = null;

try {

byteIn = new ByteArrayInputStream(data);

objectIn = new ObjectInputStream(byteIn);

Object o = objectIn.readObject();

s = (Student) o;

} catch (Exception e) {

throw new RuntimeException(e);

}finally {

try {

byteIn.close();

objectIn.close();

} catch (IOException e) {

throw new RuntimeException(e);

}

}

return s;

}

}

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"hainiu_group1");

pro.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

pro.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, MyStudentDeserializer.class.getName());

KafkaConsumer<String, Student> consumer = new KafkaConsumer<String, Student>(pro);

List<String> topics = Arrays.asList("topic_c","topic_a");

consumer.subscribe(topics);

while(true){

ConsumerRecords<String, Student> records = consumer.poll(Duration.ofMillis(100));

Iterator<ConsumerRecord<String, Student>> it = records.iterator();

while(it.hasNext()){

ConsumerRecord<String, Student> record = it.next();

System.out.println(record.key()+"-->"+record.value());

}

}

}

}

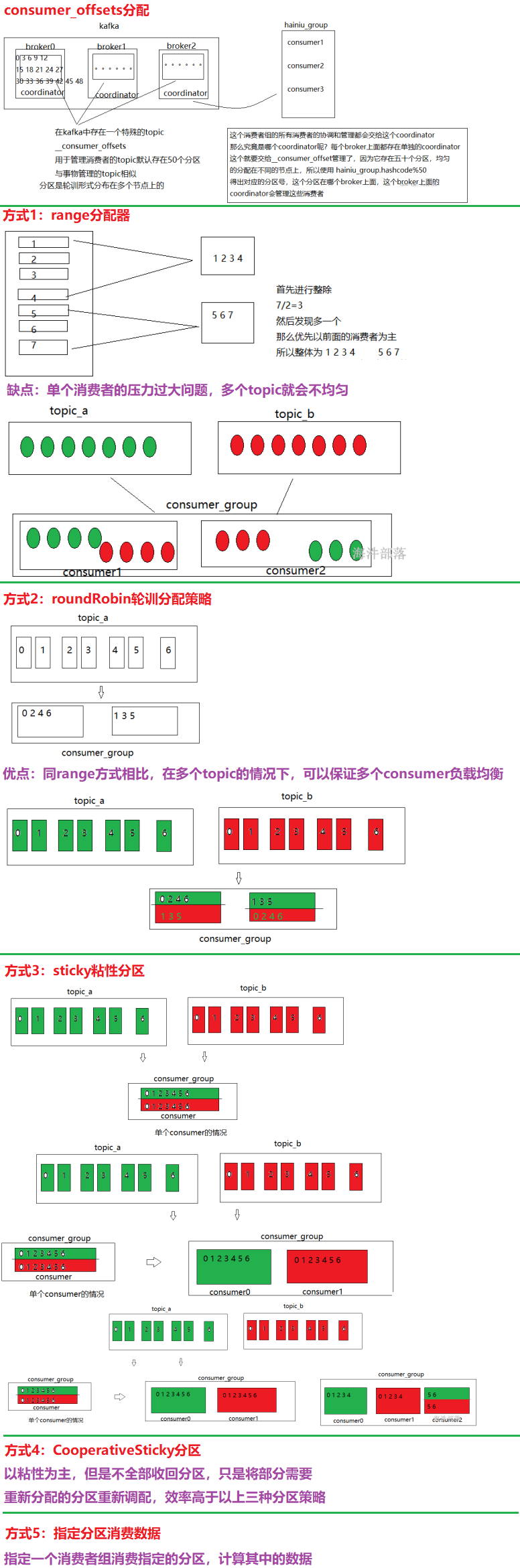

5.6 consumer分区分配规则

00.背景

消费者有的时候会少于或者多于分区的个数,

那么如果消费者少了有的消费者要消费多个分区的数据,

如果消费者多了,有的消费者就可能没有分区的数据消费

---------------------------------------------------------------------------------------------------------

现在我们知道kafka中存在一个coordinator可以管理这么一堆消费者,

它可以帮助一个组内的所有消费者进行分区的分配和对应,通过coordinator进行协调

00.通过coordinator进行协调的5种方式

方式1:range分配器:按照范围形式进行分配分区数量

方式2:roundRobin轮训分配策略

方式3:sticky粘性分区

方式4:CooperativeSticky分区

方式5:指定分区消费数据

01.方式1:range分配器:按照范围形式进行分配分区数量

a.步骤1

# 为了演示分区的分配效果我们创建一个topic_d,设定为7个分区

kafka-topics.sh --bootstrap-server nn1:9092 --topic topic_d --create --partitions 7 --replication-factor 2

consumer.subscribe(topics, new ConsumerRebalanceListener() {

@Override

public void onPartitionsRevoked(Collection<TopicPartition> partitions) {

}

@Override

public void onPartitionsAssigned(Collection<TopicPartition> partitions) {

}

});

b.步骤2

然后改版订阅代码,subscribe订阅信息的时候展示出来分区的对应映射关系,这个只是一个监控的作用没有其他的代码影响,ConsumerRebalanceListener增加监视

其中存在两个比较直观的方法

onPartitionsRevoked回收的分区

onPartitionsAssigned分配的分区

能够直观展示在分区分配的对应关系

其中我们需要知道两个比较重要的参数

-----------------------------------------------------------------------------------------------------

| 参数 | 解释

|-------------------------------|------------------------------------

| offsets.topic.num.partitions | __consumer_offset这个topic的分区数量默认50个

| heartbeat.interval.ms | 消费者和协调器的心跳时间 默认3s

| session.timeout.ms | 消费者断开的超时时间 默认45s,最小不能小于6000

| partition.assignment.strategy | 设定分区分配策略

-----------------------------------------------------------------------------------------------------

也就是说我们想要直观查看消费者变化后的映射对应关系需要停止消费者以后45s才可以,这个在代码中我们需要人为设定小点,更加快速查看变化

c.步骤3

代码测试原理

首先设定topic_d的分区为7个,然后启动一个组内的两个消费者,可以看到他们的分配关系在onPartitionsAssigned

这个方法中打印出来,同时我们关闭一个消费者,可以看到onPartitionsRevoked可以展示回收的分区,

onPartitionsAssigned以及这个方法中分配的分区

d.步骤4

package com.hainiu.kafka;

import org.apache.kafka.clients.consumer.*;

import org.apache.kafka.common.TopicPartition;

import org.apache.kafka.common.serialization.StringDeserializer;

import java.time.Duration;

import java.util.*;

public class Consumer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"hainiu_group2");

pro.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

pro.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

pro.put(ConsumerConfig.PARTITION_ASSIGNMENT_STRATEGY_CONFIG,RangeAssignor.class.getName());

//设定分区分配策略为range

pro.put(ConsumerConfig.SESSION_TIMEOUT_MS_CONFIG,6000);

//设定consumer断开超时时间最小不能小于6s

KafkaConsumer<String, String> consumer = new KafkaConsumer<String, String>(pro);

List<String> topics = Arrays.asList("topic_d");

consumer.subscribe(topics, new ConsumerRebalanceListener() {

@Override

public void onPartitionsRevoked(Collection<TopicPartition> partitions) {

for (TopicPartition partition : partitions) {

System.out.println("revoke-->"+partition.topic()+"-->"+partition.partition());

}

}

@Override

public void onPartitionsAssigned(Collection<TopicPartition> partitions) {

for (TopicPartition partition : partitions) {

System.out.println("assign-->"+partition.topic()+"-->"+partition.partition());

}

}

});

while (true){

ConsumerRecords<String, String> records = consumer.poll(Duration.ofSeconds(1));

Iterator<ConsumerRecord<String, String>> it = records.iterator();

while(it.hasNext()){

ConsumerRecord<String, String> record = it.next();

System.out.println(record.topic()+"->"+record.partition()+"->"+ record.offset()+"->"+record.key()+"->"+record.value());

}

}

}

}

e.步骤5

我们执行两个实例,两个实例代表两个消费者位于同一个组中,那么两个消费者的分配关系按照,范围进行分割

consumer0[0,1,2,3] consumer1[4,5,6]

运行一个实例的时候可以看见,没有回收,因为第一次分配,所以第一个consumer消费所有的分区

如果启动第二个消费者可以看到,第一个消费者要回收所有的已经分配给他的分区,

然后重新将分区分配给consumer1和consumer2,因为coordinator的分配规则基于eager协议,

这个协议的规则就是当分配关系发生变化的时候要全部回收然后打乱重分

-----------------------------------------------------------------------------------------------------

缺点:

这个协议只是按照范围形式进行重新分配分区,会造成单个消费者的压力过大问题,多个topic就会不均匀,会造成分配不均匀的问题

02.方式2:roundRobin轮训分配策略

a.介绍

轮训形式分配分区,一个消费者一个分区

b.代码

pro.put(ConsumerConfig.PARTITION_ASSIGNMENT_STRATEGY_CONFIG,RoundRobinAssignor.class.getName());

c.优点

同range方式相比,在多个topic的情况下,可以保证多个consumer负载均衡

分配规则如上图,一人一个轮训形式

consumer0 [0 2 4 6 1 3 5]

consumer1 [1 3 5 0 2 4 6]

d.缺点

不管是range的还是roundRobin的分配方式都是全量收回打乱重新分配,这样的效率太低,所以我们使用下面的粘性分区策略

03.方式3:sticky粘性分区

a.介绍

粘性分区它的重新分区原理和原来的roundRobin的分区方式差不多,但是又不相同,主要是分区逻辑一样,

但是重新分配分区的时候优先保留原分区,然后重新分配其他分区,从而不需要全部打乱重分,减少重新分配分区消耗

分区分配方式一样,但是如果重新分配的话会有很多原来分区的预留,重新分配新的分区

b.操作1

# 为了演示效果再次创建新的topic topic_e 七个分区

kafka-topics.sh --bootstrap-server nn1:9092 --topic topic_e --create --partitions 7 --replication-factor 2

// 修改为粘性分区

pro.put(ConsumerConfig.PARTITION_ASSIGNMENT_STRATEGY_CONFIG,StickyAssignor.class.getName());

List<String> topics = Arrays.asList("topic_d","topic_e");

c.操作2

并且运行应用实例分别运行1 ,2 ,3 多种个数的实例

d.结论

我们发现多个实例的运行时候,优先保留之前的分区规则,然后重新分配,但是优先以分区分配均衡为主

以上三种都基于eager协议,也就是想要重新分配分区一定要将原来的所有分区回收,全部打乱重新,即使保留原来的分区规则,

也需要全部都回收分区,这样效率非常低下,最后一种CooperativeSticky分区策略完全打破以上三种的分区关系

04.方式4:CooperativeSticky分区

a.介绍

以粘性为主,但是不全部收回分区,只是将部分需要重新分配的分区重新调配,效率高于以上三种分区策略

b.操作

//设定分区策略

pro.put(ConsumerConfig.PARTITION_ASSIGNMENT_STRATEGY_CONFIG,CooperativeStickyAssignor.class.getName());

c.结论

运行两个实例,查看控制台信息发现

整个分区分配规则和粘性分区策略一致,但是并不需要收回全部分区

系统默认分区分配规则为:

range+CooperativeSticky

范围分区为主,优先粘性并且不急于eager协议

05.方式5:指定分区消费数据

a.介绍

在计算处理过程中,有时候我们需要指定一个消费者组消费指定的分区,计算其中的数据,

这个时候以上的所有分区策略都不符合我们人为的要求,我们需要指定相应的分区进行消费

b.操作

//用指定的方式定向消费相应的分区数据

consumer.assign();

c.代码

package com.hainiu.kafka;

import org.apache.kafka.clients.consumer.*;

import org.apache.kafka.common.TopicPartition;

import org.apache.kafka.common.serialization.StringDeserializer;

import java.time.Duration;

import java.util.*;

public class ConsumerAssginPartition {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"hainiu_group2");

pro.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

pro.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

pro.put(ConsumerConfig.PARTITION_ASSIGNMENT_STRATEGY_CONFIG,CooperativeStickyAssignor.class.getName());

pro.put(ConsumerConfig.SESSION_TIMEOUT_MS_CONFIG,6000);

KafkaConsumer<String, String> consumer = new KafkaConsumer<String, String>(pro);

List<TopicPartition> list = Arrays.asList(

new TopicPartition("topic_d", 0),

new TopicPartition("topic_e", 0)

);

consumer.assign(list);

while (true){

ConsumerRecords<String, String> records = consumer.poll(Duration.ofSeconds(1));

Iterator<ConsumerRecord<String, String>> it = records.iterator();

while(it.hasNext()){

ConsumerRecord<String, String> record = it.next();

System.out.println(record.topic()+"->"+record.partition()+"->"+ record.offset()+"->"+record.key()+"->"+record.value());

}

}

}

}

d.结论

我们只消费topic_e的0号分区和topic_d的0号分区

生产者向两个topic的0号分区发送数据

消费者可以直接消费其中的数据

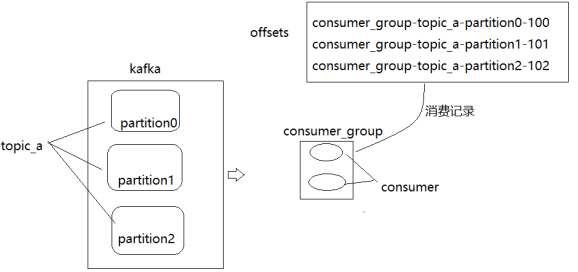

5.7 consumer偏移量

01.偏移量的概念

消费者在消费数据的时候需要将消费的记录存储到一个位置,防止因为消费者程序宕机而引起断点消费数据丢失问题,

下一次可以按照相应的位置从kafka中找寻数据,这个消费位置记录称之为偏移量offset

---------------------------------------------------------------------------------------------------------

kafka0.9以前版本将偏移量信息记录到zookeeper中

新版本中偏移量信息记录在__consumer_offsets中,这个topic是系统生成的,不仅仅帮助管理偏移量信息还能分配consumer给哪个coordinator管理,是一个非常重要的topic

它的记录方式和我们知道的记录方式一样 groupid + topic + partition ==> offset

其中存储到__consumer_offsets中的数据格式也是按照k-v进行存储的,其中k是groupid + topic + partition value值为offset的偏移量信息

可以看到系统生成的topic

因为之前我们消费过很多数据,现在可以查看一下记录在这个topic中的偏移量信息

---------------------------------------------------------------------------------------------------------

其中存在一个kafka-consumer-groups.sh 命令

# 查看消费者组信息

kafka-consumer-groups.sh --bootstrap-server localhost:9092 --list

# 查询具体信息

kafka-consumer-groups.sh --bootstrap-server localhost:9092 --describe --group my-group

# 查看活跃信息

kafka-consumer-groups.sh --bootstrap-server localhost:9092 --describe --group my-group --members

---------------------------------------------------------------------------------------------------------

当前组消费偏移量信息

GROUP:组名

TOPIC:topic信息

PARTITION:分区

CURRENT-OFFSET:当前消费偏移量

LOG-END-OFFSET:这个分区总共存在多少数据

LAG:还差多少没消费

CONSUMER-ID:随机消费者id

HOST:主机名

CLIENT-ID:客户端id

---------------------------------------------------------------------------------------------------------

查询__consumer_offset中的原生数据

kafka-console-consumer.sh --bootstrap-server nn1:9092 \

--topic __consumer_offsets --from-beginning --formatter \

kafka.coordinator.group.GroupMetadataManager\$OffsetsMessageFormatter

---------------------------------------------------------------------------------------------------------

使用元数据格式化方式查看偏移量信息数据

结果如下key展示的是groupid,topic,partition value值展示的是当前的偏移量信息,并且在这个topic中是追加形式一致往里面写入的

02.偏移量的自动管理

a.介绍

那么我们已经看到了偏移量的存储但是偏移量究竟是怎么提交的呢?

b.操作

首先我们没有设置任何的偏移量提交的代码,这个是默认开启的,其中存在两个参数

//开启自动提交偏移量信息

pro.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG, true);

//默认提交间隔5s

pro.put(ConsumerConfig.AUTO_COMMIT_INTERVAL_MS_CONFIG, 5000);

c.细节

官网的设置参数为两个true和5000

所以我们在没有开启默认提交的时候已经自动提交了

为了演示自动提交的效果我们引入一个参数

auto.offset.reset

这个参数用于控制没有偏移量存储的时候,应该从什么位置进行消费数据

-----------------------------------------------------------------------------------------------------

其中参数值官网中给出三个

[latest, earliest, none]

latest:从最新位置消费

earliest:最早位置消费数据

none:如果不指定消费的偏移量直接报错

一定要记得一点,如果有偏移量信息那么以上的设置是无效的

d.使用

现在我们设置读取位置为最早位置,并且消费数据,看看可不可以记录偏移量,断点续传

思路:

首先修改组id为一个新的组,然后从最早位置消费数据,如果记录了偏移量,那么重新启动消费者会看到,没有任何数据,因为之前记录了消费数据的位置

整体代码如下:

package com.hainiu.kafka;

import org.apache.kafka.clients.consumer.*;

import org.apache.kafka.common.TopicPartition;

import org.apache.kafka.common.serialization.StringDeserializer;

import java.time.Duration;

import java.util.*;

public class Consumer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"new_group");

pro.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

pro.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());

pro.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG, true);

pro.put(ConsumerConfig.AUTO_OFFSET_RESET_CONFIG, "earliest");

pro.put(ConsumerConfig.AUTO_COMMIT_INTERVAL_MS_CONFIG, 5000);

KafkaConsumer<String, String> consumer = new KafkaConsumer<String, String>(pro);

List<String> topics = Arrays.asList("topic_d","topic_e");

consumer.subscribe(topics);

while (true){

ConsumerRecords<String, String> records = consumer.poll(Duration.ofSeconds(1));

Iterator<ConsumerRecord<String, String>> it = records.iterator();

while(it.hasNext()){

ConsumerRecord<String, String> record = it.next();

System.out.println(record.topic()+"->"+record.partition()+"->"+ record.offset()+"->"+record.key()+"->"+record.value());

}

}

}

}

运行完毕打印数据

这个时候我们需要在5s之内关闭应用,然后重新启动,因为提交的间隔时间是5s

再次启动

我们发现数据依旧被消费出来了,证明之前的偏移量存储没有任何效果和作用,因为间隔时间是5s

现在我们等待5s后在关闭应用

发现没有任何数据产生,因为偏移量已经提交了

03.偏移量的手动提交

a.介绍

如上的案例我们发现偏移量的管理如果交给系统自己管理,我们没有办法及时的修改和管理偏移量信息,

这个时候我们需要手动来提交给管理偏移量,更加及时和方便

b.引入两个方法

consumer.commitAsync();

consumer.commitSync();

-----------------------------------------------------------------------------------------------------

commitAsync 异步提交方式:只提交一次,不管成功与否不会重试

commitSync 同步提交方式:同步提交方式会一直提交到成功为止

c.操作

一般我们都会选择异步提交方式,他们的功能都是将拉取到的一整批数据的最大偏移量直接提交到__consumer_offsets中,

但是同步方式会很浪费资源,异步方式虽然不能保证稳定性但是我们的偏移量是一直递增存储的,

所以偶尔提交不成功一个两个不影响我们的使用

d.代码

package com.hainiu.kafka;

import org.apache.kafka.clients.consumer.*;

import org.apache.kafka.common.TopicPartition;

import org.apache.kafka.common.serialization.StringDeserializer;

import java.time.Duration;

import java.util.*;

public class Consumer1 {

public static void main(String[] args) {

Properties pro = new Properties();

pro.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG,"nn1:9092");

pro.put(ConsumerConfig.GROUP_ID_CONFIG,"new_group1");

pro.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName());