1 ElasticSearch介绍

1.1 定义

00.总结

a.服务

手动 elasticsearch6 net start es6 && net start esh6 && net start ki6 && net start log6

手动 elasticsearch6 net stop es6 && net stop esh6 && net stop ki6 && net stop log6

-----------------------------------------------------------------------------------------------------

手动 elasticsearch7 net start es7 && net start esh7 && net start ki7 && net start log7

手动 elasticsearch7 net stop es7 && net stop esh7 && net stop ki7 && net stop log7

-----------------------------------------------------------------------------------------------------

手动 ElasticHD net start ehd7

手动 ElasticHD net stop ehd7

b.对比说明

a.数据库(关系型数据库) 对应 索引(Elasticsearch):

在关系型数据库中,数据库是存储表的集合,而在 Elasticsearch 中,索引是存储文档的集合。

b.表 对应 类型(type):

在早期的 Elasticsearch 版本中,一个索引可以包含多个类型(类似于关系型数据库中的表),

但自 Elasticsearch 6.x 版本起,一个索引只能有一个类型。可以理解为每个索引只有一个数据模型。

c.表结构 对应 映射(mapping):

在关系型数据库中,表结构定义了表的列和数据类型。

在 Elasticsearch 中,映射(mapping)定义了文档中字段的结构和类型。

d.行,一条数据 对应 文档(document):

在关系型数据库中,一行表示表中的一条数据,而在 Elasticsearch 中,

一个文档是存储在索引中的基本单位,它包含了字段和字段值。

e.列,字段的值 对应 字段(field):

在关系型数据库中,列表示数据的字段,每行都有列的值。

在 Elasticsearch 中,字段是文档的组成部分,记录了文档的具体信息。

c.ElasticSearch Vs 关系型数据库

关系型数据库 ElasticSearch

数据库 索引(index)

表 类型(type) 废弃

表结构 映射(mapping)

行,一条数据 文档(document)

列,字段的值 字段(filed)

-----------------------------------------------------------------------------------------------------

SQL DSL(Domain Specific Language)

Select * from xxx GET http://

update xxx set xx=xxx PUT http://

Delete xxx DELETE http://

索引 全文索引

-----------------------------------------------------------------------------------------------------

在ES中索引是有不同上下文含义的,它既可以是名词也可以是动词。

索引为名词是就是上文中提到的它是document的集合,索引为动词的时候表示将document数据保存到ES中,也就是数据写入。

在ES中,为了屏蔽语言的交互差异,ES直接对外的交互都是通过Rest API进行的。

00.介绍

a.ElasticSearch Vs 关系型数据库

a.对比

关系型数据库 ElasticSearch

数据库 索引(index) 倒排索引:词条、词条所在文档id、位置、...

表 类型(type) 废弃

表结构 映射(mapping)

行,一条数据 文档(document)

列,字段的值 字段(filed)

-------------------------------------------------------------------------------------------------

SQL DSL(Domain Specific Language)

Select * from xxx GET http://

update xxx set xx=xxx PUT http://

Delete xxx DELETE http://

索引 全文索引

b.说明

在ES中索引是有不同上下文含义的,它既可以是名词也可以是动词。

索引为名词是就是上文中提到的它是document的集合,索引为动词的时候表示将document数据保存到ES中,也就是数据写入。

在ES中,为了屏蔽语言的交互差异,ES直接对外的交互都是通过Rest API进行的。

b.分词器

a.ik_smart:为最少切分

描述:该分词器为智能分词器,适合快速分词,适用于搜索时对速度要求较高的场景。

特点:

使用较少的词典,分词效果较为简单。

能够对常见的词进行合理的分词,但可能会忽略一些细节。

b.ik_max_word:为最细粒度划分

描述:该分词器为最大词长分词器,适合对分词精度要求较高的场景。

特点:

会生成尽可能多的词条,提供更细粒度的分词结果。

能够捕捉到更多的短语和组合,但相对速度较慢。

c.默认standard

它基于 Unicode 文本分割标准,适用于多种语言。

-----------------------------------------------------------------------------------------------------

具体特点包括:

处理多语言:standard 分词器可以处理多种语言的文本,自动识别并处理词边界。

过滤:它会去除一些常见的标点符号和停用词(如“the”、“is”等)。

小写转换:分词器会将所有输入的文本转换为小写,从而进行大小写不敏感的搜索。

-----------------------------------------------------------------------------------------------------

使用示例

如果你在创建索引时不指定分析器,standard 分词器将被自动应用。以下是创建索引的示例:

PUT /my_index

{

"settings": {

"analysis": {

// 此处未指定分析器,将使用默认的 standard 分词器

}

}

}

01.定义1

a.ElasticSearch

elasticsearch底层是基于lucene来实现的。

Lucene是一个Java语言的搜索引擎类库,是Apache公司的顶级项目,由DougCutting于1999年研发。

ElasticSearch 是一个分布式、可扩展、近实时性的高性能搜索与数据分析引擎。

ElasticSearch 基于 Java 编写,通过进一步封装 Lucene,将搜索的复杂性屏蔽起来,开发者只需要一套简单的 RESTful API 就可以操作全文检索。

ElasticSearch 在分布式环境下表现优异,这也是它比较受欢迎的原因之一。它支持 PB 级别的结构化或非结构化海量数据处理

b.Lucene

Lucene 是一个开源、免费、高性能、纯 Java 编写的全文检索引擎,可以算作是开源领域最好的全文检索工具包。

在实际开发中,Lucene 几乎适用于任何需要全文检索的场景,所以 Lucene 先后发展出好多语言版本,例如 C++、C#、Python 等。

早在 2005 年,Lucene 就升级为 Apache 顶级开源项目。它的作者是 Doug Cutting,有的人可能没听过这这个人,不过你肯定听过他的另一个大名鼎鼎的作品 Hadoop。

不过需要注意的是,Lucene 只是一个工具包,并非一个完整的搜索引擎,开发者可以基于 Lucene 来开发完整的搜索引擎。比较著名的有 Solr、ElasticSearch,不过在分布式和大数据环境下,ElasticSearch 更胜一筹。

-----------------------------------------------------------------------------------------------------

Lucene的优势:

易扩展

高性能(基于倒排索引)

-----------------------------------------------------------------------------------------------------

Lucene的缺点:

只限于Java语言开发

学习曲线陡峭

不支持水平扩展

-----------------------------------------------------------------------------------------------------

相比与lucene,elasticsearch具备下列优势:

支持分布式,可水平扩展

提供Restful接口,可被任何语言调用

c.ElasticSearch三大功能

数据搜集

数据分析

数据存储

d.ElasticSearch主要特点

分布式文件存储

实时分析的分布式搜索引擎

高可拓展性

可插拔的插件支持

分布式索引、搜索

索引自动分片、负载均衡

自动发现机器、组建集群

支持Restful 风格接口

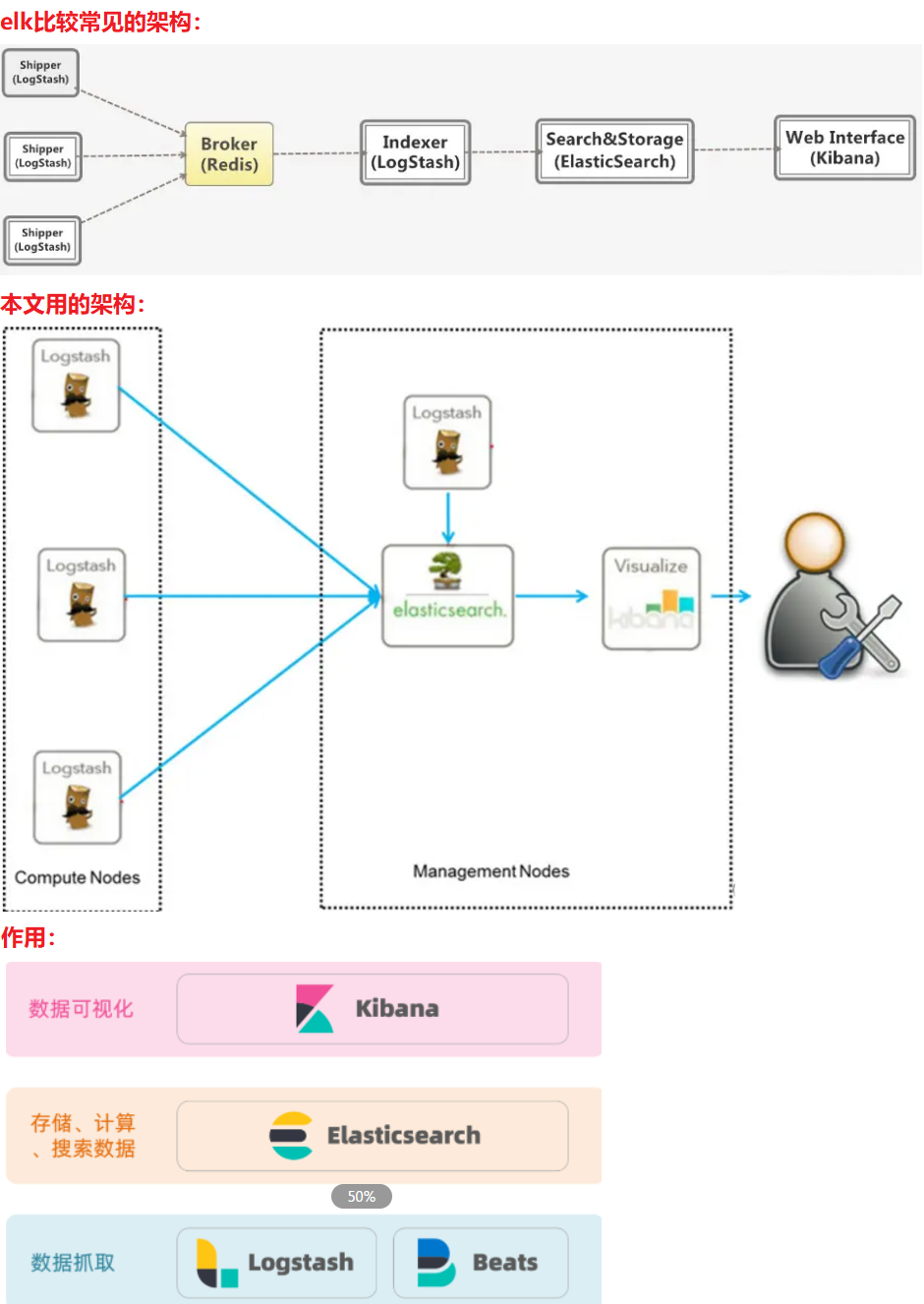

02.定义2

a.概念

a.elasticsearch

一个开源的分布式搜索引擎,可以用来实现搜索、日志统计、分析、系统监控等功能

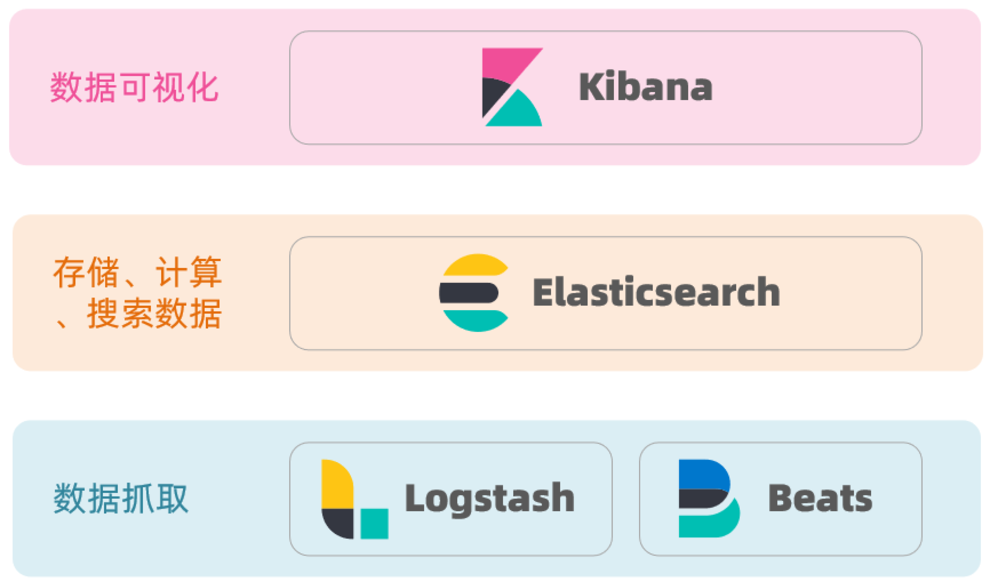

b.elastic stack(ELK)

以elasticsearch为核心的技术栈,包括beats、Logstash、kibana、elasticsearch

c.Lucene

Apache的开源搜索引擎类库,提供了搜索引擎的核心API

b.ELK技术栈

elasticsearch结合kibana、Logstash、Beats,也就是elastic stack(ELK)。被广泛应用在日志数据分析、实时监控等领域:

而elasticsearch是elastic stack的核心,负责存储、搜索、分析数据。

03.核心概念

a.集群(Cluster)

在一个分布式系统里面,可以通过多个elasticsearch运行实例组成一个集群,

这个集群里面有一个节点叫做主节点(master),elasticsearch是去中心化的,

所以这里的主节点是动态选举出来的,不存在单点故障。

-----------------------------------------------------------------------------------------------------

在同一个子网内,只需要在每个节点上设置相同的集群名,

elasticsearch就会自动的把这些集群名相同的节点组成一个集群。

节点和节点之间通讯以及节点之间的数据分配和平衡全部由elasticsearch自动管理,

在外部看来elasticsearch就是一个整体。

-----------------------------------------------------------------------------------------------------

一个或者多个安装了 es 节点的服务器组织在一起,就是集群,这些节点共同持有数据,共同提供搜索服务。

一个集群有一个名字,这个名字是集群的唯一标识,该名字成为 cluster name,默认的集群名称是 elasticsearch,具有相同名称的节点才会组成一个集群。

-----------------------------------------------------------------------------------------------------

可以在 config/elasticsearch.yml 文件中配置集群名称:

cluster.name: javaboy-es

-----------------------------------------------------------------------------------------------------

在集群中,节点的状态有三种:绿色、黄色、红色:

绿色:节点运行状态为健康状态。所有的主分片、副本分片都可以正常工作。

黄色:表示节点的运行状态为警告状态,所有的主分片目前都可以直接运行,但是至少有一个副本分片是不能正常工作的。

红色:表示集群无法正常工作。

b.节点(Node)

集群中的一个服务器就是一个节点,节点中会存储数据,同时参与集群的索引以及搜索功能。

一个节点想要加入一个集群,只需要配置一下集群名称即可。

默认情况下,如果我们启动了多个节点,多个节点还能够互相发现彼此,那么它们会自动组成一个集群,这是 es 默认提供的,

但是这种方式并不可靠,有可能会发生脑裂现象。所以在实际使用中,建议一定手动配置一下集群信息。

-----------------------------------------------------------------------------------------------------

每一个运行实例称为一个节点,每一个运行实例既可以在同一机器上,也可以在不同的机器上。

所谓运行实例,就是一个服务器进程,在测试环境中可以在一台服务器上运行多个服务器进程,在生产环境中建议每台服务器运行一个服务器进程。

c.索引(Index)

索引可以从两方面来理解:索引可以从两方面来理解:

名词:具有相似特征文档的集合

动词:索引数据以及对数据进行索引操作

-----------------------------------------------------------------------------------------------------

Elasticsearch里的索引概念是名词而不是动词,在elasticsearch里它支持多个索引。

优点类似于关系数据库里面每一个服务器可以支持多个数据库是一个道理,

在每一索引下面又可以支持多种类型,这又类似于关系数据库里面的一个数据库可以有多张表一样。

但是本质上和关系数据库还是有很大的区别,我们这里暂时可以这么理解。

-----------------------------------------------------------------------------------------------------

在ES之前的版本中,是有type这个概念的,类比数据库中的表,那上文中所说的document就会放在type中。

但是在ES后面的版本中为了提高数据存储的效率逐渐取消了type,

因此index实际上在现在的ES中既有库的概念也有表的概念。

简单理解就是index就是文档的容器,它是一类文档的集合,

但是这里需要注意的是index是逻辑空间的分类,实际数据是存在物理空间的分片上的。

-----------------------------------------------------------------------------------------------------

另外需要说明的是,在ES中索引是有不同上下文含义的,它既可以是名词也可以是动词。

索引为名词是就是上文中提到的它是document的集合,索引为动词的时候表示将document数据保存到ES中,也就是数据写入。

在ES中,为了屏蔽语言的交互差异,ES直接对外的交互都是通过Rest API进行的。

d.类型(Type)

类型是索引上的逻辑分类或者分区。在 es6 之前,一个索引中可以有多个类型,

从 es7 开始,一个索引中,只能有一个类型。

在 es6.x 中,依然保持了兼容,依然支持单 index 多个 type 结构,但是已经不建议这么使用。

e.文档(Document)

一个可以被索引的数据单元。例如一个用户的文档、一个产品的文档等等。文档都是 JSON 格式的。

-----------------------------------------------------------------------------------------------------

我们都说ES是面向document的,这句话什么意思呢?实际就是表示ES是基于document进行数据操作的,

操作主要包括数据搜索以及索引(这里的索引是数据写入的意思)。因此可以说document是ES的基础数据结构,

它会被序列化之后保存到ES中。那么这个document到底是个什么东东呢?相信大家都对Mysql还是比较熟悉的,

因此我们用Mysql中的数据库与表的概念与ES的index进行对比,可能并不是十分的恰当和吻合,

但是可以有助于大家对于这些概念的理解。另外type也在ES6.x版本之后逐渐取消了。

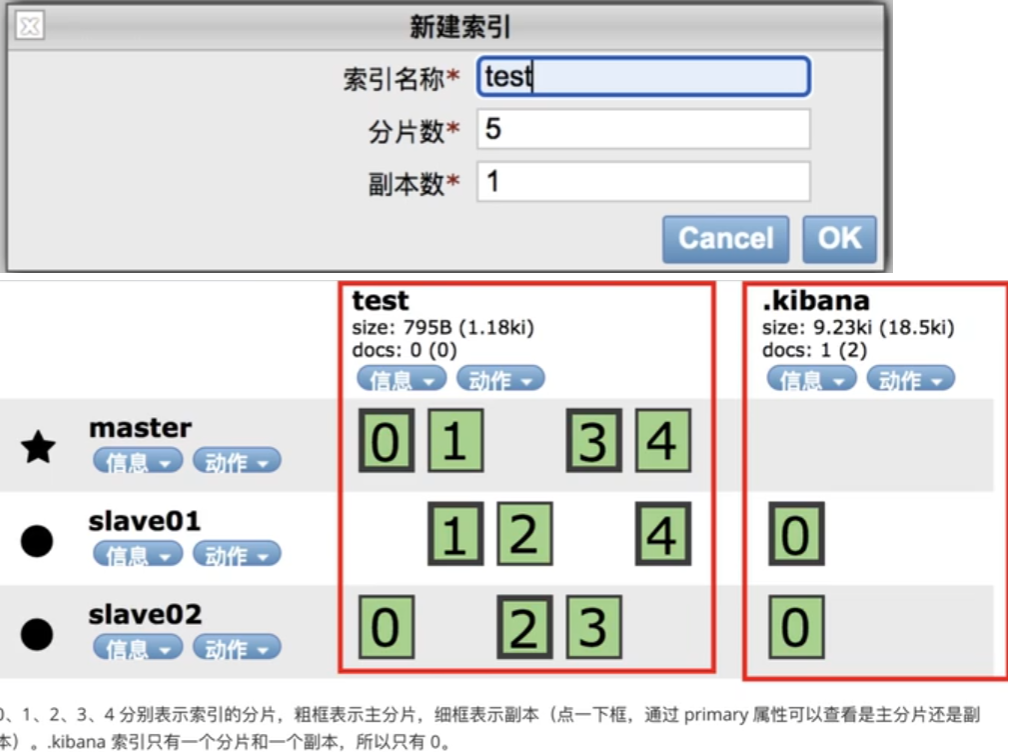

f.分片(Shards)

索引都是存储在节点上的,但是受限于节点的空间大小以及数据处理能力,单个节点的处理效果可能不理想,

此时我们可以对索引进行分片。当我们创建一个索引的时候,就需要指定分片的数量。

每个分片本身也是一个功能完善并且独立的索引。

默认情况下,一个索引会自动创建 1 个分片,并且为每一个分片创建一个副本。

-----------------------------------------------------------------------------------------------------

Elasticsearch 它会把一个索引分解为多个小的索引,每一个小的索引就叫做分片。

分片之后就可以把各个分片分配到不同的节点中去。

g.副本(Replicas)

副本也就是备份,是对主分片的一个备份。‘

-----------------------------------------------------------------------------------------------------

Elasticsearch的每一个分片都可以有0到多个副本,

而每一个副本也都是分片的完整拷贝,好处是可以用它来增加速度的同时也提高了系统的容错性。

一旦Elasticsearch的某个节点数据损坏或则服务不可用的时候,

那么这个时就可以用其他节点来代替坏掉的节点,以达到高考用的目的。

h.recovery概念

Elasticsearch 的recovery代表的是数据恢复或者叫做数据重新分布。

elasticsearch 当有节点加入或退出时时它会根据机器的负载对索引分片进行重新分配,当挂掉的节点再次重新启动的时候也会进行数据恢复。

i.river

Elasticsearch river 代表的是一个数据源,这也是其它存储方式(比如:数据库)同步数据到 elasticsearch 的一个方法。

它是以插件方式存在的一个 elasticsearch 服务,通过读取 river 中的数据并把它索引到 elasticsearch 当中去,官方的 river 有 couchDB、RabbitMQ、Twitter、Wikipedia。

j.gateway

gateway 代表 elasticsearch 索引的持久化存储方式,elasticsearch 默认是先把索引存放到内存中去,当内存满了的时候再持久化到硬盘里。

当这个 elasticsearch 集群关闭或者再次重新启动时就会从 gateway 中读取索引数据。

elasticsearch 支持多种类型的 gateway,有本地文件系统(默认),分布式文件系统,Hadoop 的 HDFS 和 amazon 的 s3 云存储服务。

k.discovery.zen

discovery.zen代表 elasticsearch 的自动节点发现机制,而且 elasticsearch还是一个基于 p2p 的系统。

首先它它会通过以广播的方式去寻找存在的节点,然后再通过多播协议来进行节点之间的通信,于此同时也支持点对点的交互操作。

l.Transport

Transport代表 elasticsearch 内部的节点或者集群与客户端之间的交互方式。

默认的内部是使用 tcp 协议来进行交互的,同时它支持 http 协议(json格式)、thrift、servlet、memcached、zeroMQ等多种的传输协议(通过插件方式集成)。

m.Settings

集群中对索引的定义信息,例如索引的分片数、副本数等等。

n.Mapping

Mapping 保存了定义索引字段的存储类型、分词方式、是否存储等信息。

o.Analyzer

字段分词方式的定义。

1.2 架构1

00.总结

a.流程

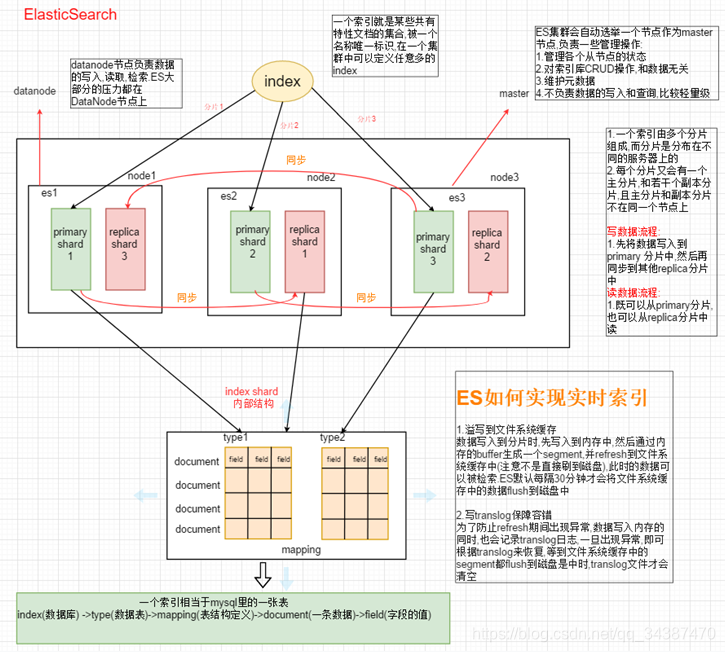

datanode节点负责数据的写入读取,检索ES大部分的压力都在DataNode节点上

一个索引就是某些共有特性文档的集合,被一个名称唯一标识在一个集群中可以定义任意多的index

b.ES集群会自动选举一个节点作为master节点负责一些管理操作

1.管理各个从节点的状态

2.对索引库CRUD提作和数据无关

3.维护元数据

4.不负责数据的写入和查询比较轻量级

-----------------------------------------------------------------------------------------------------

分片

1.一个索引由多个分片组成而分片是分布在不同的服务器上的

2.每个分片又会有一个主分片,和若干个副本分片且主分片和副本分片不在同一个节点上

-----------------------------------------------------------------------------------------------------

写数据流程:先将数据写入到primary分片中,然后再同步到其他replica分片中

读数据流程:既可以从primary分片,也可以从replica分片中

c.ES如何实现实时索引

1.溢写到文件系统缓存

数据写入到分片时,先写入到内存中,然后通过内存的buffer生成一个segment,

并refresh到文件系统缓存中(注意不是直接刷到磁盘)此时的数据可以被检索,

ES默认每隔30分钟才会将文件系统缓存中的数据flush到磁盘中

2.写translog保障容错

为了防止refresh期间出现异常,数据写入内存的同时,也会记录translog日志,一旦出现异常,

即可根据translog来恢复等到文件系统缓存中的segment都flush到磁盘是中时,translog文件才会清空

-------------------------------------------------------------------------------------------------------------

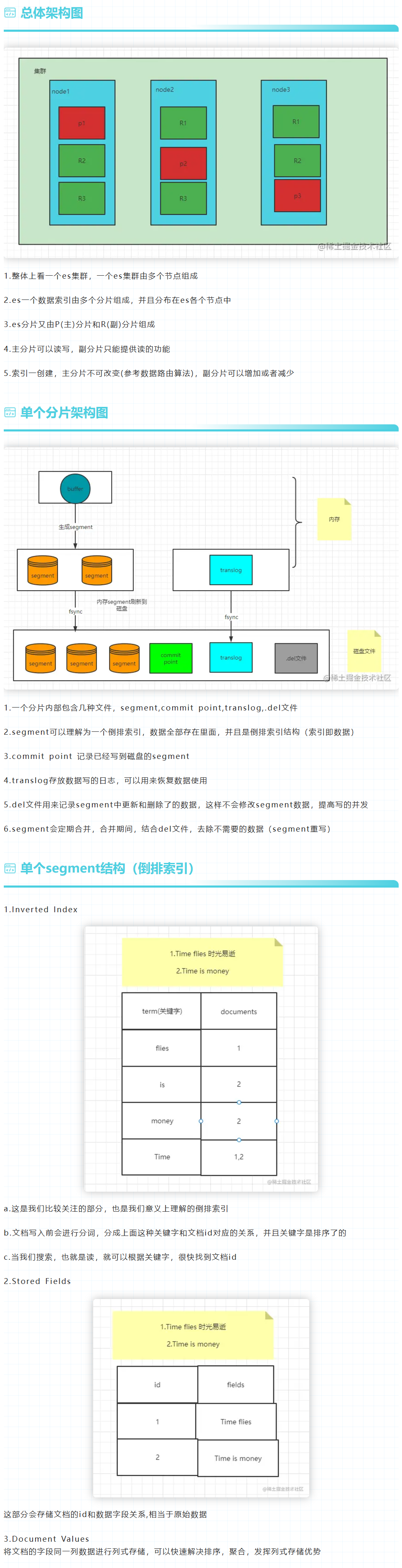

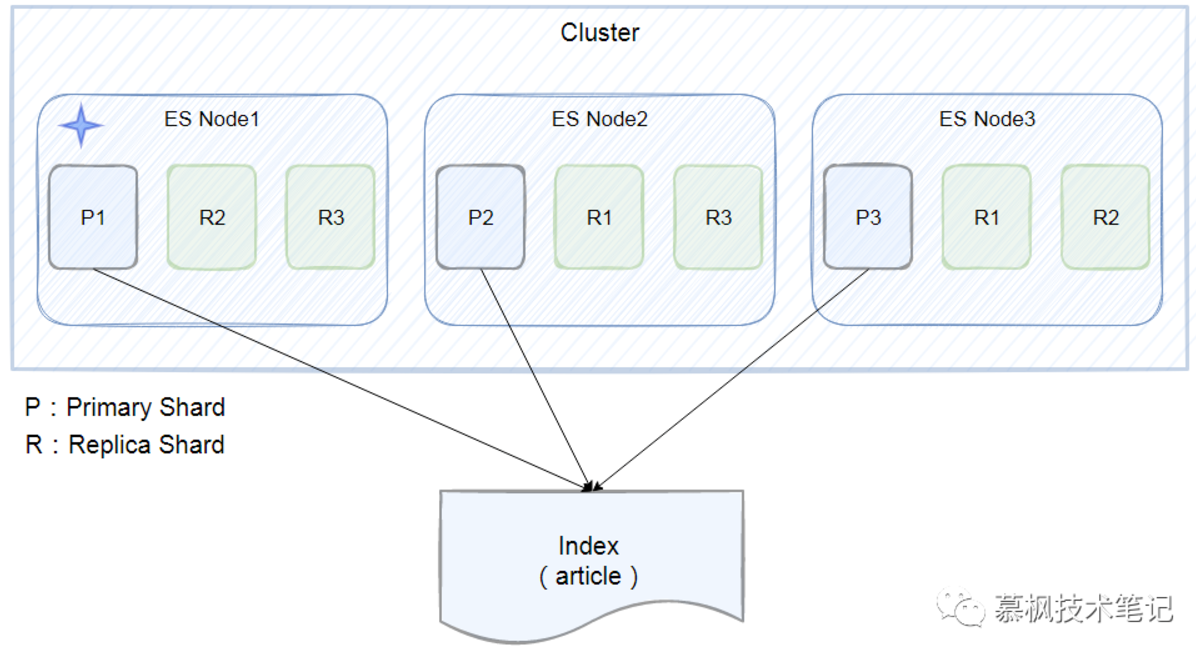

01.总体架构图

1.整体上看一个es集群,一个es集群由多个节点组成

2.es一个数据索引由多个分片组成,并且分布在es各个节点中

3.es分片又由P(主)分片和R(副)分片组成

4.主分片可以读写,副分片只能提供读的功能

5.索引一创建,主分片不可改变(参考数据路由算法),副分片可以增加或者减少

02.单个分片架构图

1.一个分片内部包含几种文件,segment,commit point,translog,.del文件

2.segment可以理解为一个倒排索引,数据全部存在里面,并且是倒排索引结构(索引即数据)

3.commit point 记录已经写到磁盘的segment

4.translog存放数据写的日志,可以用来恢复数据使用

5.del文件用来记录segment中更新和删除了的数据,这样不会修改segment数据,提高写的并发

6.segment会定期合并,合并期间,结合del文件,去除不需要的数据(segment重写)

03.单个segment结构(倒排索引)

1.Inverted Index

a.这是我们比较关注的部分,也是我们意义上理解的倒排索引

b.文档写入前会进行分词,分成上面这种关键字和文档id对应的关系,并且关键字是排序了的

c.当我们搜索,也就是读,就可以根据关键字,很快找到文档id

2.Stored Fields

这部分会存储文档的id和数据字段关系,相当于原始数据

3.Document Values

将文档的字段同一列数据进行列式存储,可以快速解决排序,聚合,发挥列式存储优势

1.3 架构2

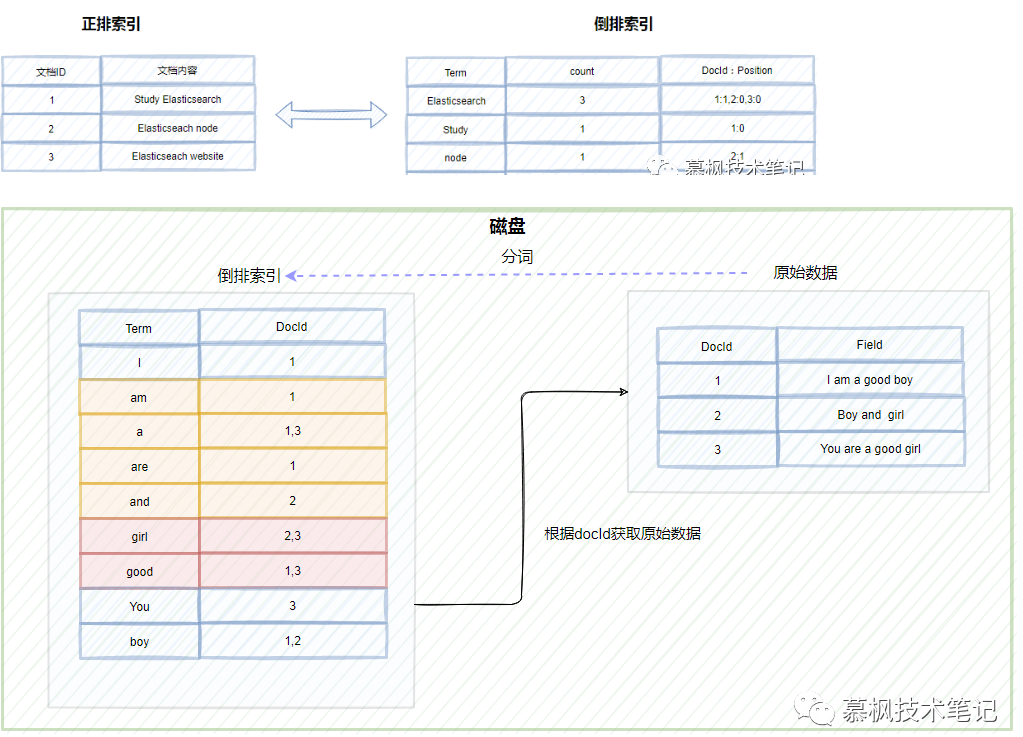

01.倒排索引

a.用B+树作为索引行不行呢?

全文索引就是需要支持对大文本进行索引的,从空间上来说 B+ 树不适合作为全文索引,

同时 B+ 树因为每次搜索都是从根节点开始往下搜索,所以会遵循最左匹配原则,

而我们使用全文搜索时,往往不会遵循最左匹配原则,所以可能会导致索引失效。这时候倒排索引就派上用场了。

b.倒排索引1

所谓正排索引就像书中的目录一样,根据页码查询内容,但是倒排索引确实相反的,它是通过对内容的分词,

建立内容到文档ID的关联关系。这样在进行全文检索的时候,根据词典的内容便可以精确以及模糊查询,

非常符合全文检索的要求。

c.倒排索引2

倒排索引的结构主要包括了两大部分一个是Term Dictionary(单词词典),另一个是Posting List(倒排列表)。

Term Dictionary(单词词典)记录了所用文档的单词以及单词和倒排列表的关系。

Posting List(倒排列表)则是记录了term在文档中的位置以及其他信息,

主要包括文档ID,词频(term在文档中出现的次数,用来计算相关性评分),位置以及偏移(实现搜索高亮)。

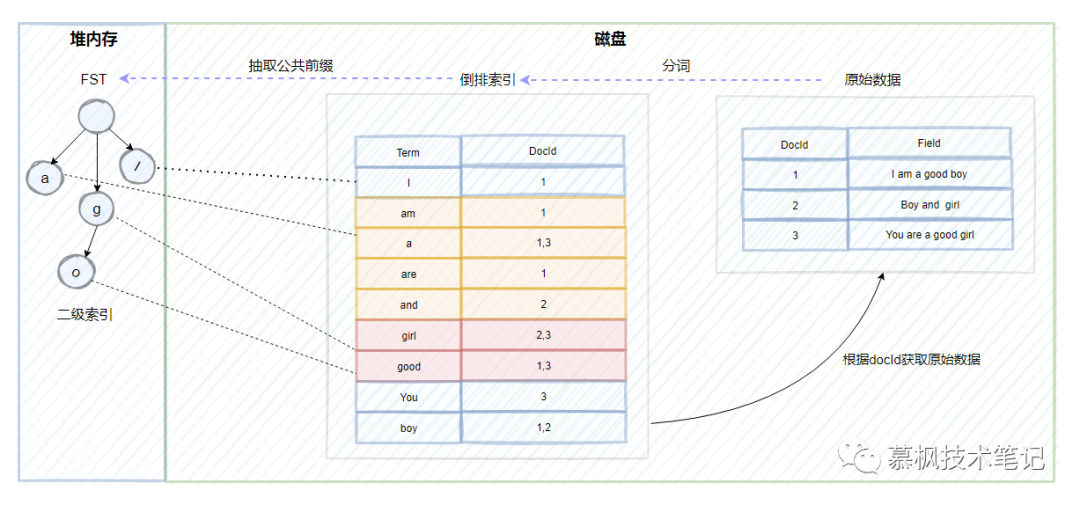

02.FST

a.介绍1

在进行全文检索的时候,通过倒排索引中term与docId的关联关系获取到原始数据。

但是这里有一个问题,ES底层依赖Lucene实现倒排索引的,因此在进行数据写入的时候,

Lucene会为原始数据中的每个term生成对应的倒排索引,因此造成的结果就是倒排索引的数据量就会很大。

而倒排索引对应的倒排表文件是存储在硬盘上的。如果每次查询都直接去磁盘中读取倒排索引数据,

在通过获取的docId再去查询原始数据的话,肯定会造成多次的磁盘IO,严重影响全文检索的效率。

因此我们需要一种方式可以快速定位到倒排索引中的term。

大家想想使用什么方式比较好呢?可以考虑HashMap, TRIE, Binary Search Tree或者Tenary Search Tree等数据结构,

实际上Lucene实际是使用了FST(Finite State Transducer)有限状态传感器来实现二级索引的设计,

它其实就是一种有限状态机。

b.介绍2

我们先来看下 trie树的结构,在Lucene中是这样做的,将倒排索引中具有公共前缀的term组成一个block,

如下图所示的cool以及copy,它们拥有co的公共前缀,按照类似前缀树的逻辑来构成trie树,

对应节点中携带block的首地址。我们来分析下trie树相比hashmap有什么优点?hashmap实现的是精准查找,

但是trie树不仅可以实现精准查找,另外由于其公共前缀的特性还可以实现模糊查找。

那我们再看trie树有什么地方可以再进行优化的地方?

-----------------------------------------------------------------------------------------------------

如上如所示,term中的school以及cool的后面字符是一致的,

因此我们可以通过将原先的trie树中的后缀字符进行合并来进一步的压缩空间。优化后的trie树就是FST。

-----------------------------------------------------------------------------------------------------

因此通过建立FST这个二级索引,可以实现倒排索引的快速定位,不需要经过多次的磁盘IO,搜索效率大大提高了。

不过需要注意的是FST是存储在堆内存中的,而且是常驻内存,大概占用50%-70%的堆内存,

因此这里也是我们在生产中可以进行堆内存优化的地方。

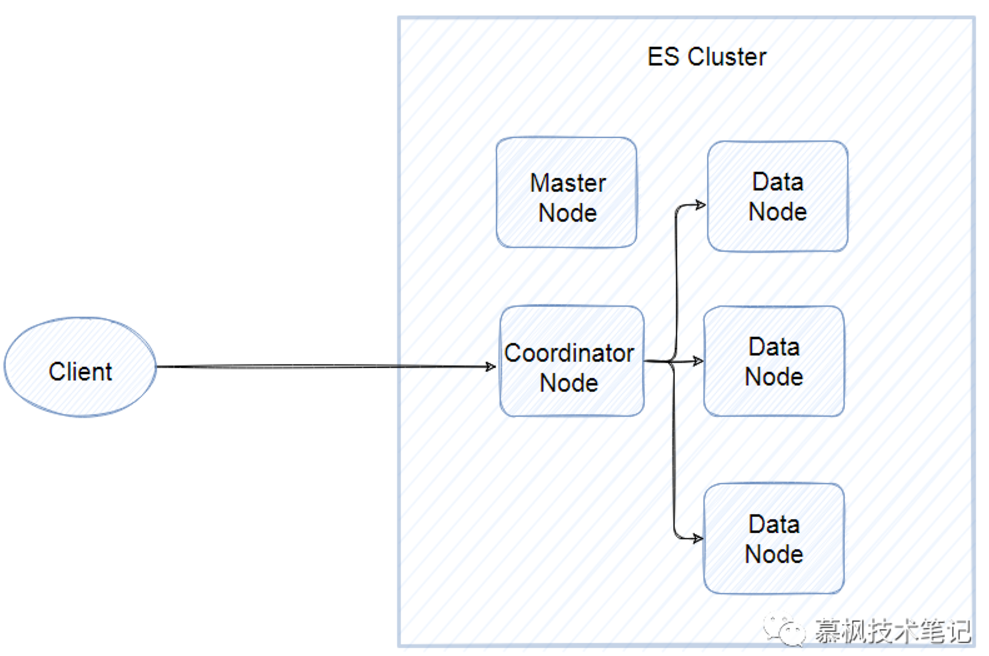

03.节点

所谓的节点实际就是ES的实例,我们通常在一台服务器部署一个ES实例,其实就是一个Java进程。

虽然都是ES实例,但是实际上的ES集群,不同节点承担着不同的能力角色,

有的是data node,主要负责保存分片的数据的,承担着数据横向扩展的重要作用,

有的是coordinating node负责将用户请求进行转发以及将查询的结果进行合并返回。

当然还有master节点,负责对整个集群状态进行管理和维护。

04.分片

单个ES节点的数据存储毕竟有限,没法实现海量数据的存储要求。那么怎么才能满足海量数据的存储要求呢?

一个核心思想就是拆分,比如总共10亿条数据,如果都放在一个节点中不仅查询以及数据写入的速度会很慢,

也存在单点问题。在传统关系型数据库中,采用分库分表的方式,用更多的数据库实例来承接大量的数据存储。

那么在ES中,也是采取类似的设计思想,既然一个ES的实例存在数据存储的上线,那么就用多个实例来进行存储。

在每个实例中存在的数据集合就是分片。如下图所示,index被切分成三个分片,三个分片分别存储在三个ES实例中

,同时为了提升数据的高可用性,每个主分片都有两个副本分片,这些副本分片是主分片的数据拷贝。

---------------------------------------------------------------------------------------------------------

这里需要注意的是,分片不是随意进行设定的,而是需要根据实际的生产环境提前进行数据存储的容量规划,

否则分片设置的过大或者过小都会影响ES集群的整体性能。如果分片设置的过小,那么单个分片的数据量可能会很大,

影响数据检索效率,也会影响数据的横向扩展。如果分片设置的过大就会影响搜索结果的数据相关性评分,影响数据检索的准确性。

倒排索引

FST

节点

分片

1.4 分词器

01.内置分词器

a.概念

ElasticSearch 核心功能就是数据检索,首先通过索引将文档写入 es。查询分析则主要分为两个步骤:

词条化:分词器将输入的文本转为一个一个的词条流。

过滤:比如停用词过滤器会从词条中去除不相干的词条(的,嗯,啊,呢);另外还有同义词过滤器、小写过滤器等。

b.内置分词器

| 分词器 | 作用

|----------------------|------------------------------

| Standard Analyzer | 标准分词器,适用于英语等。

| Simple Analyzer | 简单分词器,基于非字母字符进行分词,单词会被转为小写字母。

| Whitespace Analyzer | 空格分词器。按照空格进行切分。

| Stop Analyzer | 类似于简单分词器,但是增加了停用词的功能。

| Keyword Analyzer | 关键词分词器,输入文本等于输出文本。

| Pattern Analyzer | 利用正则表达式对文本进行切分,支持停用词。

| Language Analyzer | 针对特定语言的分词器。

| Fingerprint Analyzer | 指纹分析仪分词器,通过创建标记进行重复检测。

02.中文分词器

a.安装

首先打开分词器官网:https://github.com/medcl/elasticsearch-analysis-ik。

在 https://github.com/medcl/elasticsearch-analysis-ik/releases 页面找到最新的正式版,下载下来。我们这里的下载链接是 https://github.com/medcl/elasticsearch-analysis-ik/releases/download/v7.9.3/elasticsearch-analysis-ik-7.9.3.zip。

将下载文件解压。

在 es/plugins 目录下,新建 ik 目录,并将解压后的所有文件拷贝到 ik 目录下。

重启 es 服务。

b.自定义扩展词库

a.本地自定义

在 es/plugins/ik/config 目录下,新建 ext.dic 文件(文件名任意),在该文件中可以配置自定义的词库。

如果有多个词,换行写入新词即可。

然后在 es/plugins/ik/config/IKAnalyzer.cfg.xml 中配置扩展词典的位置:

-------------------------------------------------------------------------------------------------

IKAnalyzer.cfg.xml

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<entry key="ext_dict">custom/mydict.dic;custom/single_word_low_freq.dic</entry>

<entry key="ext_stopwords">custom/ext_stopword.dic</entry>

<entry key="remote_ext_dict">location</entry>

<entry key="remote_ext_stopwords">http://xxx.com/xxx.dic</entry>

</properties>

b.远程词库

也可以配置远程词库,远程词库支持热更新(不用重启 es 就可以生效)。

热更新只需要提供一个接口,接口返回扩展词即可。

具体使用方式如下,新建一个 Spring Boot 项目,引入 Web 依赖即可。然后在 resources/stastic 目录下新建 ext.dic 文件,写入扩展词:

接下来,在 es/plugins/ik/config/IKAnalyzer.cfg.xml 文件中配置远程扩展词接口:

配置完成后,重启 es ,即可生效。

热更新,主要是响应头的 Last-Modified 或者 ETag 字段发生变化,ik 就会自动重新加载远程扩展辞典。

c.测试

The plugin comprises analyzer:

a.创建索引

http://localhost:9200/test

b.测试分词

curl --location 'http://localhost:9200/test/_analyze' \

--header 'Content-Type: application/json' \

--data '{

"analyzer": "ik_max_word",

"text": "欢迎来到黑马"

}'

-------------------------------------------------------------------------------------------------

analyzer可选:

ik_smart

ik_max_word

03.官方文档

a.创建索引

curl -XPUT http://localhost:9200/index

b.创建映射

curl -XPOST http://localhost:9200/index/_mapping -H 'Content-Type:application/json' -d'

{

"properties": {

"content": {

"type": "text",

"analyzer": "ik_max_word",

"search_analyzer": "ik_smart"

}

}

}'

c.索引一些文档

curl -XPOST http://localhost:9200/index/_create/1 -H 'Content-Type:application/json' -d'

{"content":"美国留给伊拉克的是个烂摊子吗"}

'

-----------------------------------------------------------------------------------------------------

curl -XPOST http://localhost:9200/index/_create/2 -H 'Content-Type:application/json' -d'

{"content":"公安部:各地校车将享最高路权"}

'

-----------------------------------------------------------------------------------------------------

curl -XPOST http://localhost:9200/index/_create/3 -H 'Content-Type:application/json' -d'

{"content":"中韩渔警冲突调查:韩警平均每天扣1艘中国渔船"}

'

-----------------------------------------------------------------------------------------------------

curl -XPOST http://localhost:9200/index/_create/4 -H 'Content-Type:application/json' -d'

{"content":"中国驻洛杉矶领事馆遭亚裔男子枪击 嫌犯已自首"}

'

d.查询高亮

curl -XPOST http://localhost:9200/index/_search -H 'Content-Type:application/json' -d'

{

"query" : { "match" : { "content" : "中国" }},

"highlight" : {

"pre_tags" : ["<tag1>", "<tag2>"],

"post_tags" : ["</tag1>", "</tag2>"],

"fields" : {

"content" : {}

}

}

}

'

-----------------------------------------------------------------------------------------------------

{

"took": 14,

"timed_out": false,

"_shards": {

"total": 5,

"successful": 5,

"failed": 0

},

"hits": {

"total": 2,

"max_score": 2,

"hits": [

{

"_index": "index",

"_type": "fulltext",

"_id": "4",

"_score": 2,

"_source": {

"content": "中国驻洛杉矶领事馆遭亚裔男子枪击 嫌犯已自首"

},

"highlight": {

"content": [

"<tag1>中国</tag1>驻洛杉矶领事馆遭亚裔男子枪击 嫌犯已自首 "

]

}

},

{

"_index": "index",

"_type": "fulltext",

"_id": "3",

"_score": 2,

"_source": {

"content": "中韩渔警冲突调查:韩警平均每天扣1艘中国渔船"

},

"highlight": {

"content": [

"均每天扣1艘<tag1>中国</tag1>渔船 "

]

}

}

]

}

}

1.5 工作原理

01.写数据过程

客户端选择一个 node 发送请求过去,这个 node 就是 coordinating node (协调节点)。

coordinating node 对 document 进行路由,将请求转发给对应的 node(有 primary shard)。

实际的 node 上的 primary shard 处理请求,然后将数据同步到 replica node 。

coordinating node 如果发现 primary node 和所有 replica node 都搞定之后,就返回响应结果给客户端。

02.读数据过程

通过 doc id 来查询,会根据 doc id 进行 hash,判断出来当时把 doc id 分配到了哪个 shard 上面去,从那个 shard 去查询。

客户端发送请求到任意一个 node,成为 coordinate node 。

coordinate node 对 doc id 进行哈希路由,将请求转发到对应的 node,此时会使用 round-robin 随机轮询算法,在 primary shard 以及其所有 replica 中随机选择一个,让读请求负载均衡。

接收请求的 node 返回 document 给 coordinate node 。

coordinate node 返回 document 给客户端。

03.搜索数据过程

es 最强大的是做全文检索,就是比如你有三条数据:

java真好玩儿啊

java好难学啊

j2ee特别牛

---------------------------------------------------------------------------------------------------------

你根据 java 关键词来搜索,将包含 java 的 document 给搜索出来。es 就会给你返回:java 真好玩儿啊,java 好难学啊。

---------------------------------------------------------------------------------------------------------

客户端发送请求到一个 coordinate node 。

协调节点将搜索请求转发到所有的 shard 对应的 primary shard 或 replica shard ,都可以。

query phase:每个 shard 将自己的搜索结果(其实就是一些 doc id )返回给协调节点,由协调节点进行数据的合并、排序、分页等操作,产出最终结果。

fetch phase:接着由协调节点根据 doc id 去各个节点上拉取实际的 document 数据,最终返回给客户端。

---------------------------------------------------------------------------------------------------------

写请求是写入 primary shard,然后同步给所有的 replica shard;读请求可以从 primary shard 或 replica shard 读取,采用的是随机轮询算法。

04.写数据底层原理

先写入内存 buffer,在 buffer 里的时候数据是搜索不到的;同时将数据写入 translog 日志文件。

如果 buffer 快满了,或者到一定时间,就会将内存 buffer 数据 refresh 到一个新的 segment file 中,但是此时数据不是直接进入 segment file 磁盘文件,而是先进入 os cache 。这个过程就是 refresh 。

每隔 1 秒钟,es 将 buffer 中的数据写入一个新的 segment file ,每秒钟会产生一个新的磁盘文件 segment file ,这个 segment file 中就存储最近 1 秒内 buffer 中写入的数据。

但是如果 buffer 里面此时没有数据,那当然不会执行 refresh 操作,如果 buffer 里面有数据,默认 1 秒钟执行一次 refresh 操作,刷入一个新的 segment file 中。

操作系统里面,磁盘文件其实都有一个东西,叫做 os cache ,即操作系统缓存,就是说数据写入磁盘文件之前,会先进入 os cache ,先进入操作系统级别的一个内存缓存中去。只要 buffer 中的数据被 refresh 操作刷入 os cache 中,这个数据就可以被搜索到了。

---------------------------------------------------------------------------------------------------------

为什么叫 es 是准实时的? NRT ,全称 near real-time 。默认是每隔 1 秒 refresh 一次的,所以 es 是准实时的,因为写入的数据 1 秒之后才能被看到。可以通过 es 的 restful api 或者 java api ,手动执行一次 refresh 操作,就是手动将 buffer 中的数据刷入 os cache 中,让数据立马就可以被搜索到。只要数据被输入 os cache 中,buffer 就会被清空了,因为不需要保留 buffer 了,数据在 translog 里面已经持久化到磁盘去一份了。

重复上面的步骤,新的数据不断进入 buffer 和 translog,不断将 buffer 数据写入一个又一个新的 segment file 中去,每次 refresh 完 buffer 清空,translog 保留。随着这个过程推进,translog 会变得越来越大。当 translog 达到一定长度的时候,就会触发 commit 操作。

commit 操作发生第一步,就是将 buffer 中现有数据 refresh 到 os cache 中去,清空 buffer。然后,将一个 commit point 写入磁盘文件,里面标识着这个 commit point 对应的所有 segment file ,同时强行将 os cache 中目前所有的数据都 fsync 到磁盘文件中去。最后清空 现有 translog 日志文件,重启一个 translog,此时 commit 操作完成。

这个 commit 操作叫做 flush 。默认 30 分钟自动执行一次 flush ,但如果 translog 过大,也会触发 flush 。flush 操作就对应着 commit 的全过程,我们可以通过 es api,手动执行 flush 操作,手动将 os cache 中的数据 fsync 强刷到磁盘上去。

translog 日志文件的作用是什么?你执行 commit 操作之前,数据要么是停留在 buffer 中,要么是停留在 os cache 中,无论是 buffer 还是 os cache 都是内存,一旦这台机器死了,内存中的数据就全丢了。所以需要将数据对应的操作写入一个专门的日志文件 translog 中,一旦此时机器宕机,再次重启的时候,es 会自动读取 translog 日志文件中的数据,恢复到内存 buffer 和 os cache 中去。

translog 其实也是先写入 os cache 的,默认每隔 5 秒刷一次到磁盘中去,所以默认情况下,可能有 5 秒的数据会仅仅停留在 buffer 或者 translog 文件的 os cache 中,如果此时机器挂了,会丢失 5 秒钟的数据。但是这样性能比较好,最多丢 5 秒的数据。也可以将 translog 设置成每次写操作必须是直接 fsync 到磁盘,但是性能会差很多。

实际上你在这里,如果面试官没有问你 es 丢数据的问题,你可以在这里给面试官炫一把,你说,其实 es 第一是准实时的,数据写入 1 秒后可以搜索到;可能会丢失数据的。有 5 秒的数据,停留在 buffer、translog os cache、segment file os cache 中,而不在磁盘上,此时如果宕机,会导致 5 秒的数据丢失。

---------------------------------------------------------------------------------------------------------

总结一下,数据先写入内存 buffer,然后每隔 1s,将数据 refresh 到 os cache,到了 os cache 数据就能被搜索到(所以我们才说 es 从写入到能被搜索到,中间有 1s 的延迟)。每隔 5s,将数据写入 translog 文件(这样如果机器宕机,内存数据全没,最多会有 5s 的数据丢失),translog 大到一定程度,或者默认每隔 30mins,会触发 commit 操作,将缓冲区的数据都 flush 到 segment file 磁盘文件中。

数据写入 segment file 之后,同时就建立好了倒排索引。

05.删除/更新数据底层原理

如果是删除操作,commit 的时候会生成一个 .del 文件,里面将某个 doc 标识为 deleted 状态,那么搜索的时候根据 .del 文件就知道这个 doc 是否被删除了。

如果是更新操作,就是将原来的 doc 标识为 deleted 状态,然后新写入一条数据。

buffer 每 refresh 一次,就会产生一个 segment file ,所以默认情况下是 1 秒钟一个 segment file ,这样下来 segment file 会越来越多,此时会定期执行 merge。每次 merge 的时候,会将多个 segment file 合并成一个,同时这里会将标识为 deleted 的 doc 给物理删除掉,然后将新的 segment file 写入磁盘,这里会写一个 commit point ,标识所有新的 segment file ,然后打开 segment file 供搜索使用,同时删除旧的 segment file 。

06.底层 lucene

简单来说,lucene 就是一个 jar 包,里面包含了封装好的各种建立倒排索引的算法代码。我们用 Java 开发的时候,引入 lucene jar,然后基于 lucene 的 api 去开发就可以了。

通过 lucene,我们可以将已有的数据建立索引,lucene 会在本地磁盘上面,给我们组织索引的数据结构。

07.倒排索引

在搜索引擎中,每个文档都有一个对应的文档 ID,文档内容被表示为一系列关键词的集合。例如,文档 1 经过分词,提取了 20 个关键词,每个关键词都会记录它在文档中出现的次数和出现位置。

那么,倒排索引就是关键词到文档 ID 的映射,每个关键词都对应着一系列的文件,这些文件中都出现了关键词。

举个栗子。

有以下文档:

DocId Doc

1 谷歌地图之父跳槽 Facebook

2 谷歌地图之父加盟 Facebook

3 谷歌地图创始人拉斯离开谷歌加盟 Facebook

4 谷歌地图之父跳槽 Facebook 与 Wave 项目取消有关

5 谷歌地图之父拉斯加盟社交网站 Facebook

---------------------------------------------------------------------------------------------------------

对文档进行分词之后,得到以下倒排索引。

WordId Word DocIds

1 谷歌 1, 2, 3, 4, 5

2 地图 1, 2, 3, 4, 5

3 之父 1, 2, 4, 5

4 跳槽 1, 4

5 Facebook 1, 2, 3, 4, 5

6 加盟 2, 3, 5

7 创始人 3

8 拉斯 3, 5

9 离开 3

10 与 4

.. .. ..

另外,实用的倒排索引还可以记录更多的信息,比如文档频率信息,表示在文档集合中有多少个文档包含某个单词。

那么,有了倒排索引,搜索引擎可以很方便地响应用户的查询。比如用户输入查询 Facebook ,搜索系统查找倒排索引,从中读出包含这个单词的文档,这些文档就是提供给用户的搜索结果。

---------------------------------------------------------------------------------------------------------

要注意倒排索引的两个重要细节:

倒排索引中的所有词项对应一个或多个文档;

倒排索引中的词项根据字典顺序升序排列

上面只是一个简单的栗子,并没有严格按照字典顺序升序排列。

1.6 倒排索引

00.对比

a.概念区别

正向索引是最传统的,根据id索引的方式。但根据词条查询时,必须先逐条获取每个文档,然后判断文档中是否包含所需要的词条,是根据文档找词条的过程。

而倒排索引则相反,是先找到用户要搜索的词条,根据词条得到保护词条的文档的id,然后根据id获取文档。是根据词条找文档的过程。

b.正向索引

a.优点

可以给多个字段创建索引

根据索引字段搜索、排序速度非常快

b.缺点

根据非索引字段,或者索引字段中的部分词条查找时,只能全表扫描。

c.倒排索引

a.优点

根据词条搜索、模糊搜索时,速度非常快

b.缺点

只能给词条创建索引,而不是字段

无法根据字段做排序

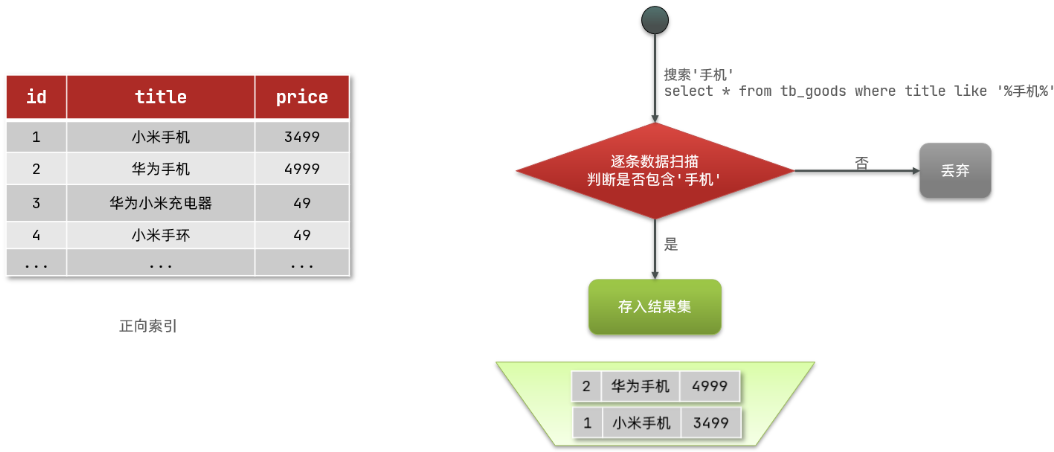

01.正向索引

a.介绍

设置了索引的话挺快的,但要是模糊查询则就很慢!

b.流程

那么什么是正向索引呢?例如给下表(tb_goods)中的id创建索引:

如果是根据id查询,那么直接走索引,查询速度非常快。

但如果是基于title做模糊查询,只能是逐行扫描数据,流程如下:

1)用户搜索数据,条件是title符合"%手机%"

2)逐行获取数据,比如id为1的数据

3)判断数据中的title是否符合用户搜索条件

4)如果符合则放入结果集,不符合则丢弃。回到步骤1

逐行扫描,也就是全表扫描,随着数据量增加,其查询效率也会越来越低。当数据量达到数百万时,就是一场灾难。

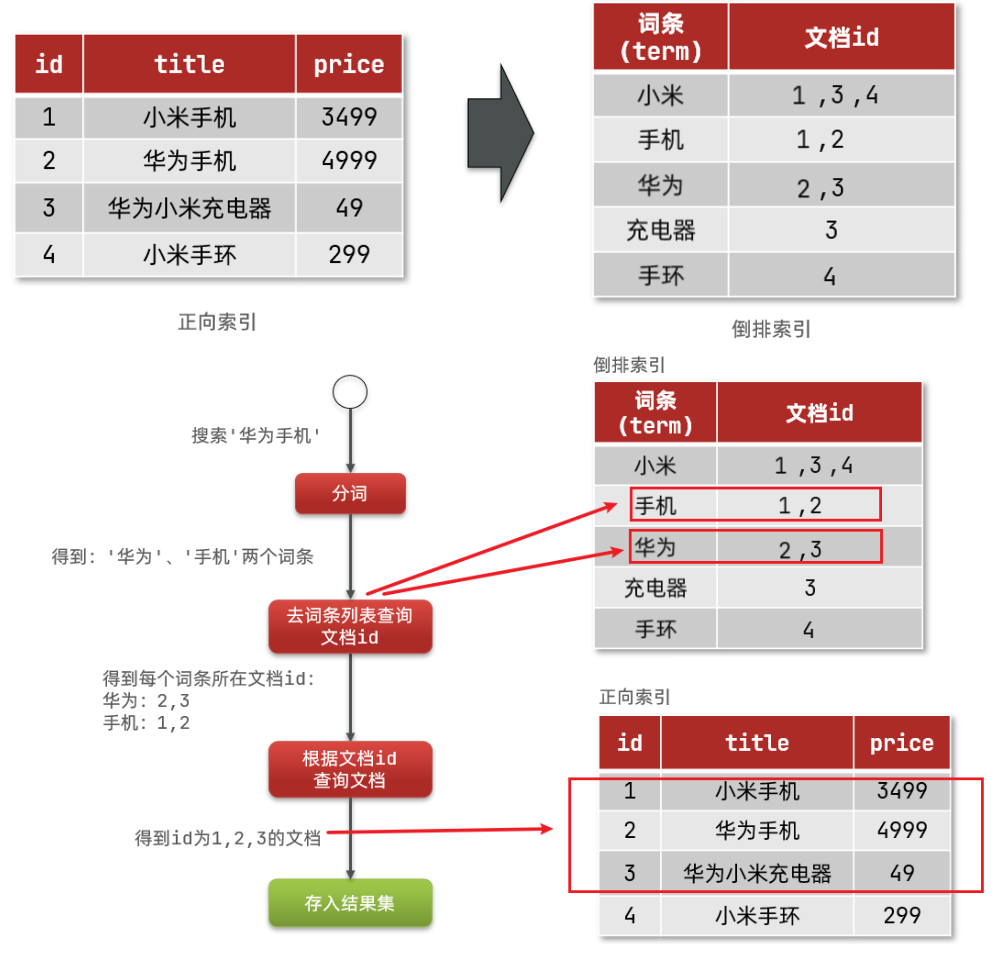

02.倒排索引

a.介绍

倒排索引中有两个非常重要的概念:

文档(Document):用来搜索的数据,其中的每一条数据就是一个文档。例如一个网页、一个商品信息

词条(Term):对文档数据或用户搜索数据,利用某种算法分词,得到的具备含义的词语就是词条。例如:我是中国人,就可以分为:我、是、中国人、中国、国人这样的几个词条

b.创建倒排索引是对正向索引的一种特殊处理,流程如下:

将每一个文档的数据利用算法分词,得到一个个词条

创建表,每行数据包括词条、词条所在文档id、位置等信息

因为词条唯一性,可以给词条创建索引,例如hash表结构索引

c.倒排索引的搜索流程如下(以搜索"华为手机"为例):

1)用户输入条件"华为手机"进行搜索。

2)对用户输入内容分词,得到词条:华为、手机。

3)拿着词条在倒排索引中查找,可以得到包含词条的文档id:1、2、3。

4)拿着文档id到正向索引中查找具体文档。

d.总结

虽然要先查询倒排索引,再查询倒排索引,但是无论是词条、还是文档id都建立了索引,查询速度非常快!无需全表扫描。

-----------------------------------------------------------------------------------------------------

一般来说,倒排索引分为两个部分:

单词词典(记录所有的文档词项,以及词项到倒排列表的关联关系)

倒排列表(记录单词与对应的关系,由一系列倒排索引项组成,

倒排索引项指:文档 id、

词频(TF)(词项在文档中出现的次数,评分时使用)、

位置(Position,词项在文档中分词的位置)、

偏移(记录词项开始和结束的位置)

)

正向索引

倒排索引

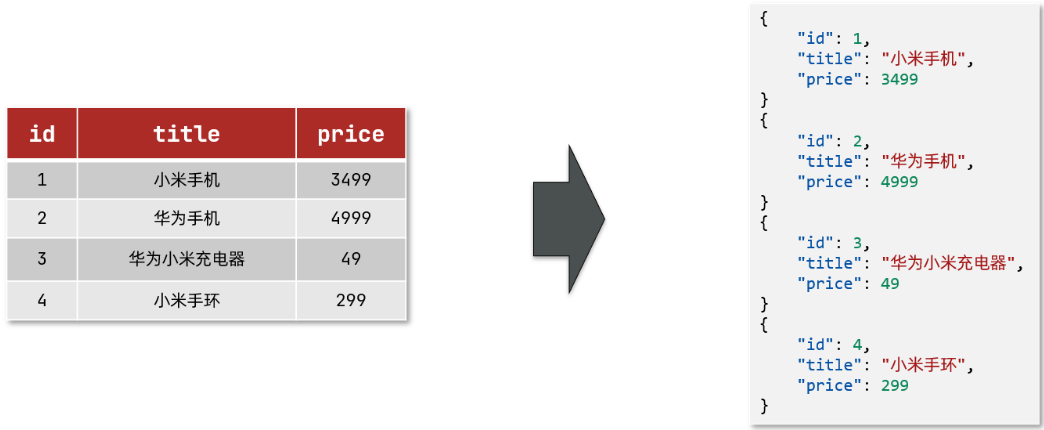

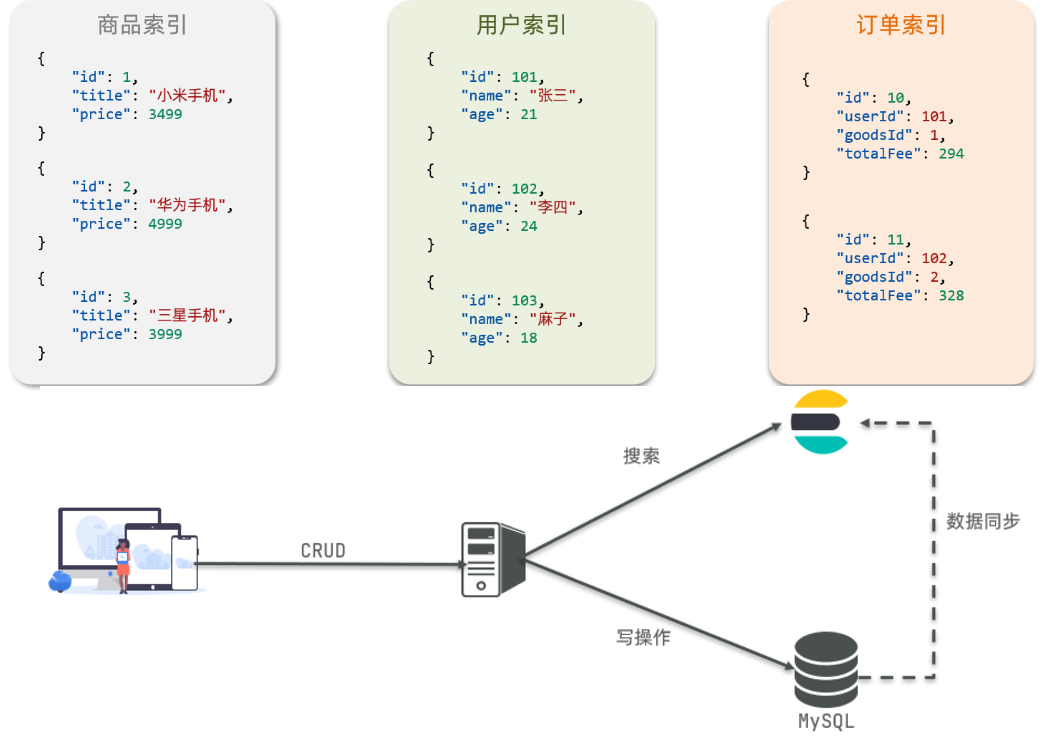

1.7 ES数据库

01.文档和字段

a.概念

一个文档就像数据库里的一条数据,字段就像数据库里的列

b.说明

elasticsearch是面向文档(Document)存储的,可以是数据库中的一条商品数据,一个订单信息。

文档数据会被序列化为json格式后存储在elasticsearch中,而Json文档中往往包含很多的字段(Field),类似于mysql数据库中的列。

02.索引和映射

a.概念

索引就像数据库里的表,映射就像数据库中定义的表结构

b.说明

索引(Index),就是相同类型的文档的集合【类似mysql中的表】

例如:

所有用户文档,就可以组织在一起,称为用户的索引;

所有商品的文档,可以组织在一起,称为商品的索引;

所有订单的文档,可以组织在一起,称为订单的索引;

-----------------------------------------------------------------------------------------------------

因此,我们可以把索引当做是数据库中的表。

数据库的表会有约束信息,用来定义表的结构、字段的名称、类型等信息。

因此,索引库中就有映射(mapping),是索引中文档的字段约束信息,类似表的结构约束。

03.mysql与elasticsearch

a.概念

Mysql:擅长事务类型操作,可以确保数据的安全和一致性

Elasticsearch:擅长海量数据的搜索、分析、计算

b.对比

| MySQL | Elasticsearch | 说明

|--------|---------------|----------------------------------------------------------

| Table | Index | 索引(index),就是文档的集合,类似数据库的表(table)

| Row | Document | 文档(Document),就是一条条的数据,类似数据库中的行(Row),文档都是JSON格式

| Column | Field | 字段(Field),就是JSON文档中的字段,类似数据库中的列(Column)

| Schema | Mapping | Mapping(映射)是索引中文档的约束,例如字段类型约束。类似数据库的表结构(Schema)

| SQL | DSL | DSL是elasticsearch提供的JSON风格的请求语句,用来操作elasticsearch,实现CRUD

c.在企业中,往往是两者结合使用:

对安全性要求较高的写操作,使用mysql实现

对查询性能要求较高的搜索需求,使用elasticsearch实现

两者再基于某种方式,实现数据的同步,保证一致性

文档和字段

索引和映射

1.8 锁和版本控制

01.介绍

a.概念

当我们使用 es 的 API 去进行文档更新时,它首先读取原文档出来,然后对原文档进行更新,

更新完成后再重新索引整个文档。不论你执行多少次更新,最终保存在 es 中的是最后一次更新的文档。

但是如果有两个线程同时去更新,就有可能出问题。

b.解决1:锁

a.悲观锁

很悲观,每一次去读取数据的时候,都认为别人可能会修改数据,所以屏蔽一切可能破坏数据完整性的操作。

关系型数据库中,悲观锁使用较多,例如行锁、表锁等等。

b.乐观锁

很乐观,每次读取数据时,都认为别人不会修改数据,因此也不锁定数据,只有在提交数据时,才会检查数据完整性。

这种方式可以省去锁的开销,进而提高吞吐量。

c.总结

在 es 中,实际上使用的就是乐观锁。

c.解决2:版本控制

a.介绍

在 es6.7 之前,使用 version+version_type 来进行乐观并发控制。

根据前面的介绍,文档每被修改一个,version 就会自增一次,es 通过 version 字段来确保所有的操作都有序进行。

version 分为内部版本控制和外部版本控制。

b.内部版本

es 自己维护的就是内部版本,当创建一个文档时,es 会给文档的版本赋值为 1。

每当用户修改一次文档,版本号就回自增 1。

如果使用内部版本,es 要求 version 参数的值必须和 es 文档中 version 的值相当,才能操作成功。

c.外部版本

在添加文档时,就指定版本号:

PUT blog/_doc/1?version=200&version_type=external

{

"title":"2222"

}

-------------------------------------------------------------------------------------------------

以后更新的时候,版本要大于已有的版本号。

vertion_type=external 或者 vertion_type=external_gt 表示以后更新的时候,版本要大于已有的版本号。

vertion_type=external_gte 表示以后更新的时候,版本要大于等于已有的版本号。

d.解决3:最新方案(Es6.7 之后)

a.介绍

现在使用 if_seq_no 和 if_primary_term 两个参数来做并发控制。

seq_no 不属于某一个文档,它是属于整个索引的(version 则是属于某一个文档的,每个文档的 version 互不影响)。

现在更新文档时,使用 seq_no 来做并发。由于 seq_no 是属于整个 index 的,所以任何文档的修改或者新增,

seq_no 都会自增。

b.现在就可以通过 seq_no 和 primary_term 来做乐观并发控制

PUT blog/_doc/2?if_seq_no=5&if_primary_term=1

{

"title":"6666"

}

2 ElasticSearch组成

2.1 汇总

01.组成

a.索引:表

创建索引库和映射

查询索引库

索引打开/关闭

复制索引

索引别名

修改索引库-字段

删除索引库

-----------------------------------------------------------------------------------------------------

修改索引库-副本数

修改索引库-切片数

修改索引库-读写权限

其他权限

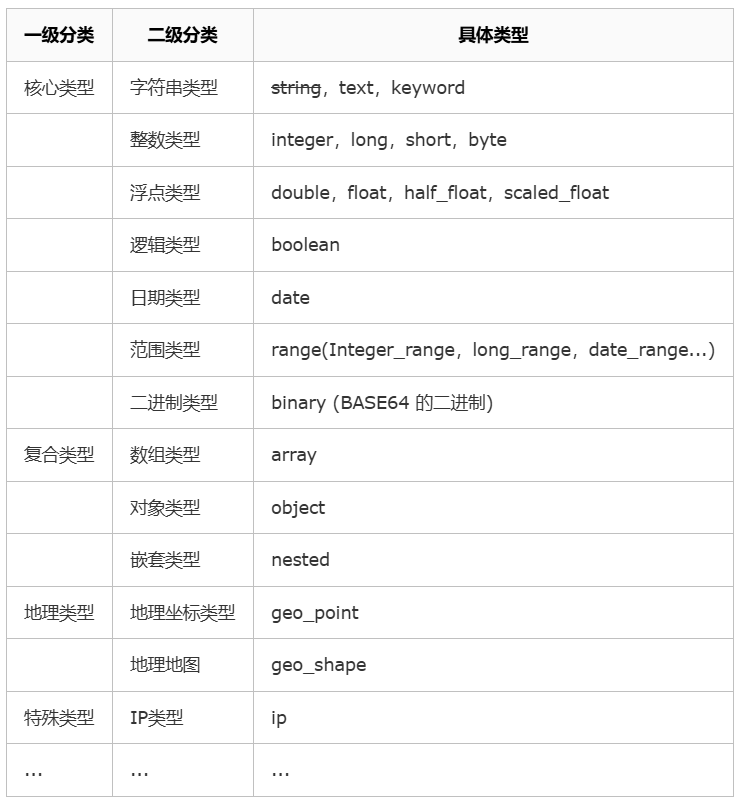

b.映射:表结构

mapping组成

23个映射参数

动态映射

动态模板

静态映射

c.文档:行,一条数据

INSERT

QUERY

UPDATE

DELETE

Bulk

-----------------------------------------------------------------------------------------------------

文档路由

文档路由-指定routing

d.字段:列,字段的值

字符串类型:string、text、keyword、数字类型、long、integer、short、byte、double、float、half_float、scaled_float

日期类型

布尔类型

二进制类型

范围类型:integer_range、float_range、long_range、double_range、date_range、ip_range

复合类型

地理类型

特殊类型

02._命令1

a.分类1

a._settings

用途:查询和修改索引的设置。

示例:GET /your_index/_settings

b._mapping

用途:查询和修改索引的字段映射。

示例:GET /your_index/_mapping

c._search

用途:执行查询以检索索引中的文档。

示例:GET /your_index/_search

d._bulk

用途:批量执行多个索引、删除或更新操作。

示例:POST /your_index/_bulk

e._delete_by_query

用途:根据查询条件批量删除文档。

示例:POST /your_index/_delete_by_query

f._refresh

用途:手动刷新索引,使所有操作可见。

示例:POST /your_index/_refresh

g._cat

用途:用于监控集群和索引的状态,以可读格式显示信息。

示例:GET /_cat/indices

h._alias

用途:管理索引的别名。

示例:POST /_aliases

i._reindex

用途:将数据从一个索引复制到另一个索引。

示例:POST /_reindex

j._analyze

用途:分析文本,返回分词结果。

示例:POST /your_index/_analyze

b.分类2

a._cluster

用途:与集群状态、健康等相关的操作。

示例:GET /_cluster/health

b._nodes

用途:查看节点的状态和配置信息。

示例:GET /_nodes

c._template

用途:管理索引模板。

示例:GET /_template

d._snapshot

用途:管理快照和备份。

示例:GET /_snapshot

2.2 索引:表

00.查询索引

a.方式1:多个index、多个type 查询

GET /your_index/_settings --要获取某个索引的所有设置信息

GET /your_index/_settings/number_of_shards --如果你只想查询特定的设置(例如分片数和复制数),可以在请求中获取相关信息

GET /_settings --要查看集群中所有索引的设置

GET /index1,index2/_settings --可以查询多个索引的设置

GET /your_index/_settings/analysis --如果索引中定义了分析器,想要查看分析器的详细设置

-----------------------------------------------------------------------------------------------------

GET /twitter/_search?q=user:shay --搜索 twitter 索引下面所有匹配条件的所有类型中文档

GET /twitter/tweet,user/_search?q=user:banon --一个索引下面指定多个 type 下匹配条件的文档

GET /twitter,elasticsearch/_search?q=tag:wow --搜索多个索引下匹配条件的文档

GET /_all/_search?q=tag:wow --搜索所有索引下匹配条件的文档

GET /_search?q=tag:wow --搜索所有索引及所有 type 下匹配条件的文档

-----------------------------------------------------------------------------------------------------

GET kibana_sample_data_ecommerce --查看索引相关信息

GET kibana_sample_data_ecommerce/_count --查看索引的文档总数

GET kibana_sample_data_ecommerce/_search --查看前10条文档,了解文档格式

GET /_cat/indices/kibana*?v&s=index --查看indices

GET /_cat/indices?v&health=green --查看状态为绿的索引

GET /_cat/indices?v&s=docs.count:desc --按照文档个数排序

GET /_cat/indices/kibana*?pri&v&h=health,index --查看具体的字段

GET /_cat/indices?v&h=i,tm&s=tm:desc --查看索引占用的内存

-----------------------------------------------------------------------------------------------------

集群 API

# 如果没有给出过滤器,默认是查询所有节点

GET /_nodes

# 查询所有节点

GET /_nodes/_all

# 查询本地节点

GET /_nodes/_local

# 查询主节点

GET /_nodes/_master

# 根据名称查询节点(支持通配符)

GET /_nodes/node_name_goes_here

GET /_nodes/node_name_goes_*

# 根据地址查询节点(支持通配符)

GET /_nodes/10.0.0.3,10.0.0.4

GET /_nodes/10.0.0.*

# 根据规则查询节点

GET /_nodes/_all,master:false

GET /_nodes/data:true,ingest:true

GET /_nodes/coordinating_only:true

GET /_nodes/master:true,voting_only:false

# 根据自定义属性查询节点(如:查询配置文件中含 node.attr.rack:2 属性的节点)

GET /_nodes/rack:2

GET /_nodes/ra*:2

GET /_nodes/ra*:2*

-----------------------------------------------------------------------------------------------------

集群健康 API

GET /_cluster/health

GET /_cluster/health?level=shards

GET /_cluster/health/kibana_sample_data_ecommerce,kibana_sample_data_flights

GET /_cluster/health/kibana_sample_data_flights?level=shards

-----------------------------------------------------------------------------------------------------

集群状态 API 返回表示整个集群状态的元数据。

GET /_cluster/state

-----------------------------------------------------------------------------------------------------

集群状态 API 返回表示整个集群状态的元数据。

GET /_cluster/state

-----------------------------------------------------------------------------------------------------

节点 API

# 查看默认的字段

GET /_cat/nodes?v=true

# 查看指定的字段

GET /_cat/nodes?v=true&h=id,ip,port,v,m

-----------------------------------------------------------------------------------------------------

分片 API

# 查看默认的字段

GET /_cat/shards

# 根据名称查询分片(支持通配符)

GET /_cat/shards/my-index-*

# 查看指定的字段

GET /_cat/shards?h=index,shard,prirep,state,unassigned.reason

-----------------------------------------------------------------------------------------------------

监控 API

通过 GET 请求发送 cat,下面列出了所有可用的 API:

GET /_cat

/_cat/allocation

/_cat/shards

/_cat/shards/{index}

/_cat/master

/_cat/nodes

/_cat/tasks

/_cat/indices

/_cat/indices/{index}

/_cat/segments

/_cat/segments/{index}

/_cat/count

/_cat/count/{index}

/_cat/recovery

/_cat/recovery/{index}

/_cat/health

/_cat/pending_tasks

/_cat/aliases

/_cat/aliases/{alias}

/_cat/thread_pool

/_cat/thread_pool/{thread_pools}

/_cat/plugins

/_cat/fielddata

/_cat/fielddata/{fields}

/_cat/nodeattrs

/_cat/repositories

/_cat/snapshots/{repository}

/_cat/templates

b.方式2:URI 搜索

Elasticsearch 支持用 uri 搜索,可用 get 请求里面拼接相关的参数,并用 curl 相关的命令就可以进行测试。

-----------------------------------------------------------------------------------------------------

GET twitter/_search?q=user:kimchy

{

"timed_out": false,

"took": 62,

"_shards": {

"total": 1,

"successful": 1,

"skipped": 0,

"failed": 0

},

"hits": {

"total": 1,

"max_score": 1.3862944,

"hits": [

{

"_index": "twitter",

"_type": "_doc",

"_id": "0",

"_score": 1.3862944,

"_source": {

"user": "kimchy",

"date": "2009-11-15T14:12:12",

"message": "trying out Elasticsearch",

"likes": 0

}

}

]

}

}

-----------------------------------------------------------------------------------------------------

URI 中允许的参数:

名称 描述

q 查询字符串,映射到 query_string 查询

df 在查询中未定义字段前缀时使用的默认字段

analyzer 查询字符串时指定的分词器

analyze_wildcard 是否允许通配符和前缀查询,默认设置为 false

batched_reduce_size 应在协调节点上一次减少的分片结果数。如果请求中潜在的分片数量很大,则应将此值用作保护机制,以减少每个搜索请求的内存开销

default_operator 默认使用的匹配运算符,可以是AND或者OR,默认是OR

lenient 如果设置为 true,将会忽略由于格式化引起的问题(如向数据字段提供文本),默认为 false

explain 对于每个 hit,包含了具体如何计算得分的解释

_source 请求文档内容的参数,默认 true;设置 false 的话,不返回_source 字段,可以使用**_source_include和_source_exclude**参数分别指定返回字段和不返回的字段

stored_fields 指定每个匹配返回的文档中的存储字段,多个用逗号分隔。不指定任何值将导致没有字段返回

sort 排序方式,可以是fieldName、fieldName:asc或者fieldName:desc的形式。fieldName 可以是文档中的实际字段,也可以是诸如_score 字段,其表示基于分数的排序。此外可以指定多个 sort 参数(顺序很重要)

track_scores 当排序时,若设置 true,返回每个命中文档的分数

track_total_hits 是否返回匹配条件命中的总文档数,默认为 true

timeout 设置搜索的超时时间,默认无超时时间

terminate_after 在达到查询终止条件之前,指定每个分片收集的最大文档数。如果设置,则在响应中多了一个 terminated_early 的布尔字段,以指示查询执行是否实际上已终止。默认为 no terminate_after

from 从第几条(索引以 0 开始)结果开始返回,默认为 0

size 返回命中的文档数,默认为 10

search_type 搜索的方式,可以是dfs_query_then_fetch或query_then_fetch。默认为query_then_fetch

allow_partial_search_results 是否可以返回部分结果。如设置为 false,表示如果请求产生部分结果,则设置为返回整体故障;默认为 true,表示允许请求在超时或部分失败的情况下获得部分结果

pretty 美化,GET /kibana_sample_data_ecommerce/_search?pretty=true

01.索引库的CRUD

a.CRUD简单描述

创建索引库:PUT /索引库名

查询索引库:GET /索引库名

删除索引库:DELETE /索引库名

修改索引库(添加字段):PUT /索引库名/_mapping

-----------------------------------------------------------------------------------------------------

索引名称不能有大写字母

索引名是唯一的,不能重复,重复创建会出错

-----------------------------------------------------------------------------------------------------

Kibana的Dev Tools,执行相关的DSL命令

b.创建索引库和映射

PUT /heima

{

"mappings": {

"properties": {

"column1":{

"type": "text",

"analyzer": "ik_smart"

},

"column2":{

"type": "keyword",

"index": "false"

},

"column3":{

"properties": {

"子字段1": {

"type": "keyword"

},

"子字段2": {

"type": "keyword"

}

}

}

}

}

}

c.查询索引库

GET /heima

GET /heima/_settings --heima

GET /heima,test/_settings --heima,test

GET /_all/_settings --全部

d.索引打开/关闭

同时关闭/打开多个索引,多个索引用 , 隔开,或者直接使用 _all 代表所有索引

POST /heima/_close --关闭索引

POST /heima/_open --打开索引

e.复制索引

索引复制,只会复制数据,不会复制索引配置。

POST _reindex

{

"source": {"index":"heima"},

"dest": {"index":"heima_new"}

}

f.索引别名

为索引创建别名,如果这个别名是唯一的,该别名可以代替索引名称。

POST /_aliases

{

"actions": [

{

"add": {

"index": "heima",

"alias": "heima_alias"

}

}

]

}

-----------------------------------------------------------------------------------------------------

将 add 改为 remove 就表示移除别名:

POST /_aliases

{

"actions": [

{

"remove": {

"index": "heima",

"alias": "heima_alias"

}

}

]

}

-----------------------------------------------------------------------------------------------------

查看某一个索引的别名:

GET /heima/_alias

-----------------------------------------------------------------------------------------------------

查看某一个别名对应的索引(book_alias 表示一个别名):

GET /heima_alias/_alias

-----------------------------------------------------------------------------------------------------

可以查看集群上所有可用别名:

GET /_alias

g.修改索引库-字段

这里的修改是只能增加新的字段到mapping中

倒排索引结构虽然不复杂,但是一旦数据结构改变(比如改变了分词器),就需要重新创建倒排索引,这简直是灾难。

因此索引库一旦创建,无法修改mapping。

虽然无法修改mapping中已有的字段,但是却允许添加新的字段到mapping中,因为不会对倒排索引产生影响。

-----------------------------------------------------------------------------------------------------

PUT /heima/_mapping

{

"properties": {

"age":{

"type": "integer"

}

}

}

h.删除索引库

DELETE /heima

DELETE /index_one,index_two

DELETE /index_*

02.索引库的配置

a.修改索引库-副本数

PUT /heima/_settings

{

"number_of_replicas": 2

}

b.修改索引库-切片数

PUT /heima/_settings

{

"number_of_shards": 2

}

c.修改索引库-读写权限

PUT /heima/_settings

{

"blocks.write": true

}

d.其他权限

blocks.write

blocks.read

blocks.read_only

-------------------------------------------------------------------------------------------------------------

01.字段数据类型

a.普通类型

binary (opens new window):编码为 Base64 字符串的二进制值。

boolean (opens new window):布尔类型,值为 true 或 false。

Keywords (opens new window):keyword 族类型,包括 keyword、constant_keyword 和 wildcard。

Numbers (opens new window):数字类型,如 long 和 double

Dates:日期类型,包括 date (opens new window)和 date_nanos (opens new window)。

alias (opens new window):用于定义存在字段的别名。

b.对象类型

object (opens new window):JSON 对象

flattened (opens new window):整个 JSON 对象作为单个字段值。

nested (opens new window):保留其子字段之间关系的 JSON 对象。

join (opens new window):为同一索引中的文档定义父/子关系。

c.结构化数据类型

Range (opens new window):范围类型,例如:long_range、double_range、date_range 和 ip_range。

ip (opens new window):IPv4 和 IPv6 地址。

version (opens new window):版本号。支持 Semantic Versioning (opens new window)优先规则。

murmur3 (opens new window):计算并存储 hash 值。

d.聚合数据类型

aggregate_metric_double (opens new window):预先聚合的指标值

histogram (opens new window):直方图式的预聚合数值。

e.文本搜索类型

text fields (opens new window):text 族类型,包括 text 和 match_only_text。

annotated-text (opens new window):包含特殊标记的文本。用于识别命名实体。

completion (opens new window):用于自动补全。

search_as_you_type (opens new window):键入时完成的类似文本的类型。

token_count (opens new window):文本中标记的计数。

f.文档排名类型

dense_vector (opens new window):记录浮点数的密集向量。

rank_feature (opens new window):记录一个数字特征,为了在查询时提高命中率。

rank_features (opens new window):记录多个数字特征,为了在查询时提高命中率。

g.空间数据类型

geo_point (opens new window):地理经纬度

geo_shape (opens new window):复杂的形状,例如多边形

point (opens new window):任意笛卡尔点

shape (opens new window):任意笛卡尔几何形状

h.其他类型

percolator (opens new window):使用 Query DSL (opens new window)编写的索引查询

02.元数据字段

a.标识元数据字段

_index (opens new window):文档所属的索引。

_id (opens new window):文档的 ID。

b.文档 source 元数据字段

_source (opens new window):文档正文的原始 JSON。

_size (opens new window):_source 字段的大小(以字节为单位),由 mapper-size (opens new window)插件提供。

c.文档计数元数据字段

_doc_count (opens new window):当文档表示预聚合数据时,用于存储文档计数的自定义字段。

d.索引元数据字段

_field_names (opens new window):文档中的所有非空字段。

_ignored (opens new window):文档中所有的由于 ignore_malformed (opens new window)而在索引时被忽略的字段。

e.路由元数据字段

_routing (opens new window):将文档路由到特定分片的自定义路由值。

f.其他元数据字段

_meta (opens new window):应用程序特定的元数据。

_tier (opens new window):文档所属索引的当前数据层首选项。

03.映射参数

a.分类1

analyzer (opens new window):指定在索引或搜索文本字段时用于文本分析的分析器。

coerce (opens new window):如果开启,Elasticsearch 将尝试清理脏数据以适应字段的数据类型。

copy_to (opens new window):允许将多个字段的值复制到一个组字段中,然后可以将其作为单个字段进行查询。

doc_values (opens new window):默认情况下,所有字段都是被

dynamic (opens new window):是否开启动态映射。

b.分类2

eager_global_ordinals (opens new window):当在 global ordinals 的时候,refresh 以后下一次查询字典就需要重新构建,在追求查询的场景下很影响查询性能。可以使用 eager_global_ordinals,即在每次 refresh 以后即可更新字典,字典常驻内存,减少了查询的时候构建字典的耗时。

enabled (opens new window):只能应用于顶级 mapping 定义和 object 字段。设置为 false 后,Elasticsearch 解析时,会完全跳过该字段。

fielddata (opens new window):默认情况下, text 字段是可搜索的,但不可用于聚合、排序或脚本。如果为字段设置 fielddata=true,就会通过反转倒排索引将 fielddata 加载到内存中。请注意,这可能会占用大量内存。如果想对 text 字段进行聚合、排序或脚本操作,fielddata 是唯一方法。

fields (opens new window):有时候,同一个字段需要以不同目的进行索引,此时可以通过 fields 进行配置。

format (opens new window):用于格式化日期类型。

c.分类3

ignore_above (opens new window):字符串长度大于 ignore_above 所设,则不会被索引或存储。

ignore_malformed (opens new window):有时候,同一个字段,可能会存储不同的数据类型。默认情况下,Elasticsearch 解析字段数据类型失败时,会引发异常,并拒绝整个文档。 如果设置 ignore_malformed 为 true,则允许忽略异常。这种情况下,格式错误的字段不会被索引,但文档中的其他字段可以正常处理。

index_options (opens new window)用于控制将哪些信息添加到倒排索引以进行搜索和突出显示。只有 text 和 keyword 等基于术语(term)的字段类型支持此配置。

index_phrases (opens new window):如果启用,两个词的组合(shingles)将被索引到一个单独的字段中。这允许以更大的索引为代价,更有效地运行精确的短语查询(无 slop)。请注意,当停用词未被删除时,此方法效果最佳,因为包含停用词的短语将不使用辅助字段,并将回退到标准短语查询。接受真或假(默认)。

index_prefixes (opens new window):index_prefixes 参数启用 term 前缀索引以加快前缀搜索。

d.分类4

index (opens new window):index 选项控制字段值是否被索引。默认为 true。

meta (opens new window):附加到字段的元数据。此元数据对 Elasticsearch 是不透明的,它仅适用于多个应用共享相同索引的元数据信息,例如:单位。

normalizer (opens new window):keyword 字段的 normalizer 属性类似于 analyzer (opens new window),只是它保证分析链只产生单个标记。 normalizer 在索引 keyword 之前应用,以及在搜索时通过查询解析器(例如匹配查询)或通过术语级别查询(例如术语查询)搜索关键字字段时应用。

norms (opens new window):norms 存储在查询时使用的各种规范化因子,以便计算文档的相关性评分。

null_value (opens new window):null 值无法被索引和搜索。当一个字段被设为 null,则被视为没有值。null_value 允许将空值替换为指定值,以便对其进行索引和搜索。

e.分类5

position_increment_gap (opens new window):分析的文本字段会考虑术语位置,以便能够支持邻近或短语查询。当索引具有多个值的文本字段时,值之间会添加一个“假”间隙,以防止大多数短语查询在值之间匹配。此间隙的大小使用 position_increment_gap 配置,默认为 100。

properties (opens new window):类型映射、对象字段和嵌套字段包含的子字段,都称为属性。这些属性可以是任何数据类型,包括对象和嵌套。

search_analyzer (opens new window):通常,在索引时和搜索时应使用相同的分析器,以确保查询中的术语与倒排索引中的术语格式相同。但是,有时在搜索时使用不同的分析器可能是有意义的,例如使用 edge_ngram (opens new window)标记器实现自动补全或使用同义词搜索时。

similarity (opens new window):Elasticsearch 允许为每个字段配置文本评分算法或相似度。相似度设置提供了一种选择文本相似度算法的简单方法,而不是默认的 BM25,例如布尔值。只有 text 和 keyword 等基于文本的字段类型支持此配置。

store (opens new window):默认情况下,对字段值进行索引以使其可搜索,但不会存储它们。这意味着可以查询该字段,但无法检索原始字段值。通常这不重要,字段值已经是默认存储的 _source 字段的一部分。如果您只想检索单个字段或几个字段的值,而不是整个 _source,则可以通过 source filtering (opens new window)来实现。

term_vector (opens new window):term_vector 包含有关分析过程产生的术语的信息,包括:术语列表、每个 term 的位置(或顺序)、起始和结束字符偏移量,用于将 term 和原始字符串进行映射、有效负载(如果可用) - 用户定义的,与 term 位置相关的二进制数据

04.映射配置

index.mapping.total_fields.limit:索引中的最大字段数。字段和对象映射以及字段别名计入此限制。默认值为 1000。

index.mapping.depth.limit:字段的最大深度,以内部对象的数量来衡量。例如,如果所有字段都在根对象级别定义,则深度为 1。如果有一个对象映射,则深度为 2,以此类推。默认值为 20。

index.mapping.nested_fields.limit:索引中不同 nested 映射的最大数量。 nested 类型只应在特殊情况下使用,即需要相互独立地查询对象数组。为了防止设计不佳的映射,此设置限制了每个索引的唯一 nested 类型的数量。默认值为 50。

index.mapping.nested_objects.limit:单个文档中,所有 nested 类型中包含的最大嵌套 JSON 对象数。当文档包含太多 nested 对象时,此限制有助于防止出现内存溢出。默认值为 10000。

index.mapping.field_name_length.limit:设置字段名称的最大长度。默认为 Long.MAX_VALUE(无限制)。

2.3 映射:表结构

00.查询映射

a.查询整个索引的映射

GET /your_index/_mapping --要获取某个索引的所有映射信息

b.查询特定字段的映射

GET /your_index/_mapping/field/your_field_name --如果只想查询特定字段的映射信息,可以在请求中指定字段名

c.查询多个字段的映射

GET /your_index/_mapping/field/field1,field2 --可以一次性查询多个字段的映射

d.查询所有索引的映射

GET /_mapping --要查看集群中所有索引的映射

e.查询指定类型的映射(如果适用)

GET /your_index/_mapping/your_type_name --在使用类型的版本中,可以查询特定类型的映射(Elasticsearch 7.x 之后不再支持类型)

f.使用嵌套字段的映射查询

GET /your_index/_mapping/field/name.firstName --对于嵌套字段,你可以指定路径查询映射信息

00.Mapping映射

a.mapping组成

a.组成1:metadata元数据字段用于自定义如何处理文档关联的元数据。例如:

_index:用于定义document属于哪个index

_type:类型,已经移除的概念

_id:document的唯一id

_source:存放原始的document数据

_size:_source字段中存放的数据的大小

b.组成2:mapping中包含的field,包含字段的类型和参数。本文主要介绍的mapping参数就需要在field中去定义。例如:

type:设置字段对应的类型,常见的有text,keyword等

analyzer:指定一个用来文本分析的索引或者搜索text字段的分析器 应用于索引以及查询

c.常见的mapping属性

type:字段数据类型,常见的简单类型有:

字符串:text(可分词的文本)、keyword(精确值,例如:品牌、国家、ip地址),keyword类型只能整体搜索,不支持搜索部分内容

数值:long、integer、short、byte、double、float、

布尔:boolean

日期:date

对象:object

index:是否创建索引,默认为true

analyzer:使用哪种分词器

properties:该字段的子字段

b.23个映射参数

a.分类1

analyzer(分析器):定义字段使用的分析器,决定如何将文本拆分为词条。

normalizer(归一化器):主要用于 keyword 类型的字段,指定一个归一化器来处理统一大小写、去除空格等。

boost(提升):为字段指定权重,影响搜索结果中的相关性评分。

coerce(强制类型转换):如果设置为 true,Elasticsearch 会尝试将值强制转换为正确的类型(如将字符串转换为数字)。

copy_to(合并参数):将字段的值复制到另一个字段中,通常用于聚合搜索条件。

b.分类2

doc_values(文档值):用于排序、聚合和脚本的预先计算的值,通常 keyword 和 numeric 类型使用它。

dynamic(动态设置):定义是否允许动态添加字段(true/false/strict)。

enabled(开启字段):用于完全启用或禁用一个字段。如果 enabled: false,字段不会被索引。

fielddata(字段数据):用于在 text 类型字段上启用排序和聚合。

format(日期格式):为 date 类型字段指定日期格式(如 yyyy-MM-dd)。

c.分类3

ignore_above(忽略超越限制的字段):忽略超过指定长度的字符串,常用于 keyword 类型字段。

ignore_malformed(忽略格式不对的数据):忽略格式不正确的字段值,避免引发错误。

include_in_all(_all 查询包含字段):已废弃,早期用于控制字段是否包含在 _all 字段中进行全文搜索。

index_options(索引设置):定义索引时记录哪些信息,通常是 docs、freqs 或 positions。

index(索引):控制字段是否可被索引,如果设置为 false,该字段不能用于搜索。

d.分类4

fields(字段):允许为同一个字段定义多种表示形式,比如文本字段可以有 text 和 keyword 两种类型。

norms(标准信息):控制是否存储归一化信息(用于相关性评分),通常对 text 类型字段有用。

null_value(空值):为 null 值指定一个默认值,防止 null 值引起查询问题。

position_increment_gap(短语位置间隙):定义在多个值之间的短语查询时的间隔。

properties(属性):用于定义复杂对象(如 object 或 nested 类型)的子字段。

e.分类5

search_analyzer(搜索分析器):为字段指定搜索时使用的分析器(可以不同于索引时的分析器)。

similarity(相似度模型):控制字段的相似度计算方式,常见的有 BM25 和 classic 等模型。

store(存储):控制字段是否以源文档之外的方式单独存储,通常是 false。

term_vectors(词根信息):定义是否存储字段的词条向量及其位置信息、偏移信息等,通常用于高级搜索和分析。

c.示例

a.例如下面的json文档

{

"age": 21,

"weight": 52.1,

"isMarried": false,

"info": "真相只有一个!",

"email": "zy@itcast.cn",

"score": [99.1, 99.5, 98.9],

"name": {

"firstName": "柯",

"lastName": "南"

}

}

b.对应的每个字段映射(mapping)

age:类型为 integer;参与搜索,因此需要index为true;无需分词器

weight:类型为float;参与搜索,因此需要index为true;无需分词器

isMarried:类型为boolean;参与搜索,因此需要index为true;无需分词器

info:类型为字符串,需要分词,因此是text;参与搜索,因此需要index为true;分词器可以用ik_smart

email:类型为字符串,但是不需要分词,因此是keyword;不参与搜索,因此需要index为false;无需分词器

score:虽然是数组,但是我们只看元素的类型,类型为float;参与搜索,因此需要index为true;无需分词器

name:类型为object,需要定义多个子属性

name.firstName;类型为字符串,但是不需要分词,因此是keyword;参与搜索,因此需要index为true;无需分词器

name.lastName;类型为字符串,但是不需要分词,因此是keyword;参与搜索,因此需要index为true;无需分词器

d.es中动态映射类型推断方式如下

JSON中的数据 自动推断出来的数据类型

null 没有字段被添加

true/false boolean

浮点数字 float

数字 long

JSON对象 object

数组 数组中的第一个非空值来决定

string text/keyword/date/double/long都有可能

-------------------------------------------------------------------------------------------------------------

01.动态映射

a.介绍

顾名思义,就是自动创建出来的映射。es 根据存入的文档,自动分析出来文档中字段的类型以及存储方式,这种就是动态映射。

在创建好的索引信息中,可以看到,mappings 为空,这个 mappings 中保存的就是映射信息。

-----------------------------------------------------------------------------------------------------

现在我们向索引中添加一个文档,如下:

PUT blog/_doc/1

{

"title":"1111",

"date":"2020-11-11"

}

-----------------------------------------------------------------------------------------------------

文档添加成功后,就会自动生成 Mappings

可以看到,date 字段的类型为 date,title 的类型有两个,text 和 keyword。

,文档中如果新增了字段,mappings 中也会自动新增进来。

b.动态映射还有一个日期检测的问题

例如新建一个索引,然后添加一个含有日期的文档,如下:

PUT blog/_doc/1

{

"remark":"2020-11-11"

}

-----------------------------------------------------------------------------------------------------

添加成功后,remark 字段会被推断是一个日期类型。

-----------------------------------------------------------------------------------------------------

此时,remark 字段就无法存储其他类型了。

PUT blog/_doc/1

{

"remark":"javaboy"

}

-----------------------------------------------------------------------------------------------------

此时报错如下:

{

"error" : {

"root_cause" : [

{

"type" : "mapper_parsing_exception",

"reason" : "failed to parse field [remark] of type [date] in document with id '1'. Preview of field's value: 'javaboy'"

}

],

"type" : "mapper_parsing_exception",

"reason" : "failed to parse field [remark] of type [date] in document with id '1'. Preview of field's value: 'javaboy'",

"caused_by" : {

"type" : "illegal_argument_exception",

"reason" : "failed to parse date field [javaboy] with format [strict_date_optional_time||epoch_millis]",

"caused_by" : {

"type" : "date_time_parse_exception",

"reason" : "Failed to parse with all enclosed parsers"

}

}

},

"status" : 400

}

-----------------------------------------------------------------------------------------------------

要解决这个问题,可以使用静态映射,即在索引定义时,将 remark 指定为 text 类型。也可以关闭日期检测。

PUT blog

{

"mappings": {

"date_detection": false

}

}

此时日期类型就回当成文本来处理。

c.es中动态映射类型推断方式如下

JSON中的数据 自动推断出来的数据类型

null 没有字段被添加

true/false boolean

浮点数字 float

数字 long

JSON对象 object

数组 数组中的第一个非空值来决定

string text/keyword/date/double/long都有可能

02.动态模板

a.介绍

在Elasticsearch中,动态模板(Dynamic Templates) 是一种用于自动处理字段映射的机制。

它允许你为新添加的字段动态定义其映射,而不需要在每次添加新字段时显式地定义其映射。

b.动态模板通常用于以下场景:

处理多种类型的文档,尤其是字段名称和类型不确定的情况。

根据字段名称或数据类型自动设置字段的映射属性。

c.示例 1:根据字段类型定义动态模板

在这个示例中,所有字符串类型的字段都将被映射为 text 类型,而所有数字类型的字段都将被映射为 float 类型。

PUT /my_index

{

"mappings": {

"dynamic_templates": [

{

"strings_as_text": {

"match_mapping_type": "string", // 匹配所有字符串类型

"mapping": {

"type": "text" // 将其映射为 text 类型

}

}

},

{

"numbers_as_float": {

"match_mapping_type": "long", // 匹配所有长整型

"mapping": {

"type": "float" // 将其映射为 float 类型

}

}

}

]

}

}

d.示例 2:根据字段名称定义动态模板

在这个示例中,所有以 date_ 开头的字段将被映射为 date 类型,所有以 user_ 开头的字段将被映射为 keyword 类型。

PUT /my_index

{

"mappings": {

"dynamic_templates": [

{

"dates": {

"match": "date_*", // 匹配以 date_ 开头的字段

"mapping": {

"type": "date" // 将其映射为 date 类型

}

}

},

{

"users": {

"match": "user_*", // 匹配以 user_ 开头的字段

"mapping": {

"type": "keyword" // 将其映射为 keyword 类型

}

}

}

]

}

}

e.示例 3:更复杂的动态模板

以下示例展示了一个更复杂的动态模板,可以根据字段名称和类型同时进行匹配。

PUT /my_index

{

"mappings": {

"dynamic_templates": [

{

"strings": {

"match_mapping_type": "string", // 匹配所有字符串类型

"mapping": {

"type": "text",

"analyzer": "ik_max_word" // 使用 IK 分词器

}

}

},

{

"numbers": {

"match_mapping_type": "float", // 匹配所有浮点数类型

"mapping": {

"type": "float",

"null_value": 0.0 // 将 null 值转换为 0.0

}

}

}

]

}

}

03.静态映射

a.dynamic属性

有的时候,如果希望新增字段时,能够抛出异常来提醒开发者,这个可以通过 mappings 中 dynamic 属性来配置。

dynamic 属性有三种取值:

true,默认即此。自动添加新字段。

false,忽略新字段。

strict,严格模式,发现新字段会抛出异常。

b.具体配置方式如下,创建索引时指定 mappings(这其实就是静态映射)

PUT blog

{

"mappings": {

"dynamic":"strict",

"properties": {

"title":{

"type": "text"

},

"age":{

"type":"long"

}

}

}

}

-----------------------------------------------------------------------------------------------------

然后向 blog 中索引中添加数据:

PUT blog/_doc/2

{

"title":"1111",

"date":"2020-11-11",

"age":99

}

-----------------------------------------------------------------------------------------------------

在添加的文档中,多出了一个 date 字段,而该字段没有预定义,所以这个添加操作就回报错

{

"error" : {

"root_cause" : [

{

"type" : "strict_dynamic_mapping_exception",

"reason" : "mapping set to strict, dynamic introduction of [date] within [_doc] is not allowed"

}

],

"type" : "strict_dynamic_mapping_exception",

"reason" : "mapping set to strict, dynamic introduction of [date] within [_doc] is not allowed"

},

"status" : 400

}

-------------------------------------------------------------------------------------------------------------

01.analyzer(分析器):定义字段使用的分析器,决定如何将文本拆分为词条。

a.介绍

a.概念

指定分词器。elasticsearch是一款支持全文检索的分布式存储系统,对于text类型的字段,

首先会使用分词器进行分词,然后将分词后的词根一个一个存储在倒排索引中,后续查询主要是针对词根的搜索。

b.analyzer该参数可以在查询、字段、索引级别中指定,其优先级如下(越靠前越优先)

1.字段上定义的分词器

2.索引配置中定义的分词器

3.默认分词器(standard)

c.在查询上下文,分词器的查找优先为

1.full-text query中定义的分词器

2.定义类型映射时字段中search_analyzer定义的分词器

3.定义字段映射时analyzer定义的分词器

4.索引中default_search中定义的分词器

5.索引中默认定义的分词器

6.标准分词器(standard)

d.analyzer:指定字段在索引时如何分词。search_analyzer:指定字段在搜索时如何分词。

查询时候的分词器。

默认情况下,如果没有配置search_analyzer,则查询时,首先查看有没有search_analyzer,有的话,就用search_analyzer来进行分词,

如果没有,则看有没有analyzer,如果有,则用analyzer来进行分词,否则使用es默认的分词器。

-------------------------------------------------------------------------------------------------

search_analyzer 不是分词器本身,而是用于指定搜索时使用的分词器。

当你对一个字段进行搜索时,search_analyzer 控制输入的查询文本如何被分词,

而这个分词器可以与索引时使用的分词器(analyzer)不同

-------------------------------------------------------------------------------------------------

两者可以是相同的,也可以不同。

比如,通常你可能希望在索引时使用一个分词精度更高的分词器,而在搜索时使用一个简单的分词器以提高搜索性能。

-----------------------------------------------------------------------------------------------------

假设你有一个文本字段,你希望在索引时使用精细的 ik_max_word 分词器,而在搜索时使用较简单的 ik_smart 分词器,可以这样配置

PUT /my_index

{

"mappings": {

"properties": {

"content": {

"type": "text",

"analyzer": "ik_max_word",

"search_analyzer": "ik_smart"

}

}

}

}

在索引文档时,Elasticsearch 会使用 analyzer 定义的分词器将字段内容进行分词和存储。

在用户进行查询时,Elasticsearch 会使用 search_analyzer 定义的分词器来处理查询词。

b.假设不用分词器,我们先来看一下索引的结果

a.创建一个索引并添加一个文档

# 添加索引

PUT /blog

# 添加文档

PUT /blog/_doc/1

{

"title": "定义文本字段的分词器。默认对索引l和查询都是有效的。"

}

b.查看词条向量(_termvectors)

GET /blog/_termvectors/1

{

"fields": ["title"]

}

-------------------------------------------------------------------------------------------------

可以看到,默认情况下,中文就是一个字一个字的分,这种分词方式没有任何意义。

c.如果这样分词,查询就只能按照一个字一个字来查,像下面这样

GET /blog/_search

{

"query": {

"term": {

"title": "定"

}

}

}

-------------------------------------------------------------------------------------------------

无意义

c.配置合适分词器

a.设置ik_smart

PUT blog

{

"mappings": {

"properties": {

"title": {

"type": "text",

"analyzer": "ik_smart"

}

}

}

}

b.存储文档

PUT /blog/_doc/1

{

"title": "定义文本字段的分词器。默认对索引l和查询都是有效的。"

}

c.查看词条向量(_termvectors)

GET /blog/_termvectors/1

{

"fields": ["title"]

}

-------------------------------------------------------------------------------------------------

"都是" : {

"term_freq" : 1,

"tokens" : [

{

"position" : 11,

"start_offset" : 20,

"end_offset" : 22

}

]

},

"默认" : {

"term_freq" : 1,

"tokens" : [

{

"position" : 5,

"start_offset" : 11,

"end_offset" : 13

}

]

d.查询_search

GET /blog/_search

{

"query": {

"term": {

"title": "定"

}

}

}

-------------------------------------------------------------------------------------------------

{

"took" : 0,

"timed_out" : false,

"_shards" : {

"total" : 1,

"successful" : 1,

"skipped" : 0,

"failed" : 0

},

"hits" : {

"total" : {

"value" : 1,

"relation" : "eq"

},

"max_score" : 0.2876821,

"hits" : [

{

"_index" : "blog",

"_type" : "_doc",

"_id" : "1",

"_score" : 0.2876821,

"_source" : {

"title" : "定义文本字段的分词器。默认对索引l和查询都是有效的。"

}

}

]

}

}

02.normalizer(归一化器):主要用于 keyword 类型的字段,指定一个归一化器来处理统一大小写、去除空格等。

a.介绍

normalizer参数用于解析前(索引或者查询)的标准化配置。

比如,在es中,对于一些我们不想切分的字符串,我们通常会将其设置为keyword,搜索时候也是使用整个词进行搜索。

如果在索引前 没有做好数据清洗,导致大小写不一致,例如javaboy和JAVABOY,

此时,我们就可以使用normalizer在索引之前以及查询之前进行文档的标准化。

-----------------------------------------------------------------------------------------------------

规划化,主要针对keyword类型,在索引该字段或查询字段之前,

可以先对原始数据进行一些简单的处理,然后再将处理后的结果当成一个词根存入倒排索引中

b.示例

PUT index

{

"settings": {

"analysis": {

"normalizer": {

"my_normalizer": { // @1

"type": "custom",

"char_filter": [],

"filter": ["lowercase", "asciifolding"] // @2

}

}

}

},

"mappings": {

"_doc": {

"properties": {

"foo": {

"type": "keyword",

"normalizer": "my_normalizer" // @3

}

}

}

}

}

-----------------------------------------------------------------------------------------------------

代码@1:首先在settings中的analysis属性中定义normalizer。

代码@2:设置标准化过滤器,示例中的处理器为小写、asciifolding。

代码@3:在定义映射时,如果字段类型为keyword,可以使用normali

zer引用定义好的normalizer。

03.boost(提升):为字段指定权重,影响搜索结果中的相关性评分。

a.介绍

权重值,可以提升在查询时的权重,对查询相关性有直接的影响,其默认值为1.0。其影响范围为词根查询(team que-ry),对前缀、范围查询、全文索引(match query)不生效。

注意:不建议在创建索引映射时使用boost属性,而是在查询时通过boost参数指定。其主要原因如下:

无法动态修改字段中定义的boost值,除非使用reindex命令重建索引。

相反,如果在查询时指定boost值,每一个查询都可以使用不同的boost值,灵活。

在索引中指定boost值,boost存储在记录中,从而会降低分数计算的质量。

-----------------------------------------------------------------------------------------------------

boost 参数可以设置字段的权重。

boost 有两种使用思路,一种就是在定义 mappings 的时候使用,在指定字段类型时使用;另一种就是在查询时使用。

实际开发中建议使用后者,前者有问题:如果不重新索引文档,权重无法修改。

b.mapping 中使用 boost(不推荐)

PUT blog

{

"mappings": {

"properties": {

"content":{

"type": "text",

"boost": 2

}

}

}

}

c.另一种方式就是在查询的时候,指定 boost

GET blog/_search

{

"query": {

"match": {

"content": {

"query": "你好",

"boost": 2

}

}

}

}

04.coerce(强制类型转换):如果设置为 true,Elasticsearch 会尝试将值强制转换为正确的类型(如将字符串转换为数字)。

a.介绍

是否进行类型“隐式转换”。es最终存储文档的格式是字符串。

coerce 用来清除脏数据,默认为 true。

b.示例1

例如一个数字,在 JSON 中,用户可能写错了:

{"age":"99"}

或者 :

{"age":"99.0"}

这些都不是正确的数字格式。

-----------------------------------------------------------------------------------------------------

通过 coerce 可以解决该问题。

默认情况下,以下操作没问题,就是 coerce 起作用:

PUT blog

{

"mappings": {

"properties": {

"age":{

"type": "integer"

}

}

}

}

POST blog/_doc

{

"age":"99.0"

}

-----------------------------------------------------------------------------------------------------

如果需要修改 coerce ,方式如下:

PUT blog

{

"mappings": {

"properties": {

"age":{

"type": "integer",

"coerce": false

}

}

}

}

POST blog/_doc

{

"age":99

}

-----------------------------------------------------------------------------------------------------

当 coerce 修改为 false 之后,数字就只能是数字了,不可以是字符串,该字段传入字符串会报错。

c.示例2

例如存在如下字段类型:

"number_one": {

"type": "integer"

}

声明number_one字段的类型为数字类型,那是否允许接收“6”字符串形式的数据呢?

因为在JSON中,“6”是可以用来赋给int类型的字段。默认coerce为tru-e,表示允许这种赋值,

但如coerce设置为false,此时es只能接受不带双引号的数字,如果在coerce=false时,

将“6”赋值给number_one时会抛出类型不匹配异常。

-----------------------------------------------------------------------------------------------------

可以在创建索引时指定默认的coerce值,示例如下:

PUT my_index

{

"settings": {

"index.mapping.coerce": false

},

"mappings": {

// 省略字段映射定义

}

}

05.copy_to(合并参数):将字段的值复制到另一个字段中,通常用于聚合搜索条件。

a.介绍

这个属性,可以将多个字段的值,复制到同一个字段中。

copy_to参数允许您创建自定义的_all字段。换句话说,多个字段的值可以被复制到一个字段.

例如,将first_name和la-st_name字段复制到full_name

b.示例1

PUT blog

{

"mappings": {

"properties": {

"title":{

"type": "text",

"copy_to": "full_content"

},

"content":{

"type": "text",

"copy_to": "full_content"

},

"full_content":{

"type": "text"

}

}

}

}

PUT blog/_doc/1

{

"title":"你好江南一点雨",

"content":"当 coerce 修改为 false 之后,数字就只能是数字了,不可以是字符串,该字段传入字符串会报错。"

}

GET blog/_search

{

"query": {

"term": {

"full_content": "当"

}

}

}

c.示例2

PUT my_index

{

"mappings": {

"_doc": {

"properties": {

"first_name": {

"type": "text",

"copy_to": "full_name"

},

"last_name": {

"type": "text",

"copy_to": "full_name"

},

"full_name": {

"type": "text"

}

}

}

}

}

-----------------------------------------------------------------------------------------------------

表示字段full_name的值来自first_nam-e+last_name。

关于copy_to重点说明:

字段的复制是原始值,而不是分词后的词根。

复制字段不会包含在_souce字段中,但可以使用复制字段进行查询。

同一个字段可以复制到多个字段,写法如下:"copy_to": [ "field_1", "field_2" ]

06.doc_values(文档值):用于排序、聚合和脚本的预先计算的值,通常 keyword 和 numeric 类型使用它。

a.介绍

当需要对一个字段进行排序时,es需要提取匹配结果集中的排序字段值集合,然后进行排序。

倒排索引的数据结构对检索来说相当高效,但对排序就不那么擅长了。

-----------------------------------------------------------------------------------------------------

业界对排序、聚合非常高效的数据存储格式首推列式存储,在elasticsearch中,doc_values就是一种列式存储结构,

绝大多数数据类型doc_values默认为ture,即在索引时会将字段的值(或分词后的词根序列)加入到倒排索引中,

同时也会该字段的值加入doc_values中,所有该类型的索引下该字段的值用一列存储

-----------------------------------------------------------------------------------------------------

es 中的搜索主要是用到倒排索引,doc_values 参数是为了加快排序、聚合操作而生的。当建立倒排索引的时候,会额外增加列式存储映射。

doc_values 默认是开启的,如果确定某个字段不需要排序或者不需要聚合,那么可以关闭 doc_values。

大部分的字段在索引时都会生成 doc_values,除了 text。text 字段在查询时会生成一个 fielddata 的数据结构,fieldata 在字段首次被聚合、排序的时候生成。

-----------------------------------------------------------------------------------------------------

doc_values felddata

索引时创建 使用时动态创建

磁盘 内存

不占用内存 不占用磁盘

索引速度稍微低一点 文档很多时,动态创建慢,占内存

-----------------------------------------------------------------------------------------------------

doc_values 默认开启,fielddata 默认关闭。

b.doc_values 演示:

PUT users

PUT users/_doc/1

{

"age":100

}

PUT users/_doc/2

{

"age":99

}

PUT users/_doc/3

{

"age":98

}

PUT users/_doc/4

{

"age":101

}

GET users/_search

{

"query": {

"match_all": {}

},

"sort":[

{

"age":{

"order": "desc"

}

}

]

}

c.由于 doc_values 默认时开启的,所以可以直接使用该字段排序,如果想关闭 doc_values ,如下

PUT users

{

"mappings": {

"properties": {

"age":{

"type": "integer",

"doc_values": false

}

}

}

}

PUT users/_doc/1

{

"age":100

}

PUT users/_doc/2

{

"age":99

}

PUT users/_doc/3

{

"age":98

}

PUT users/_doc/4

{

"age":101

}

GET users/_search

{

"query": {

"match_all": {}

},

"sort":[

{

"age":{

"order": "desc"

}

}

]

}

d.代码

PUT my_index

{

"mappings": {

"_doc": {

"properties": {

"status_code": {

"type": "keyword" // 默认情况下,“doc_values”:true

},

"session_id": {

"type": "keyword",

"doc_values": false

}

}

}

}

}

07.dynamic(动态设置):定义是否允许动态添加字段(true/false/strict)。

a.介绍

是否允许动态的隐式增加字段。在执行index api或更新文档API时,对于_sour-ce字段中包含一些原先未定义的字段采取的措施,根据dynamic的取值,会进行不同的操作:

true,默认值,表示新的字段会加入到类型映射中。

false,新的字段会被忽略,即不会存入_souce字段中,即不会存储新字段,也无法通过新字段进行查询。

strict,会显示抛出异常,需要新使用put mapping api先显示增加字段映射。

b.示例

可以通过put mapping api对dynamic值进行更新

PUT my_index/_doc/1

{

"username": "johnsmith",

"name": {

"first": "John",

"last": "Smith"

}

}

PUT my_index/_doc/2 // @1

{

"username": "marywhite",

"email": "mary@white.com",

"name": {

"first": "Mary",

"middle": "Alice",

"last": "White"

}

}

GET my_index/_mapping // @2

-----------------------------------------------------------------------------------------------------

代码@1在原有的映射下,增加了user-name,name.middle两个字段,

通过代码@2获取映射API可以得知,es已经为原本不存在的字段自动添加了类型映射定义。

c.示例

dynamic只对当前层级具有约束力

PUT my_index

{

"mappings": {

"_doc": {

"dynamic": false, // @1

"properties": {

"user": { // @2

"properties": {

"name": {

"type": "text"

},

"social_networks": { // @3

"dynamic": true,

"properties": {}

}

}

}

}

}

}

}

-----------------------------------------------------------------------------------------------------

代码@1:_doc类型的顶层不能不支持动态隐式添加字段映射。

代码@2:但_doc的嵌套对象user对象,是支持动态隐式添加字段映射。

代码@3:同样对于嵌套对象social_n-etworks,也支持动态隐式添加字段映射。

08.enabled(开启字段):用于完全启用或禁用一个字段。如果 enabled: false,字段不会被索引。

a.介绍

enabled属性,用来对映射类型(_type)和object类型的字段来启用或禁用索引功能,

如果enabled属性设置为false,表示只存储,但不创建索引,意味者无法使用该字段的值进行查询。

-----------------------------------------------------------------------------------------------------

es 默认会索引所有的字段,但是有的字段可能只需要存储,不需要索引。此时可以通过 enabled 字段来控制

b.示例

PUT blog

{

"mappings": {

"properties": {

"title":{

"enabled": false

}

}

}

}

PUT blog/_doc/1

{

"title":"javaboy"

}

GET blog/_search

{

"query": {

"term": {

"title": "javaboy"

}

}

}

-----------------------------------------------------------------------------------------------------

设置了 enabled 为 false 之后,就可以再通过该字段进行搜索了。

c.示例

PUT my_index

{

"mappings": {

"_doc": {

"properties": {

"user_id": {

"type": "keyword"

},

"last_updated": {

"type": "date"

},

"session_data": {

"enabled": false

}

}

}

}

}

PUT my_index/_doc/session_1

{

"user_id": "kimchy",

"session_data": {

"arbitrary_object": {

"some_array": [ "foo", "bar", { "baz": 2 } ]

}

},

"last_updated": "2015-12-06T18:20:22"

}

-----------------------------------------------------------------------------------------------------

上述示例,es会存储session_data对象的数据,但无法通过查询API根据sessi-on_data中的属性进行查询。

同样,可以通过put mapping api更新enabled属性。

09.fielddata(字段数据):用于在 text 类型字段上启用排序和聚合。

a.介绍

为了解决排序与聚合,elasticsearch提供了doc_values属性来支持列式存储,但doc_values不支持text字段类型。因为text字段是需要先分析(分词),会影响doc_values列式存储的性能。

Elasticsearch为了支持文本字段高效排序与聚合,引入了一种新的数据结构(fielddata),使用内存进行存储。

默认是在第一次聚合查询、排序操作时构建,主要存储倒排索引中的词根与文档的映射关系,聚合、排序操作在内存中执行。因此fielddata需要消耗大量的JVM堆内存。一旦fielddata加载到内存后,它将永久存在。

通常情况下,加载fielddata是一个昂贵的操作,故默认情况下,文本类型的字段默认是不开启fielddata机制。在使用fielddata之前请慎重考虑其必要性。

通常text字段用来进行全文搜索,对于聚合、排序字段,建议使用doc_values机制。

为了节省内存的使用,es提供了另一项机制(fielddata_frequency_filter),允许只加载那些词根频率在指定范围(最大,小值)直接的词根与文档的映射关系,最大最小值可以指定为绝对值,例如数字,也可以基于百分比(百分比的计算是基于整个分段(segment),其频率分母不是分段(segment)中所有的文档,而是segment中该字段有值的文档)。

可以通过min_segment_size参数来指定分段中必须包含的最小文档数量来排除小段,也就是说可以控制fielddata_freq-uency_filter的作用范围是包含大于min_-segment_size的文档数量的段。

b.示例

PUT my_index

{

"mappings": {

"_doc": {

"properties": {

"tag": {

"type": "text",

"fielddata": true,

"fielddata_frequency_filter": {

"min": 0.001,

"max": 0.1,

"min_segment_size": 500

}

}

}

}

}

}

10.format(日期格式):为 date 类型字段指定日期格式(如 yyyy-MM-dd)。

a.介绍

在JSON文档中,日期表示为字符串。Elasticsearch使用一组预先配置的格式来识别和解析这些字符串,

并将其解析为long类型的数值(毫秒)。

-----------------------------------------------------------------------------------------------------

日期格式主要包括如下3种方式:

自定义格式

date mesh(已在DSL查询API中详解)

内置格式

b.自定义格式

首先可以使用java定义时间的格式,例如:

PUT my_index

{

"mappings": {

"_doc": {

"properties": {

"date": {

"type": "date",

"format": "yyyy-MM-dd HH:mm:ss"

}

}

}

}

}

c.date mesh

某些API支持,已在DSL查询API中详细介绍过,这里不再重复。

d.内置格式

epoch_millis

时间戳,单位,毫秒。

-----------------------------------------------------------------------------------------------------

epoch_second

时间戳,单位,秒。

-----------------------------------------------------------------------------------------------------

date_optional_time

日期必填,时间可选,其支持的格式如下:

-----------------------------------------------------------------------------------------------------

basic_date

yyyyMMdd

-----------------------------------------------------------------------------------------------------

basic_date_time

yyyyMMdd'T'HHmmss.SSSZ

-----------------------------------------------------------------------------------------------------

basic_date_time_no_millis

yyyyMMdd'T'HHmmssZ

-----------------------------------------------------------------------------------------------------

basic_ordinal_date

4位数的年 + 3位(day of year),其格式字符串为yyyyDDD

-----------------------------------------------------------------------------------------------------

basic_ordinal_date_time

yyyyDDD'T'HHmmss.SSSZ

-----------------------------------------------------------------------------------------------------

basic_ordinal_date_time_no_millis

yyyyDDD'T'HHmmssZ

-----------------------------------------------------------------------------------------------------

basic_time

HHmmss.SSSZ

-----------------------------------------------------------------------------------------------------

basic_time_no_millis

HHmmssZ

-----------------------------------------------------------------------------------------------------

basic_t_time

'T'HHmmss.SSSZ

-----------------------------------------------------------------------------------------------------

basic_t_time_no_millis

'T'HHmmssZ

-----------------------------------------------------------------------------------------------------

basic_week_date

xxxx'W'wwe,4为年 ,然后用'W', 2位week of year(所在年里周序号)1位 day of week。

-----------------------------------------------------------------------------------------------------

basic_week_date_time

xxxx'W'wwe'T'HH:mm:ss.SSSZ.

-----------------------------------------------------------------------------------------------------

basic_week_date_time_no_millis

xxxx'W'wwe'T'HH:mm:ssZ.

-----------------------------------------------------------------------------------------------------

date

yyyy-MM-dd

-----------------------------------------------------------------------------------------------------

date_hour

yyyy-MM-dd'T'HH

-----------------------------------------------------------------------------------------------------

date_hour_minute

yyyy-MM-dd'T'HH:mm

-----------------------------------------------------------------------------------------------------

date_hour_minute_second

yyyy-MM-dd'T'HH:mm:ss

-----------------------------------------------------------------------------------------------------

date_hour_minute_second_fraction

yyyy-MM-dd'T'HH:mm:ss.SSS

-----------------------------------------------------------------------------------------------------

date_hour_minute_second_millis

yyyy-MM-dd'T'HH:mm:ss.SSS

-----------------------------------------------------------------------------------------------------

date_time

yyyy-MM-dd'T'HH:mm:ss.SSS

-----------------------------------------------------------------------------------------------------

date_time_no_millis

yyyy-MM-dd'T'HH:mm:ss

-----------------------------------------------------------------------------------------------------

hour

HH

-----------------------------------------------------------------------------------------------------

hour_minute

HH:mm

-----------------------------------------------------------------------------------------------------

hour_minute_second

HH:mm:ss

-----------------------------------------------------------------------------------------------------

hour_minute_second_fraction

HH:mm:ss.SSS

-----------------------------------------------------------------------------------------------------

hour_minute_second_millis

HH:mm:ss.SSS

-----------------------------------------------------------------------------------------------------

ordinal_date

yyyy-DDD,其中DDD为 day of year。

-----------------------------------------------------------------------------------------------------

ordinal_date_time